请教一个问题,flink写hdfs文件的时候,文件格式设置为parquet,这个怎么解决啊?

请教一个问题,flink写hdfs文件的时候,文件格式设置为parquet,压缩方式为GZIP,存在一个问题,如果开启文件合并的话,最终的文件不能通过hive映射读取,如果不开启的话,可以正常读取,这个怎么解决啊?

flink cdc写hdfs文件的时候,如果开启文件合并的话,最终的文件不能通过hive映射读取吗?

flink cdc写hdfs文件的时候,文件格式设置为parquet,压缩方式为GZIP,存在一个问题,如果开启文件合并的话,最终的文件不能通过hive映射读取,如果不开启的话,可以正常读取,这个怎么解决啊?

java flink + kafka,后端状态放hdfs后,每次重启服务,又从最早的消息开始消费问题

java flink + kafka,后端状态放hdfs后,每次重启服务,又从最早的消息开始消费,不是每次会提交检查点到hdfs吗,重启后,不应从最新的检查点开始处理么?

Flink把hdfs集群里的core-启动集群说找不到hdfs,如何解决?

Flink把hdfs集群里的core-site.xml hdfs.xml两个文 件放到flink/conf/目录下,启动集群说找不到hdfs?

Flink独立集群与hdfs集群不在一起,flink如何配置checkpoint目录为hdfs?

Flink独立集群与hdfs集群不在一起,flink如何配置checkpoint目录为hdfs?

[帮助文档] 开源版本Flink如何使用JindoSDK处理OSS HDFS服务的数据_对象存储(OSS)

开源Flink不支持流式写入OSS-HDFS服务,也不支持以EXACTLY_ONCE语义写入存储介质。当您希望开源Flink以EXACTLY_ONCE语义流式写入OSS-HDFS服务,需要结合JindoSDK。

Flink关闭hdfs的web页面,但是我找了官网没有找到新的参数,帮忙看看?

Flink关闭hdfs的web页面,找到了参数dfs.webhdfs.enabled设置为false不生效,折腾了一番发现是低版本Hadoop才有的参数,然后我用的是Hadoop3.2.4,但是我找了官网没有找到新的参数?

Flink报错问题之flink-sql写hdfs报错如何解决

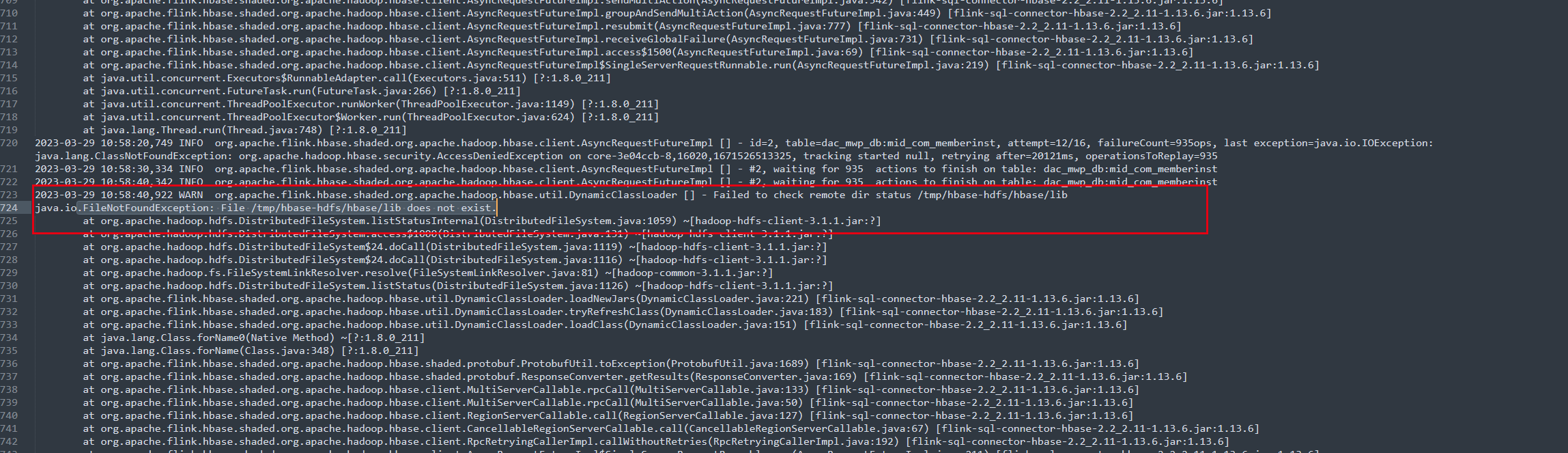

问题一:在使用flink-sql-connnect-hbase的时候老是出现这个报错是什么原因呢 问下我在使用flink-sql-connnect-hbase的时候老是出现这个报错是什么原因呢 ...

Flink有没有遇到过打checkpoint的时候,遇到写hdfs的错误然后一直卡死,怎么回事?

Flink有没有遇到过打checkpoint的时候,遇到写hdfs的错误然后一直卡死?状态非常大的时候,而且重启初始化非常的慢

flink cdc可以时间监控hdfs的文件变化吗 ?

flink cdc可以时间监控hdfs的文件变化吗 我们spark 分析完 一般直接落到hdfs 上 这种如快速 捕获 hdfs 某个文件的某条数据的变化吗?

本页面内关键词为智能算法引擎基于机器学习所生成,如有任何问题,可在页面下方点击"联系我们"与我们沟通。

产品推荐

社区圈子

文件存储HDFS版flink相关内容

文件存储HDFS版您可能感兴趣

- 文件存储HDFS版文件

- 文件存储HDFS版parquet

- 文件存储HDFS版设置

- 文件存储HDFS版格式

- 文件存储HDFS版hive

- 文件存储HDFS版映射

- 文件存储HDFS版cdc

- 文件存储HDFS版javaapi

- 文件存储HDFS版测试

- 文件存储HDFS版hadoop

- 文件存储HDFS版数据

- 文件存储HDFS版大数据

- 文件存储HDFS版操作

- 文件存储HDFS版api

- 文件存储HDFS版命令

- 文件存储HDFS版java

- 文件存储HDFS版集群

- 文件存储HDFS版存储

- 文件存储HDFS版文件存储

- 文件存储HDFS版配置

- 文件存储HDFS版分布式文件系统

- 文件存储HDFS版目录

- 文件存储HDFS版架构

- 文件存储HDFS版读取

- 文件存储HDFS版namenode

- 文件存储HDFS版mapreduce