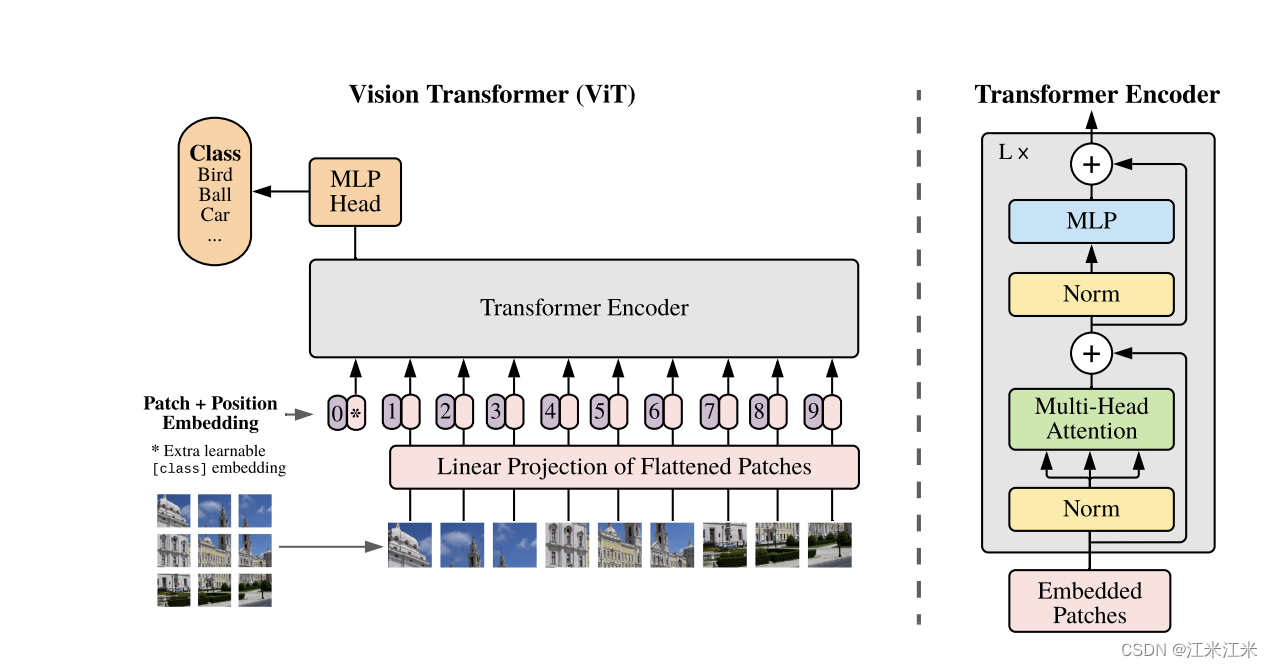

深度学习原理篇 第二章:vision transformer

参考教程:https://arxiv.org/pdf/2010.11929.pdfhttps://zhuanlan.zhihu.com/p/340149804 【大佬总结的非常好,他的好多篇文章都很值得学习】 为什么会使用transformer transformer在NLP领域广泛使用,它解决了R...

深度学习原理篇 第一章:transformer入门

参考教程: bilibili 迪哥的人工智能课 WORD EMBEDDINGS: ENCODING LEXICAL SEMANTICS https://zhuanlan.zhihu.com/p/48731949 从Embedding开始 词的向量化 transformer最初主要还是用于NLP任务中...

![深度学习应用篇-计算机视觉-图像分类[3]:ResNeXt、Res2Net、Swin Transformer、Vision Transformer等模型结构、实现、模型特点详细介绍](https://ucc.alicdn.com/fnj5anauszhew_20230608_66d62d30b9c94664ab8283a44887ff4d.png)

深度学习应用篇-计算机视觉-图像分类[3]:ResNeXt、Res2Net、Swin Transformer、Vision Transformer等模型结构、实现、模型特点详细介绍

深度学习应用篇-计算机视觉-图像分类[3]:ResNeXt、Res2Net、Swin Transformer、Vision Transformer等模型结构、实现、模型特点详细介绍 1.ResNet 相较于VGG的19层和GoogLeNet的22层,ResNet可以提供18、34、50、101、15...

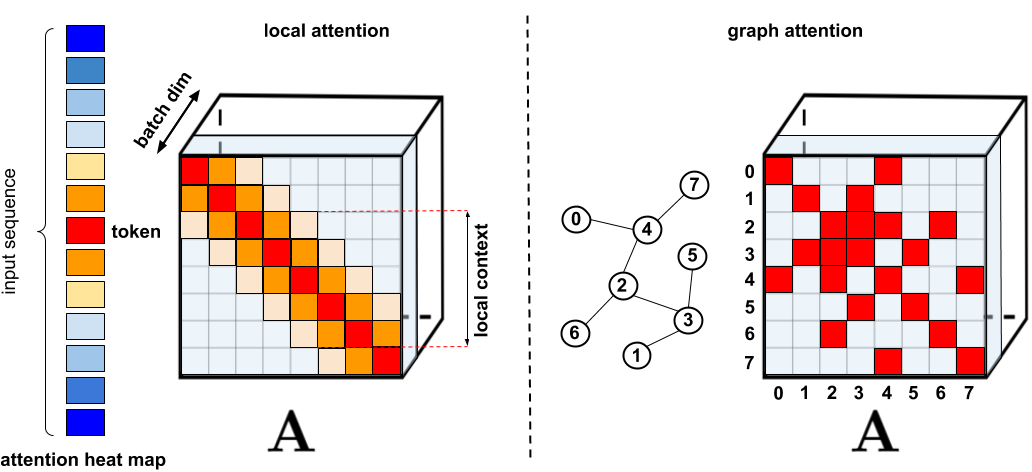

深度学习进阶篇7:Transformer模型长输入序列、广义注意力、FAVOR+快速注意力、蛋白质序列建模实操。

深度学习进阶篇[7]:Transformer模型长输入序列、广义注意力、FAVOR+快速注意力、蛋白质序列建模实操。 基于Transformer模型在众多领域已取得卓越成果,包括自然语言、图像甚至是音乐。然而,Transformer架构一直以来为人所诟病的是其注意力模块的低效,即长度二次依赖限制问题...

![深度学习进阶篇-预训练模型[3]:XLNet、BERT、GPT,ELMO的区别优缺点,模型框架、一些Trick、Transformer Encoder等原理详解](https://ucc.alicdn.com/fnj5anauszhew_20230526_a8ef174625f448c29fd038a273cbb6e5.png)

深度学习进阶篇-预训练模型[3]:XLNet、BERT、GPT,ELMO的区别优缺点,模型框架、一些Trick、Transformer Encoder等原理详解

深度学习进阶篇-预训练模型[3]:XLNet、BERT、GPT,ELMO的区别优缺点,模型框架、一些Trick、Transformer Encoder等原理详解 1.XLNet:Generalized Autoregressive Pretraining for Language Understan...

深度学习进阶篇-预训练模型1:预训练分词Subword、ELMo、Transformer模型原理;结构;技巧以及应用详解

深度学习进阶篇-预训练模型[1]:预训练分词Subword、ELMo、Transformer模型原理;结构;技巧以及应用详解 从字面上看,预训练模型(pre-training model)是先通过一批语料进行训练模型,然后在这个初步训练好的模型基础上,再继续训练或者另作他用。这样的理解基本上是对的,...

一个基于Transformer的深度学习架构,在基因调控中组蛋白代码的定量破译方面性能超群

通过组蛋白修饰对转录控制的定量表征受到许多计算研究的挑战,但其中大多数只关注启动子周围的狭窄和线性基因组区域,留下了改进的空间。韩国首尔大学的研究人员提出了 Chromoformer,这是一种基于 Transformer 的三维染色质构象感知深度学习架构,它在基因调控中组蛋白代码的定量破译方面实现了...

从感知机到Transformer,一文概述深度学习简史(2)

2012 年:ImageNet 挑战赛、AlexNet 和 ConvNet 的兴起如果跳过 ImageNet 大规模视觉识别挑战赛 (ILSVRC) 和 AlexNet,就几乎不可能讨论神经网络和深度学习的历史。ImageNet 挑战赛的唯一目标是评估大型数据集上的图像分类和对象分类架构。它带来了许...

从感知机到Transformer,一文概述深度学习简史(1)

这篇文章从感知机开始,按照时间顺序回顾了深度学习的历史。1958 年:感知机的兴起1958 年,弗兰克 · 罗森布拉特发明了感知机,这是一种非常简单的机器模型,后来成为当今智能机器的核心和起源。感知机是一个非常简单的二元分类器,可以确定给定的输入图像是否属于给定的类。为了实现这一点,它使用了单位阶跃...

Transformer 与 Bayesian深度学习

贝叶斯神经网络(Bayesian Neural Network)通过提供不确定来回答“Why Should I Trust You?”这个问题。实现上讲,贝叶斯通过集成深度学习参数矩阵中参数的Uncertainty来驾驭数据的不确定性,提供给具体Task具有置信空间Confidence的推理结构。一...

本页面内关键词为智能算法引擎基于机器学习所生成,如有任何问题,可在页面下方点击"联系我们"与我们沟通。

产品推荐

社区圈子

最佳实践