FlowSeq、mBART、BERT-fused、mRASP、mRASP2...你都掌握了吗?一文总结机器翻译必备经典模型(3)

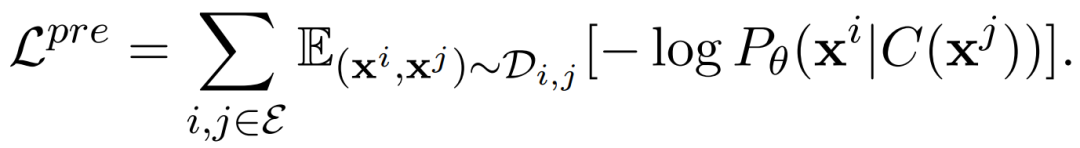

mRASPRASP是一种预训练通用多语言神经机器翻译模型的方法,mRASP的关键思路是随机对齐替换技术(random aligned substitution),它使具有相似含义的多语言的单词和短语在表征空间中更加接近。作者在32个语言对上联合训练一个mRASP模型,只用公共数据集。然后在下游语言对...

FlowSeq、mBART、BERT-fused、mRASP、mRASP2...你都掌握了吗?一文总结机器翻译必备经典模型(2)

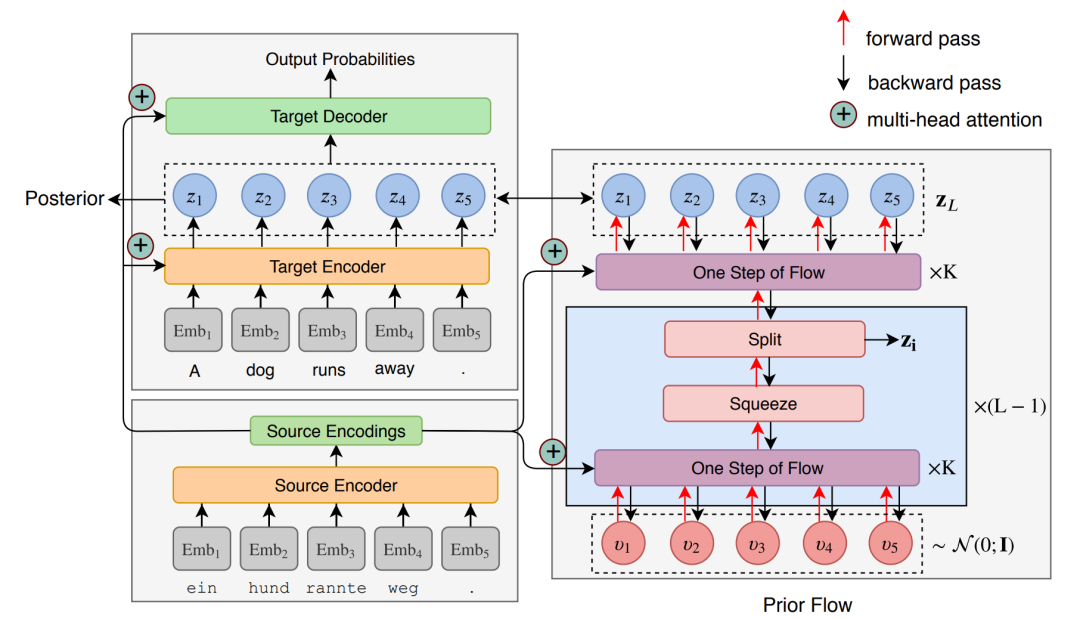

FlowSeq大多数seq2seq模型是自回归的,它们通过对先前生成的标记进行调节来生成每个标记。相比之下,非自回归seq2seq模型一次性生成所有标记,通过在GPU等硬件上进行并行处理,从而提高效率。然而,直接同时对所有tokens的联合分布进行建模是非常具有挑战性的,即使模型的结构越来越复杂,其...

FlowSeq、mBART、BERT-fused、mRASP、mRASP2...你都掌握了吗?一文总结机器翻译必备经典模型(1)

编者荐语:介绍 18 个在机器翻译任务上曾取得 SOTA 的经典模型。以下文章来源于机器之心SOTA模型 ,作者机器之心SOTA模型机器之心专栏本专栏由机器之心SOTA!模型资源站出品,每周日于机器之心公众号持续更新。本专栏将逐一盘点自然语言处理、计算机视觉等领域下的常见任务,并对在这些任务上取得过...

Unsupervised NMT、PBSMT、coarse-to-fine...你都掌握了吗?一文总结机器翻译必备经典模型(3)

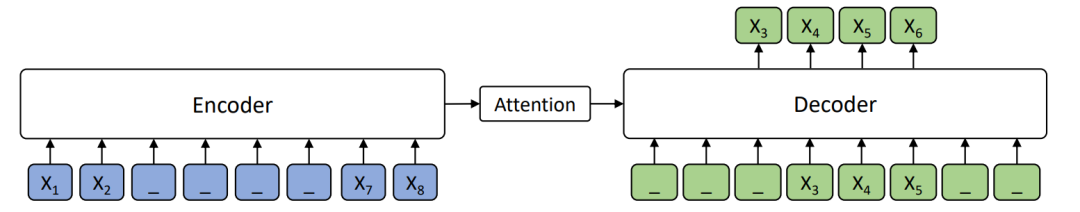

XLMs在BERT的启发下,提出了一个新的预训练目标:MAsked Sequence to Sequence learning(MASS)用于语言生成。MASS是基于序列到序列(seq2seq)的学习框架:它的编码器将一个带有掩码片段(几个连续的标记)的句子作为输入&#x...

Unsupervised NMT、PBSMT、coarse-to-fine...你都掌握了吗?一文总结机器翻译必备经典模型(2)

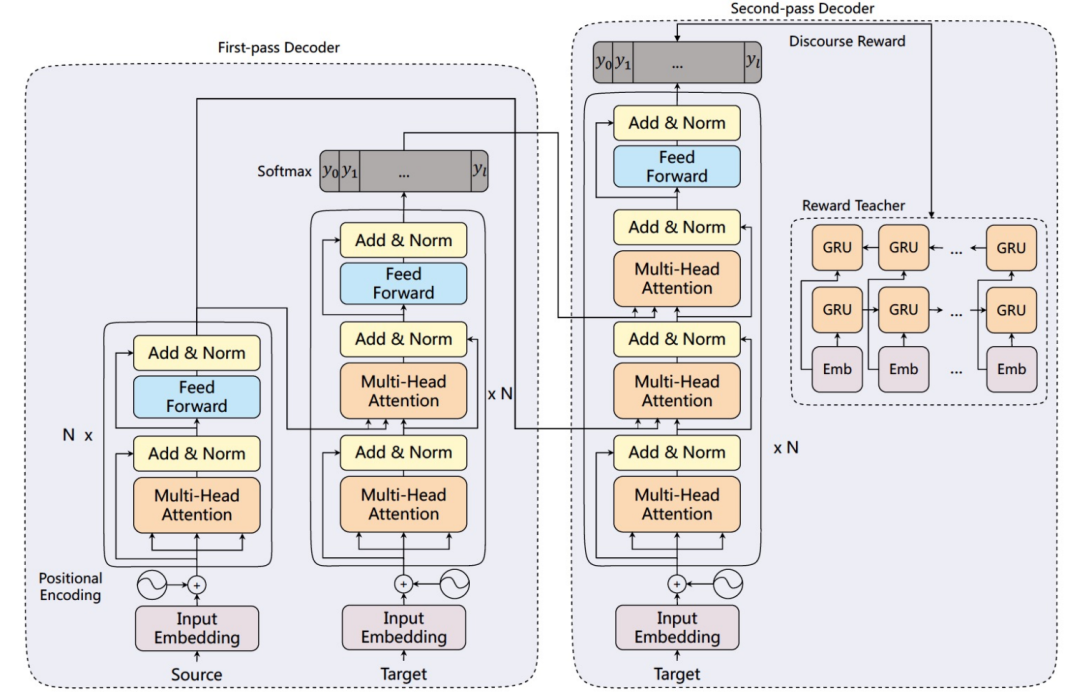

Two-pass decoder translation基于多轮解码校对网络的Two-pass decoder translation模型用于解决篇章翻译过程中的一致性和连贯性问题。该模型首先进行第一轮(first-pass)解码,根据单个句子生成初步的翻译结果。然后,根据已经生成的上下文信息,对翻...

Unsupervised NMT、PBSMT、coarse-to-fine...你都掌握了吗?一文总结机器翻译必备经典模型(1)

机器之心专栏本专栏由机器之心SOTA!模型资源站出品,每周日于机器之心公众号持续更新。 本专栏将逐一盘点自然语言处理、计算机视觉等领域下的常见任务,并对在这些任务上取得过 SOTA 的经典模型逐一详解。前往 SOTA!模型资源站(sota.jiqizhixin.com)即可获取...

RNNsearch、Multi-task、attention-model...你都掌握了吗?一文总结机器翻译必备经典模型(3)

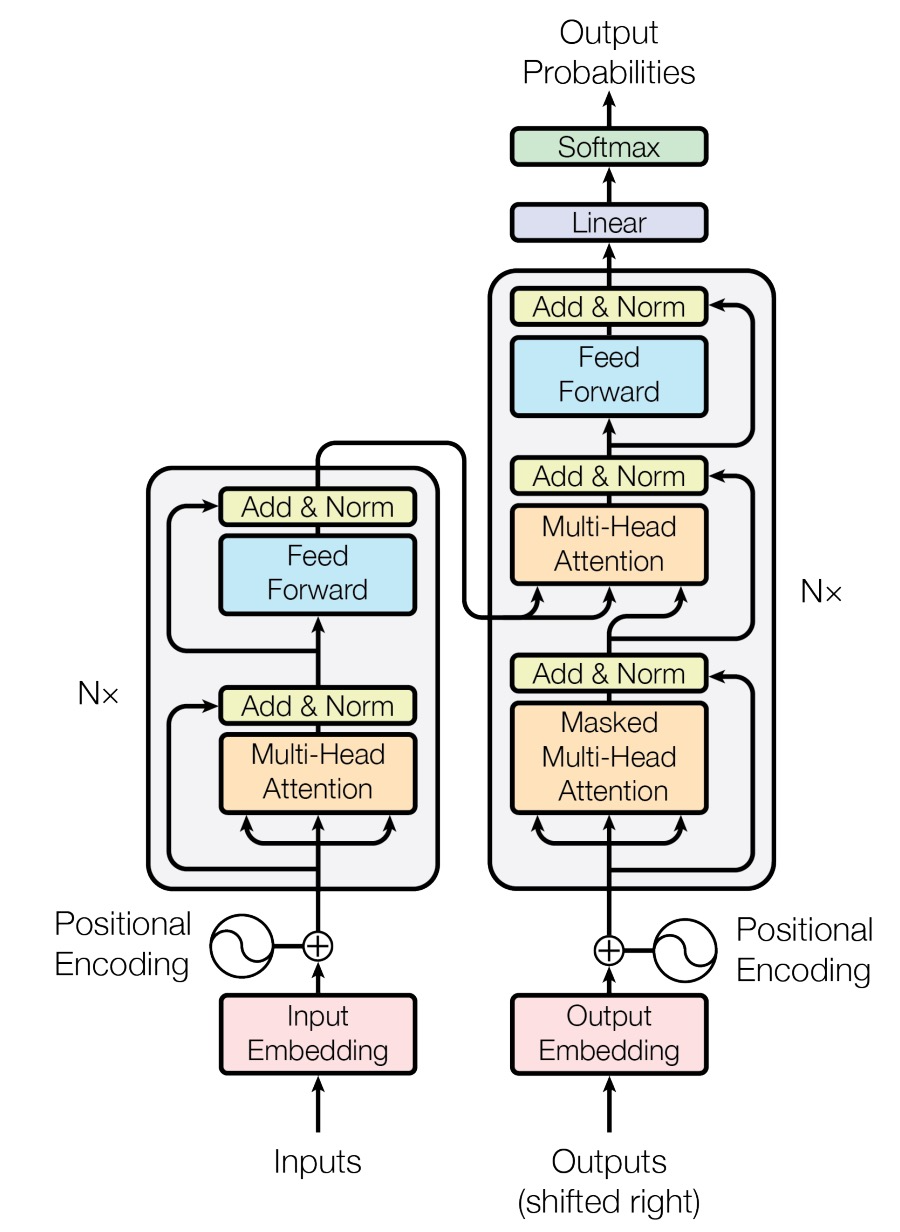

Attention2017 年,Google 机器翻译团队发表的《Attention is All You Need》完全抛弃了RNN和CNN等网络结构,而仅仅采用Attention机制来完成机器翻译任务,并且取得了很好的效果,注意力机制也成为了研究热点。大多数竞争性神经序列转导模型都有一个编码器-...

RNNsearch、Multi-task、attention-model...你都掌握了吗?一文总结机器翻译必备经典模型(2)

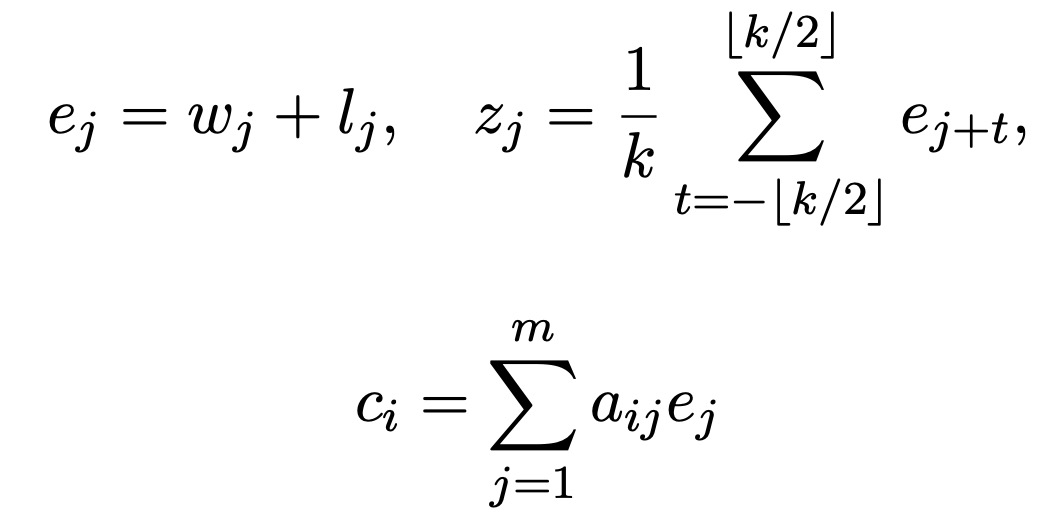

Convolutional EncoderConvolutional Encoder 是基于卷积层的模型,与循环神经网络计算受时间依赖性约束不同,Convolutional Encoder能够实现同时编码。非循环编码器的一个简单基准是Ranzato提到的池化模型,即将K个连续词的词嵌入进行简单的平均...

RNNsearch、Multi-task、attention-model...你都掌握了吗?一文总结机器翻译必备经典模型(1)

本专栏将逐一盘点自然语言处理、计算机视觉等领域下的常见任务,并对在这些任务上取得过 SOTA 的经典模型逐一详解。前往 SOTA!模型资源站(sota.jiqizhixin.com)即可获取本文中包含的模型实现代码、预训练模型及 API 等资源。本文将分 3 期进行连载,共介绍 18 个在...

本页面内关键词为智能算法引擎基于机器学习所生成,如有任何问题,可在页面下方点击"联系我们"与我们沟通。

产品推荐

社区圈子