论文介绍:基于扩散神经网络生成的时空少样本学习

在智能城市的构建与发展过程中,时空数据的准确建模与分析是至关重要的。然而,现实情况中,许多城市在时空数据的收集与处理上面临着严峻的挑战,尤其是数据量不足的问题,这极大地限制了智能城市应用的深入发展。针对这一问题,一项名为“基于扩散神经网络生成的时空少样本学习”的研究提出了一种创新的解决方案,旨在通过...

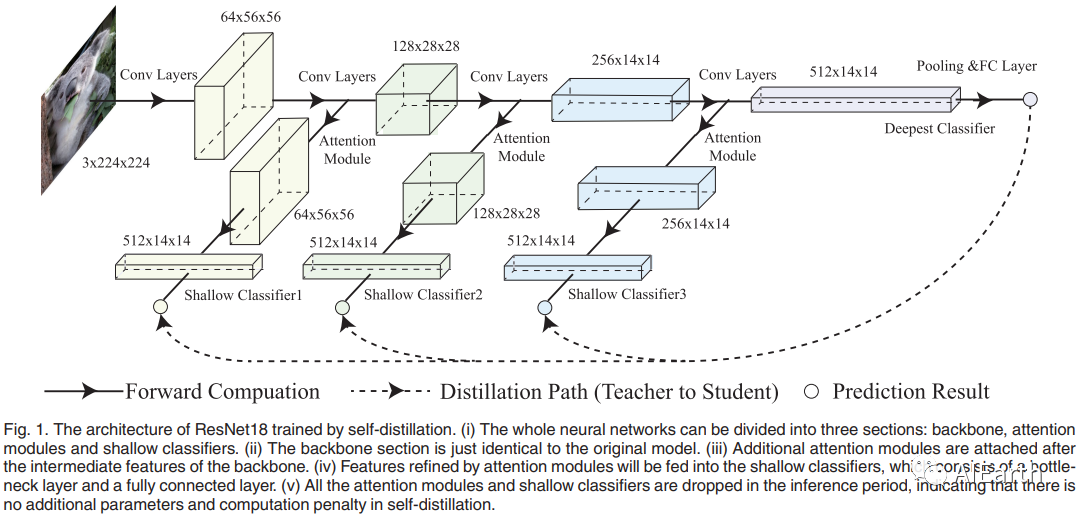

【论文速递】TPAMI2022 - 自蒸馏:迈向高效紧凑的神经网络

【论文原文】:Self-Distillation: Towards Efficient and Compact Neural Networks获取地址:https://ieeexplore.ieee.org/stamp/stamp.jsp?tp=&arnumber=9381661博主关键词:...

隐语小课丨「论文研究」隐私保护纵向联邦图神经网络

收录于合集#顶会论文分享4个#隐语小课23个#联邦学习7个在7月份举办的IJCAI-ECAI2022(第31届国际人工智能联合会议与第25届欧洲人工智能会议)上,蚂蚁集团参与撰写的论文《针对Node分类任务的隐私保护纵向联邦图神经网络》被收录。IJCAI2022接收投稿超过4500篇,录用率仅为15...

DenseNet共一、CVPR 2017最佳论文得主刘壮博士论文,从另一视角看神经网络架构

研究者希望这篇文章对神经网络架构感兴趣的人有所帮助,特别是那些正在寻找不同角度进行研究的研究者。深度学习的基本原理可以追溯到几十年前,20 世纪 80 年代 Geoffrey Hinton 等人提出了基于梯度的反向传播学习算法,而 ConvNets 从早期就被应用于手写数字识别等计算机视觉任务。然而...

信息瓶颈提出者Naftali Tishby生前指导,129页博士论文「神经网络中的信息流」公布

深度学习的黑箱属性一直为人所诟病,很多研究者都在努力解决这一问题。其中,用信息论来提高深度神经网络的可解释性是一个非常有趣的方向。在这个方向上,「信息瓶颈」提出者、希伯来大学计算机科学教授 Naftali Tishby 及其学生的论文属于必读文献。2015 年,Tishby 和他的学生 Noga Z...

NeurIPS 2021 | 华为诺亚Oral论文:基于频域的二值神经网络训练方法

二值神经网络(BNN)将原始全精度权重和激活用符号函数表征成 1-bit。但是由于常规符号函数的梯度几乎处处为零,不能用于反向传播,因此一些研究已经提出尝试使用近似梯度来减轻优化难度。然而,这些近似破坏了实际梯度的主要方向。基于此,在一篇 NeurIPS 2021 论文中,来自华为诺亚方舟实验室等机...

【论文速递】TPAMI2022 - 自蒸馏:迈向高效紧凑的神经网络

【论文速递】TPAMI2022 - 自蒸馏:迈向高效紧凑的神经网络【论文原文】:Self-Distillation: Towards Efficient and Compact Neural Networks获取地址:https://ieeexplore.ieee.org/stamp/st...

【论文泛读】 ResNeXt:深度神经网络的聚合残差变换(ResNet的改进,提出了一种新的维度)

主要思想简单来说呢,随着很多SOTA模型的出现,从一开始的“特征工程”慢慢地转入了一些“网络工程”,引入了一些新的结构和方法。在前面说过的网络中呢,VGG作为一种经典的模型,他提出了堆叠相同块(stacking block)的策略,在VGG中是3x3卷积核不断堆叠,并且也...

![论文赏析[NAACL19]无监督循环神经网络文法 (URNNG)(二)](https://ucc.alicdn.com/pic/developer-ecology/c50e3eb08c894c7d82fd34ee2eb265a8.png)

论文赏析[NAACL19]无监督循环神经网络文法 (URNNG)(二)

Generative Model 上面的推理网络采样出了若干个句法树 z ,生成网络的目的就是计算它的联合概率 。这个其实不难,在之前的RNNG论文笔记中,我已经大致讲过了,可以去复习一下:Recurrent Neural Network Grammarsgodweiyang.com这里稍...

![论文赏析[NAACL19]无监督循环神经网络文法 (URNNG)(一)](https://ucc.alicdn.com/pic/developer-ecology/e81e8746c89e413686f8ee151f5e3f36.png)

论文赏析[NAACL19]无监督循环神经网络文法 (URNNG)(一)

介绍这篇是新鲜出炉的NAACL19的关于无监督循环神经网络文法(URNNG)的论文,在语言模型和无监督成分句法分析上都取得了非常不错的结果,主要采用了变分推理和RNNG。本文公式量较大,因此我也推了好久,算法也挺多的,首先上一张我推导的公式笔记:我这篇博客就不按照论文的顺序来讲了&#x...

本页面内关键词为智能算法引擎基于机器学习所生成,如有任何问题,可在页面下方点击"联系我们"与我们沟通。