神经网络算法——损失函数(Loss Function)

前言 本文将从损失函数的本质、损失函数的原理、损失函数的算法三个方面,详细介绍损失函数Loss Function。 损失函数 ...

手把手教你搭建一个深度网络模型:从输入层-激活函数-损失函数-优化方法-输出层-执行训练

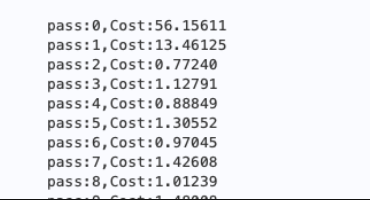

深度神经网络模型的搭建步骤如下。 第1步,我们使用 Paddlepaddle来定义一个深度神经网络模型。这个深度神经网络模型非常简单,结构包括输入层、隐层1、隐层2、输出层,这个深度神经网络模型一共有3层,因为输入层不参与计算,所以不算入总层数。使用 fluid. data0函数定义一个输入层,指定...

【Python机器学习】神经网络中常用激活函数、损失函数、优化方法(图文解释 附源码)

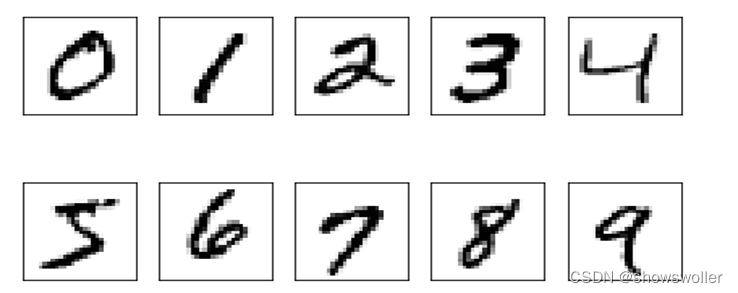

下面以经典的分类任务:MNIST手写数字识别,采用全连接层神经网络MNIST数据集是一个手写体的数字图片集,它包含有训练集和测试集,由250个人手写的数字构成。训练集包含60000个样本,测试集包含10000个样本。每个样本包括一张图片和一个标签。每张图片由28×28个像素点构成,每个像素点用1个灰...

前向神经网络-多层感知器、损失函数、反向传播

1. 什么是神经网络我们以房价预测的案例来说明一下,把房屋的面积作为神经网络的输入(我们称之为 ),通过一个节点(一个小圆圈),最终输出了价格(我们用 表示)。其实这个小圆圈就是一个单独的神经元,就像人的大脑神经元一样。如果这是一个单神经元网络,...

【Pytorch神经网络理论篇】 34 样本均衡+分类模型常见损失函数

同学你好!本文章于2021年末编写,获得广泛的好评!故在2022年末对本系列进行填充与更新,欢迎大家订阅最新的专栏,获取基于Pytorch1.10版本的理论代码(2023版)实现,Pytorch深度学习·理论篇(2023版)目录地址为:CSDN独家 | 全网首发 | Pytorch深度学习·理论篇(...

【Pytorch神经网络理论篇】 09 神经网络模块中的损失函数

同学你好!本文章于2021年末编写,获得广泛的好评!故在2022年末对本系列进行填充与更新,欢迎大家订阅最新的专栏,获取基于Pytorch1.10版本的理论代码(2023版)实现,Pytorch深度学习·理论篇(2023版)目录地址为:CSDN独家 | 全网首发 | Pytorch深度学习·理论...

【Pytorch神经网络基础理论篇】 08 Softmax 回归 + 损失函数 + 图片分类数据集

同学你好!本文章于2021年末编写,已与实际存在较大的偏差!故在2022年末对本系列进行填充与更新,欢迎大家订阅最新的专栏,获取基于Pytorch1.10版本的理论代码(2023版)实现,Pytorch深度学习·理论篇(2023版)目录地址为:CSDN独家 | 全网首发 | Pytorch深度学习...

神经网络基础部件-损失函数详解

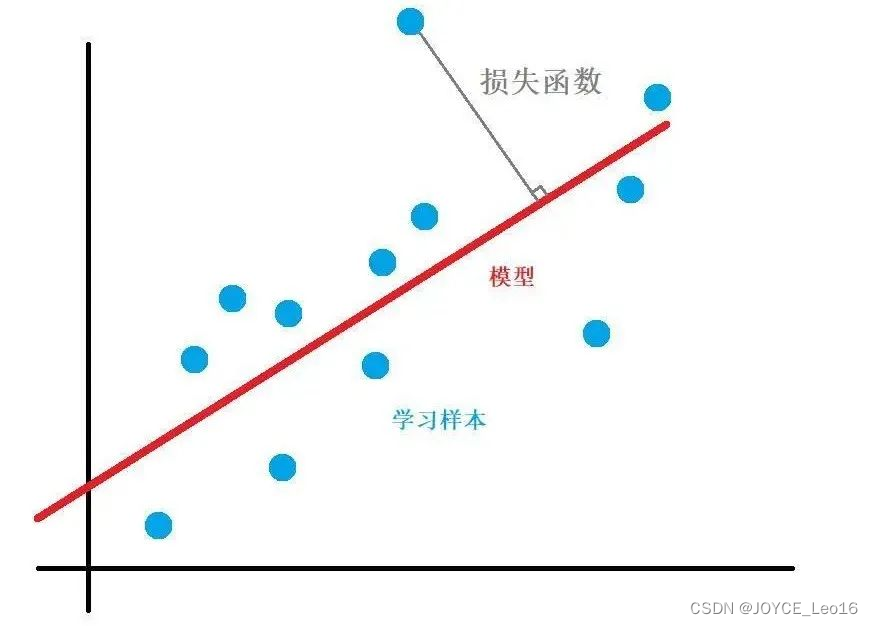

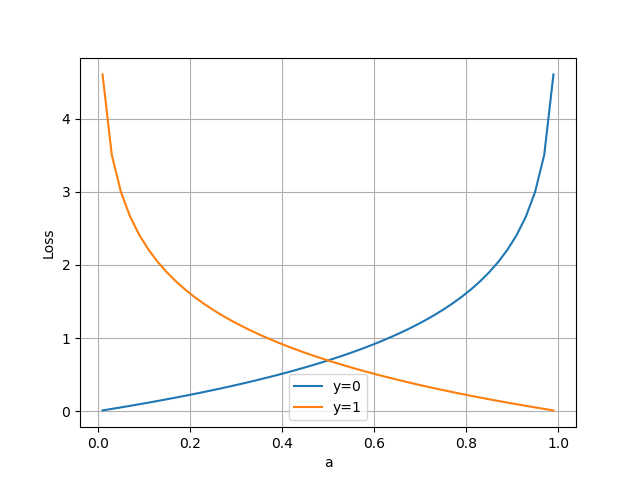

一,损失函数概述大多数深度学习算法都会涉及某种形式的优化,所谓优化指的是改变 $x$ 以最小化或最大化某个函数 $f(x)$ 的任务,我们通常以最小化 $f(x)$ 指代大多数最优化问题。在机器学习中,损失函数是代价函数的一部分,而代价函数是目标函数的一种类型。损失函数(loss function)...

神经网络中的损失函数正则化和 Dropout 并手写代码实现

在深度神经网络中最常用的方法是Regularization和dropout。在本文中,我们将一起理解这两种方法并在python中实现它们Regularization 正则化正则化通过在损失函数的末尾添加额外的惩罚项来帮助防止模型过度拟合。其中m是批次大小。所示的正则化称为L2正则化,而L...

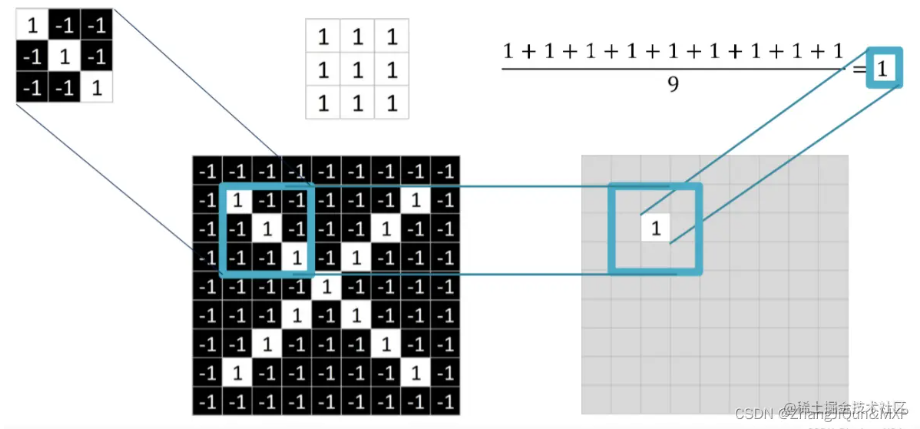

为什么卷积神经网络不是全连接,卷积,池化,激活,损失函数

为什么卷积神经网络不是全连接卷积有池化进行维度压缩导致压缩去的点就不进行连接;卷积:特征提取池化:压缩维度,降低运算复杂度激活:放大特征,防止梯度消失;损失函数:梯度下降,寻找最优卷积,池化,激活,损失函数卷积CNN提取局部信息...

本页面内关键词为智能算法引擎基于机器学习所生成,如有任何问题,可在页面下方点击"联系我们"与我们沟通。