[帮助文档] 创建工作空间

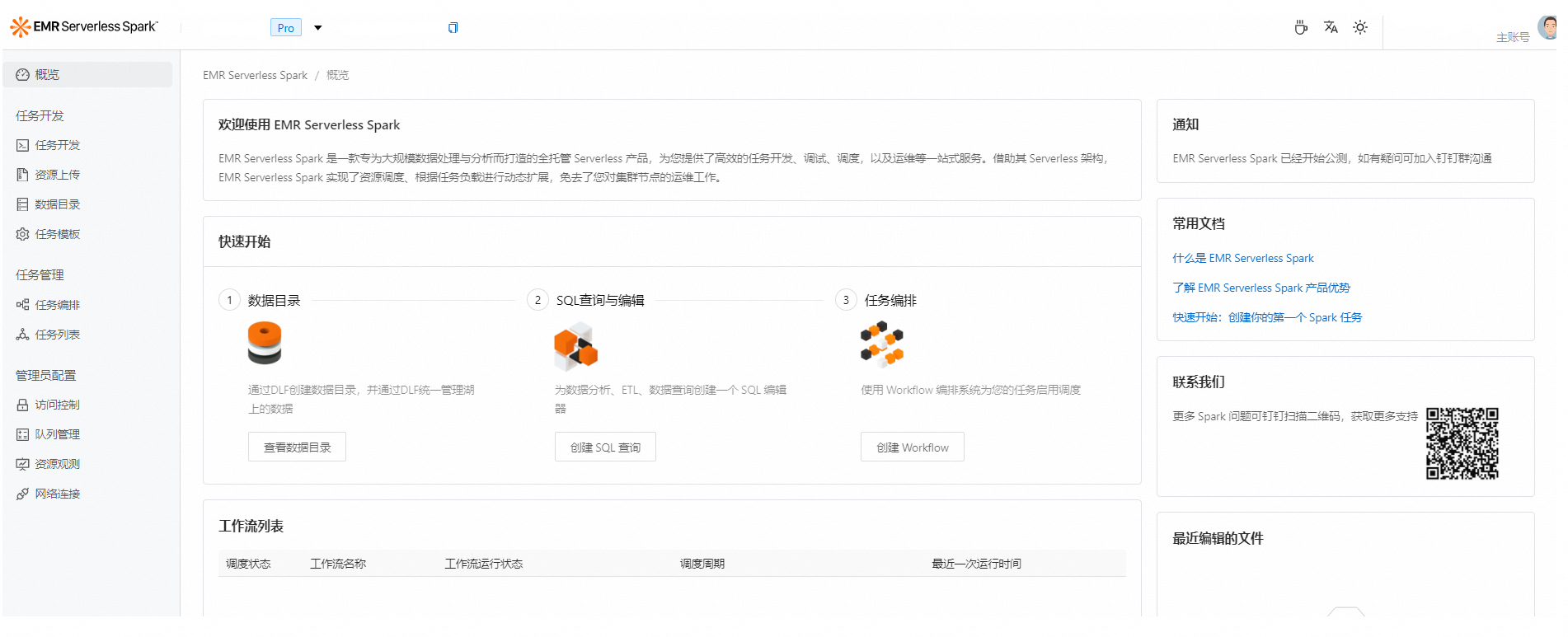

工作空间是Serverless Spark的基本单元,用于管理任务、成员、角色和权限。所有的任务开发都需要在具体的工作空间内进行。因此,在开始任务开发之前,您需要先创建工作空间。本文将为您介绍如何在EMR Serverless Spark页面快速创建工作空间。

[帮助文档] 实现EMR Serverless Spark与其他VPC间网络互通

通过网络连接功能,您可以访问自有VPC(Virtual Private Cloud)内的数据源。本文将以SparkSQL和Application JAR类型任务连接至您的自有VPC的HMS(Hive Metastore)服务为例,为您介绍如何配置并访问自有VPC内的数据源。

[帮助文档] RAM用户授权

当RAM用户(子账号)进行EMR Serverless Spark操作,例如创建、查看或删除工作空间等操作时,必须具有相应的权限。本文为您介绍如何进行RAM授权。

[帮助文档] PySpark任务开发入门

您可以自行编写并构建包含业务逻辑的Python脚本,上传该脚本后,即可便捷地创建和执行PySpark任务。本文通过一个示例,为您演示如何进行PySpark任务的开发与部署。

[帮助文档] 阿里云账号角色授权

使用EMR Serverless Spark前,需要授予您的阿里云账号AliyunServiceRoleForEMRServerlessSpark和AliyunEMRSparkJobRunDefaultRole系统默认角色。本文为您介绍角色授权的基本操作。

阿里云 EMR Serverless Spark 版免费邀测中

随着大数据应用的广泛推广,企业对于数据处理的需求日益增长。为了进一步优化大数据开发流程,减少企业的运维成本,并提升数据处理的灵活性和效率,阿里云开源大数据平台 E-MapReduce (简称“EMR”)正式推出 EMR Serverless Spark 版,并已开启邀测! 立即申请 以强大的 Spa...

DataWorks on emr 创建spark节点指定dlf的catalog?

在DataWorks中创建EMR Spark节点并指定DLF(Data Lake Formation)作为元数据目录进行对接时,通常需要确保DLF已经配置为Spark的元数据源,并且在EMR集群端完成了相应的设置。以下是一种可能的操作流程: 配置EMR集群: 在EMR集群初始化或后续管理过程中,需要...

DataWorks on emr 创建spark节点指定dlf的catalog?

DataWorks on emr 创建spark节点指定dlf的catalog?

DataWorks请问这个该从什么方向去排查,我在EMR侧没有找到Spark相关的监控之类的?

DataWorks任务拉起的jar包中去获取SparkSession耗时达30+分钟,请问这个该从什么方向去排查,我在EMR侧没有找到Spark相关的监控之类的?

DataWorks如何创建并使用EMR Spark节点数据开发示例二?

DataWorks如何创建并使用EMR Spark节点数据开发示例二:Spark对接MaxCompute?

本页面内关键词为智能算法引擎基于机器学习所生成,如有任何问题,可在页面下方点击"联系我们"与我们沟通。

社区圈子

apache spark您可能感兴趣

- apache spark Hadoop

- apache spark数据

- apache spark分析

- apache spark Python

- apache spark数据处理

- apache spark入门

- apache spark大数据

- apache spark配置

- apache spark安装

- apache spark单机

- apache spark SQL

- apache spark streaming

- apache spark Apache

- apache spark rdd

- apache spark MaxCompute

- apache spark运行

- apache spark集群

- apache spark summit

- apache spark模式

- apache spark学习

- apache spark机器学习

- apache spark实战

- apache spark Scala

- apache spark flink

- apache spark程序

- apache spark操作