DataWorks找阿里运维截图提示如图所示,看描述是cpu资源沾满了么?

DataWorks现在的pyodps脚本固化历史分区数据执行超过48小时执行不完,看日志,只跑了1/5的样子,找阿里运维截图提示如图所示,看描述是cpu资源沾满了么?我们数据量并不大,8000个分区,2.7亿条数据而已pyodps大致操作如下import datetimefrom odps impo...

现在 dataworks 工作台里的运维中心如何查看空间资源,CPU 和内存,还有存储空间容量的?

现在 dataworks 工作台里的运维中心如何查看空间资源,CPU 和内存,还有存储空间容量的?

[帮助文档] 如何使用运维中心模块

您可在运维中心查看发布至生产环境的任务,并执行测试、补数据等相关运维操作。本文以周期调度任务的运维为例,通过确认调度任务的配置是否符合预期、使用补数据计算历史时间段的数据、配置任务的智能监控规则,保障任务后续可以正常调度,为您介绍运维中心模块的基本使用。

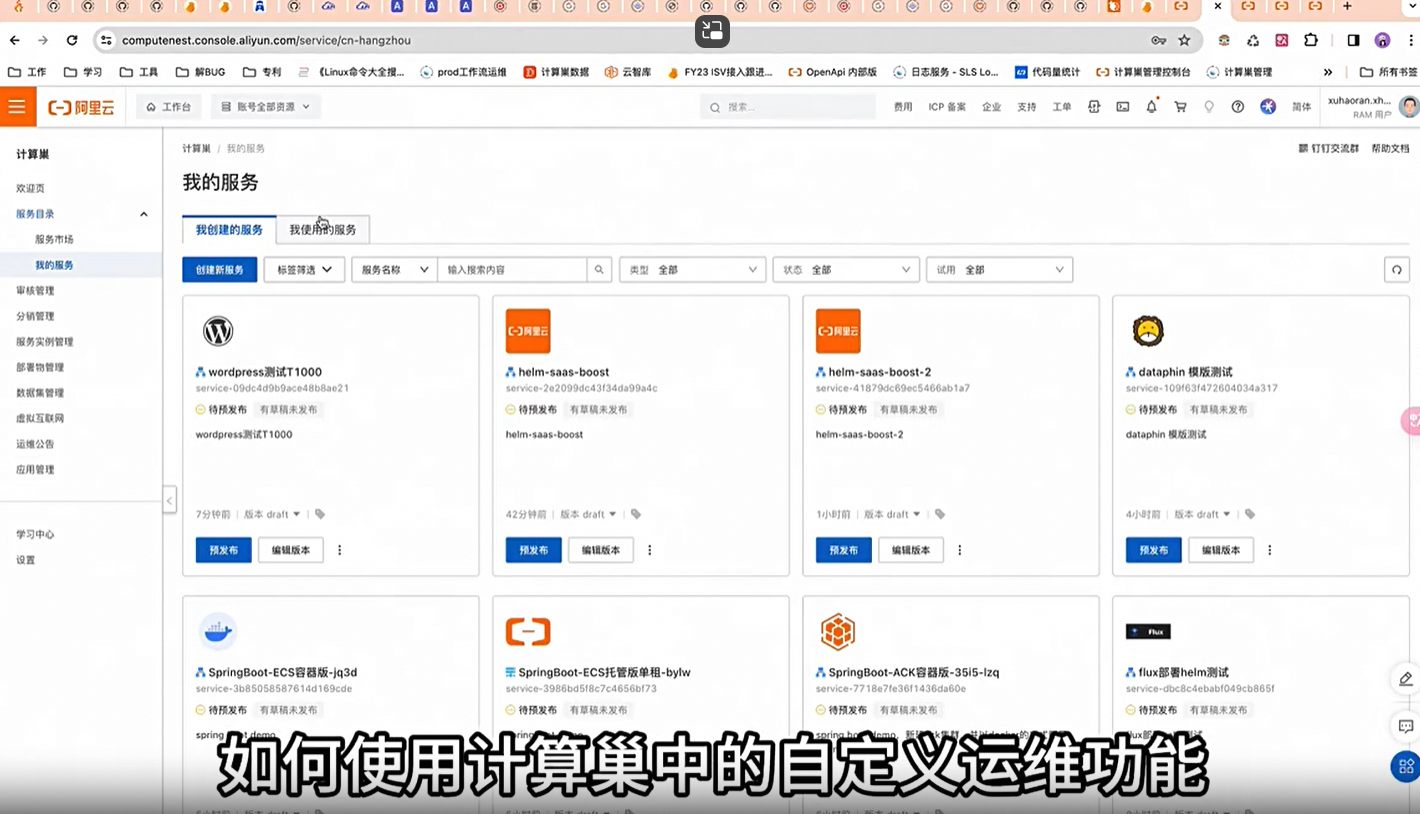

[帮助文档] DataWorks如何搭建自定义运维大屏

DataWorks如何搭建自定义运维大屏

[帮助文档] 如何通过DataWorks对Lindorm计算引擎的各类作业进行开发和调度运维

Lindorm计算引擎兼容CDH(Cloudera's Distribution Including Apache Hadoop),支持通过大数据开发治理平台DataWorks开发、管理、调度、运维分布式计算作业。作业类型包括交互式SQL查询、SQL作业、JAR作业、Python作业等。本文介绍如何...

[帮助文档] 如何通过DataWorks运维中心查看MaxCompute作业的运行信息

DataWorks运维中心展示离线同步、实时同步作业的运行状态分布、数据同步进度等数据集成信息,帮助您提升任务运维效率。当您在DataStudio中完成节点开发,并提交和发布至生产环境后,即可在运维中心查看作业运行详情、监控作业运行状态等操作。本文为您介绍如何通过DataWorks运维中心查看Max...

[帮助文档] 如何对任务进行运维管理

任务开发完发布上线后,我们需要在运维中心对它进行运维管理。本文介绍如何对任务进行运维管理。

本页面内关键词为智能算法引擎基于机器学习所生成,如有任何问题,可在页面下方点击"联系我们"与我们沟通。

运维dataworks相关内容

- dataworks运维实时同步

- dataworks运维

- dataworks运维界面

- dataworks周期任务运维

- dataworks运维描述

- dataworks运维资源

- dataworks设置运维角色

- dataworks运维权限

- dataworks运维角色

- dataworks运维报错

- dataworks运维运行

- dataworks运维节点

- dataworks生产运维

- dataworks运维周期实例周期任务

- dataworks运维周期任务

- dataworks运维筛选

- dataworks运维调度

- dataworks开发环境运维

- dataworks运维大屏

- dataworks运维规则

- dataworks数据开发运维

- dataworks运维告警

- dataworks运维实时计算

- dataworks运维运行状态

- dataworks同步运维

- dataworks运维短信邮件

- dataworks工作空间运维

- dataworks运维智能监控告警

- dataworks运维运行状态分布

- dataworks openapi运维

- dataworks集成运维运行

- dataworks调度运维

- dataworks账号运维