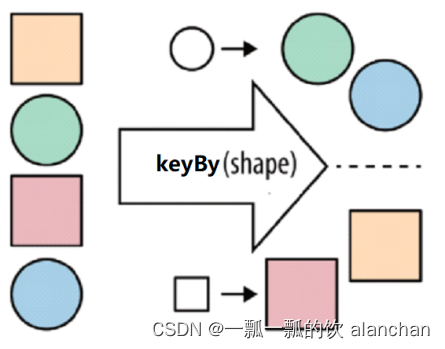

Flink DataStream keyby以后reduce,如果只想保留最后的结果有什么好办法吗?

Flink DataStream keyby 以后reduce,发现只是后一个记录的数值相加了,但原来第一个记录也还在reduce以后的流里面,记录并没有减少,如果只想保留最后的结果有什么好办法吗?

【flink番外篇】1、flink的23种常用算子介绍及详细示例(2)- keyby、reduce和Aggregations

Flink 系列文章一、Flink 专栏Flink 专栏系统介绍某一知识点,并辅以具体的示例进行说明。1、Flink 部署系列本部分介绍Flink的部署、配置相关基础内容。2、Flink基础系列本部分介绍Flink 的基础部分,比如术语、架构、编程模型、编程指南、基本的datastream api用...

本页面内关键词为智能算法引擎基于机器学习所生成,如有任何问题,可在页面下方点击"联系我们"与我们沟通。

实时计算 Flink版keyby相关内容

实时计算 Flink版您可能感兴趣

- 实时计算 Flink版产品

- 实时计算 Flink版同步

- 实时计算 Flink版版本

- 实时计算 Flink版delete

- 实时计算 Flink版字节数

- 实时计算 Flink版flink

- 实时计算 Flink版办法

- 实时计算 Flink版设置

- 实时计算 Flink版实时计算

- 实时计算 Flink版并行度

- 实时计算 Flink版CDC

- 实时计算 Flink版数据

- 实时计算 Flink版SQL

- 实时计算 Flink版mysql

- 实时计算 Flink版报错

- 实时计算 Flink版任务

- 实时计算 Flink版oracle

- 实时计算 Flink版kafka

- 实时计算 Flink版表

- 实时计算 Flink版Apache

- 实时计算 Flink版配置

- 实时计算 Flink版 CDC

- 实时计算 Flink版模式

- 实时计算 Flink版运行

- 实时计算 Flink版数据库

- 实时计算 Flink版Yarn

- 实时计算 Flink版checkpoint