[帮助文档] 基于Nginx Ingress Controller网关实现推理服务的灰度发布

在Raw Deployment部署模式下,应用的灰度发布需要基于网关实现。本文以Nginx Ingress Controller网关为例,介绍如何实现推理服务的灰度发布,并最终平稳地完成从v1到v2版本推理服务的升级。

[帮助文档] 什么是KServe

KServe是一个开源的云原生模型服务平台,旨在简化在Kubernetes上部署和运行机器学习模型的过程,支持多种机器学习框架、具备弹性扩容能力。KServe通过定义简单的YAML文件,提供声明式的API来部署模型,使得配置和管理模型服务变得更加容易。

[帮助文档] 基于KServe为服务配置弹性扩缩容策略

在部署与管理KServe模型服务过程中,需应对模型推理服务面临的高度动态负载波动。KServe通过集成Kubernetes原生的HPA(Horizontal Pod Autoscaler)技术及扩缩容控制器,实现了根据CPU利用率、内存占用情况、GPU利用率以及自定义性能指标,自动灵活地调整模型服务...

[帮助文档] 部署vLLM推理应用

vLLM(Vectorized Large Language Model)是一个高性能的大型语言模型推理库,支持多种模型格式和后端加速,适用于大规模语言模型的推理服务部署。本文以Qwen-7B-Chat-Int8模型、GPU类型为V100卡为例,演示如何部署一个vLLM推理服务。

[帮助文档] 基于KServe使用Fluid实现模型加速

随着技术的发展,AI应用的模型数据越来越大,但是通过存储服务(如OSS、NAS等)拉取这些大文件时可能会出现长时间的延迟和冷启动问题。您可以利用Fluid显著提升模型加载速度,从而优化推理服务的性能,特别是对于基于KServe的推理服务而言。本文以Qwen-7B-Chat-Int8模型、GPU类型为...

阿里云原生容器服务产品体系-阿里云边缘容器服务ACK@Edge介绍

开发者学习笔记【阿里云云原生助理工程师认证(ACA)课程:阿里云原生容器服务产品体系-阿里云边缘容器服务ACK@Edge介绍】课程地址:https://edu.aliyun.com/course/3112075/lesson/19021阿里云原生容器服务产品体系-阿里云边缘容器服务 ACK@Edg...

阿里云原生容器服务产品体系-ACK Pro 托管集群

开发者学习笔记【阿里云云原生助理工程师认证(ACA)课程:阿里云原生容器服务产品体系-ACK Pro 托管集群】课程地址:https://edu.aliyun.com/course/3112075/lesson/19017阿里云原生容器服务产品体系-ACK Pro 托管集群 内容介绍一.A...

阿里云原生容器服务产品体系- ACK 集群

开发者学习笔记【阿里云云原生助理工程师认证(ACA)课程:阿里云原生容器服务产品体系-ACK 集群】课程地址:https://edu.aliyun.com/course/3112075/lesson/19017阿里云原生容器服务产品体系-ACK 集群内容介绍一、阿里云容器服务形态二、阿里云...

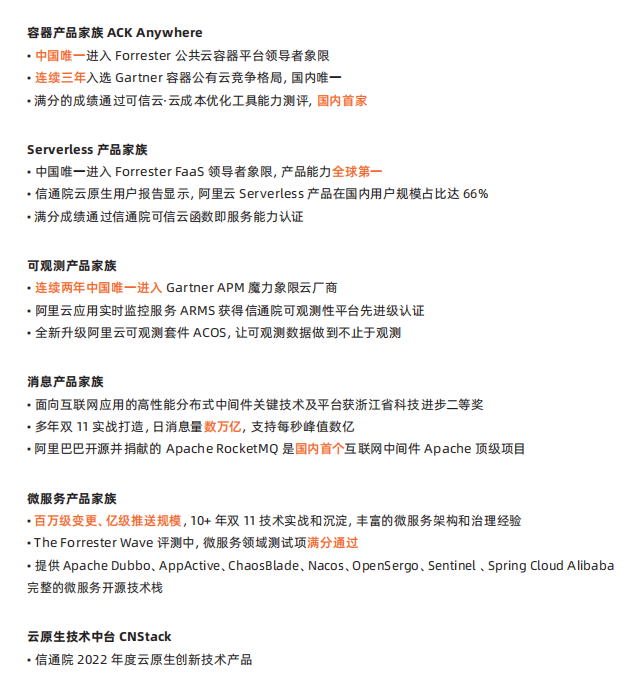

《阿里云产品手册2022-2023 版》——容器产品家族 ACK Anywhere

《阿里云产品手册2022-2023 版》——容器产品家族 ACK Anywhere

本页面内关键词为智能算法引擎基于机器学习所生成,如有任何问题,可在页面下方点击"联系我们"与我们沟通。