[帮助文档] PySpark任务开发入门

您可以自行编写并构建包含业务逻辑的Python脚本,上传该脚本后,即可便捷地创建和执行PySpark任务。本文通过一个示例,为您演示如何进行PySpark任务的开发与部署。

[帮助文档] Spark SQL任务快速入门

EMR Serverless Spark支持通过SQL代码编辑和运行任务。本文带您快速体验Spark SQL任务的创建、启动和运维等操作。

[帮助文档] 开发Spark Submit任务

EMR Serverless Spark兼容spark-submit命令行参数,简化了任务执行流程。本文通过一个示例,为您演示如何进行Spark Submit任务的开发与部署,确保您能够快速上手。

[帮助文档] 提交PySpark流任务

在大数据快速发展的时代,流式处理技术对于实时数据分析至关重要。EMR Serverless Spark提供了一个强大而可扩展的平台,它不仅简化了实时数据处理流程,还免去了服务器管理的烦恼,提升了效率。本文将指导您使用EMR Serverless Spark提交PySpark流式任务,展示其在流处理方...

[帮助文档] 使用Livy Operator提交任务

Apache Airflow是一个强大的工作流程自动化和调度工具,它允许开发者编排、计划和监控数据管道的执行。EMR Serverless Spark为处理大规模数据处理任务提供了一个无服务器计算环境。本文为您介绍如何通过Apache Airflow的Livy Operator实现自动化地向EMR ...

spark容器运行任务数量如何优化?

1、spark是线程级别的任务,那么executor容器内应该运行多少个任务(线程)?如何进行考虑? 2、executor容器内运行的任务(线程)较多会出现什么问题?运行的任务(线程)较少会出现什么问题?

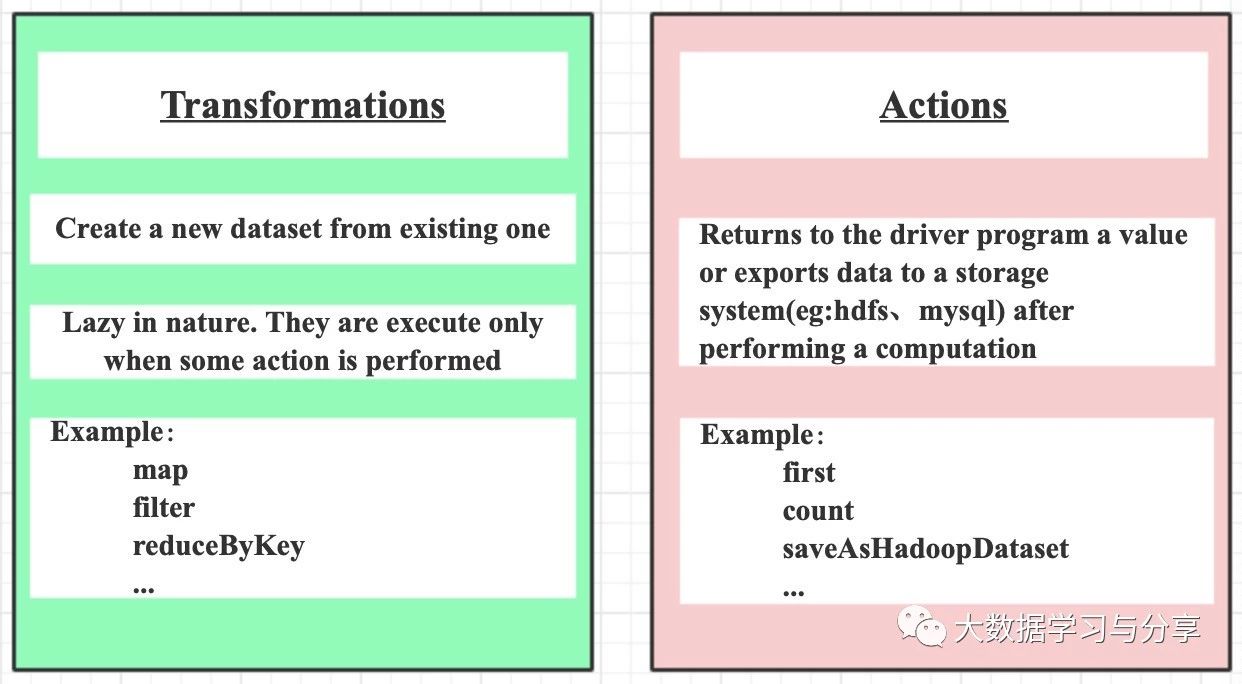

Spark为什么只有在调用action时才会触发任务执行呢(附算子优化和使用示例)?

Spark算子主要划分为两类:transformation和action,并且只有action算子触发的时候才会真正执行任务。还记得之前的文章《Spark RDD详解》中提到,Spark RDD的缓存和checkpoint是懒加载操作,只有action触发的时候才会真正执行,其实不仅是Spark R...

本页面内关键词为智能算法引擎基于机器学习所生成,如有任何问题,可在页面下方点击"联系我们"与我们沟通。

社区圈子

apache spark您可能感兴趣

- apache spark dataworks

- apache spark节点

- apache spark报错

- apache spark操作

- apache spark运行

- apache spark策略

- apache spark清理

- apache spark如何配置

- apache spark emr

- apache spark日志

- apache spark SQL

- apache spark streaming

- apache spark Apache

- apache spark数据

- apache spark Hadoop

- apache spark大数据

- apache spark rdd

- apache spark MaxCompute

- apache spark集群

- apache spark summit

- apache spark模式

- apache spark分析

- apache spark机器学习

- apache spark实战

- apache spark学习

- apache spark flink

- apache spark Scala