Spark作业调度中stage的划分

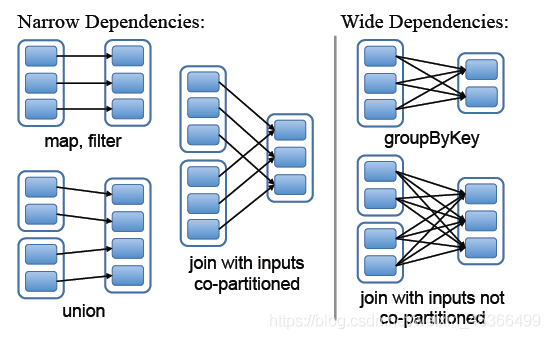

(1)Spark作业调度对RDD的操作分为transformation和action两类,真正的作业提交运行发生在action之后,调用action之后会将对原始输入数据的所有transformation操作封装成作业并向集群提交运行。这个过程大致可以如下描述:由DAGScheduler对RDD之间...

Spark中将DAG划分为Stage的划分依据是什么?

Spark中将DAG划分为Stage的划分依据是什么?

spark的stage是怎样来划分的?

spark的stage是怎样来划分的?

Spark FinalStage处理(Stage划分)

Spark FinalStage处理(Stage划分) 更多资源 github: https://github.com/opensourceteams/spark-scala-maven csdn(汇总视频在线看): https://blog.csdn.net/thinktothings/artic...

Spark源码分析之三:Stage划分

继上篇《Spark源码分析之Job的调度模型与运行反馈》之后,我们继续来看第二阶段--Stage划分。 Stage划分的大体流程如下图所示: &nbs...

Spark修炼之道(高级篇)——Spark源码阅读:第四节 Stage划分

Stage划分 在上一节中我们讲了 Spark Job的提交,在该讲中我们提到,当rdd触发action操作之后,会调用SparkContext的runJob方法,最后调用的DAGScheduler.handleJobSubmitted方法完成整个job的提交。然后DAGScheduler根据RDD...

Spark技术内幕:Stage划分及提交源码分析

当触发一个RDD的action后,以count为例,调用关系如下: org.apache.spark.rdd.RDD#count org.apache.spark.SparkContext#runJob org.apache.spark.scheduler.DAGScheduler#runJob o...

本页面内关键词为智能算法引擎基于机器学习所生成,如有任何问题,可在页面下方点击"联系我们"与我们沟通。

社区圈子

apache spark您可能感兴趣

- apache spark Hadoop

- apache spark数据

- apache spark分析

- apache spark Python

- apache spark可视化

- apache spark数据处理

- apache spark入门

- apache spark大数据

- apache spark配置

- apache spark安装

- apache spark SQL

- apache spark streaming

- apache spark Apache

- apache spark rdd

- apache spark MaxCompute

- apache spark运行

- apache spark集群

- apache spark summit

- apache spark模式

- apache spark学习

- apache spark实战

- apache spark机器学习

- apache spark Scala

- apache spark flink

- apache spark程序

- apache spark操作