[帮助文档] 如何使用Filebeat+Kafka+Logstash+Elasticsearch构建日志分析系统

随着时间的积累,日志数据会越来越多,当您需要查看并分析庞杂的日志数据时,可通过Filebeat+Kafka+Logstash+Elasticsearch采集日志数据到阿里云Elasticsearch中,并通过Kibana进行可视化展示与分析。本文介绍具体的实现方法。

请问一下。怎么从kafka获取一 批数据,然后批量写入es或数据库呢?

请问一下。怎么从kafka获取一 批数据,然后批量写入es或数据库呢。现在kafka消费都是一条一条的。怎么转化成批量呢。?

实时计算 Flink版咋能把es 的数据实时推入到 kafka? 进一条推一条

实时计算 Flink版咋能把es 的数据实时推入到 kafka? 进一条推一条

关于Flink CDC,咋能把es 的数据实时推入到 kafka 进一条推一条?

关于Flink CDC,咋能把es 的数据实时推入到 kafka 进一条推一条?

sqlserver > flink cdc> kafka> flink> es 这链路 可行吗?

sqlserver ---> flink cdc ---> kafka---> flink---> es 这链路 可行吗?

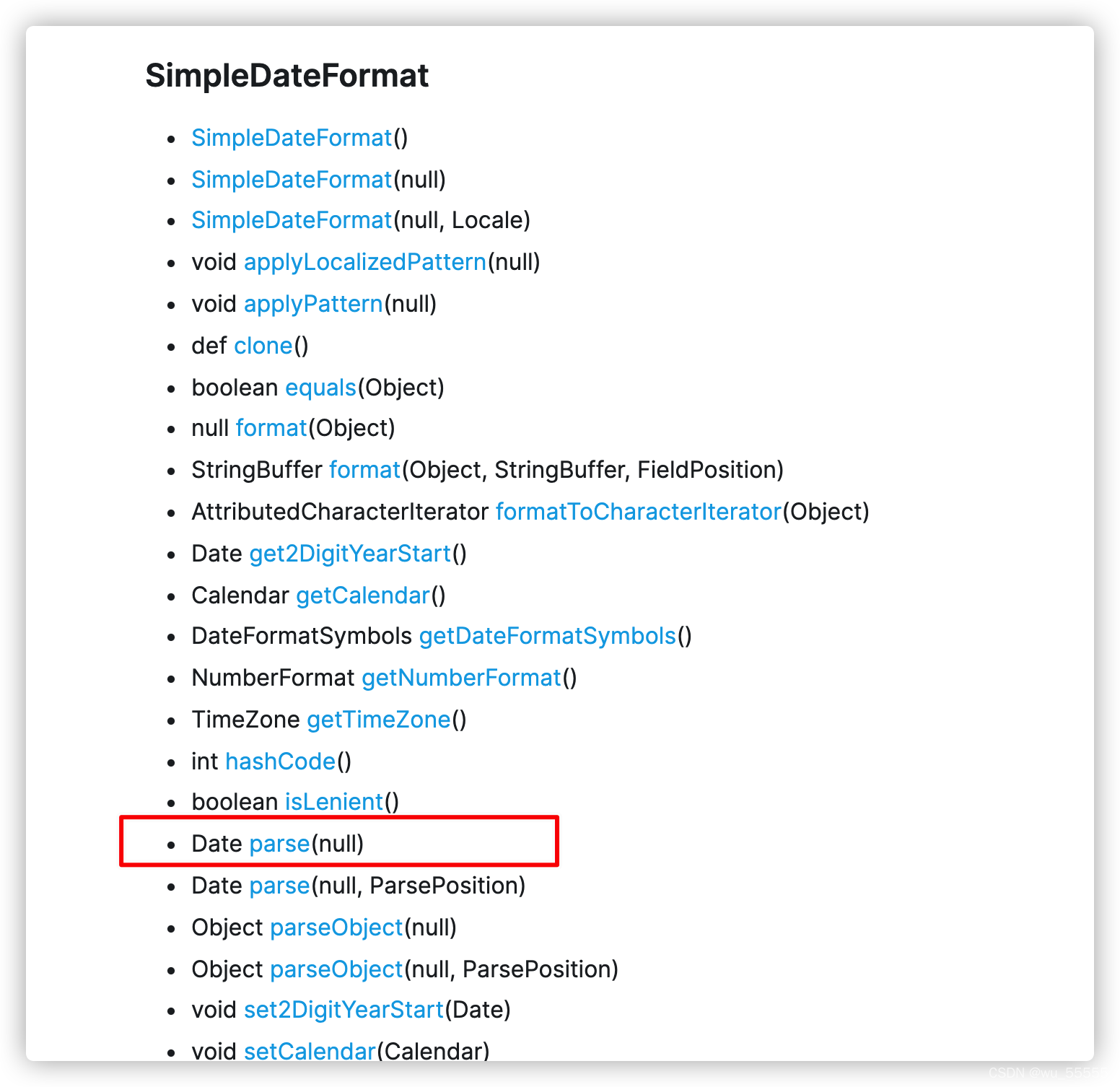

Elastic实战:logstash将kafka数据同步到es时,如何将字符串型时间字段转换为时间戳

0. 引言今天群里有同学问如何将字符串型的时间字段转换为long类型的时间戳。特记录下供后续参考。原问题:我接收数据方传过来的数据,其中有个时间类型是字符串类型,格式为:yyyy-MM-dd hh:mm:ss,我需要转成时间戳保存,我按照网上的方法试了好多种都无法成功转换。数据方把数据发到kafka...

集合的测试 es插入没问题,但用kafka流式逻辑插入就没响应,断点也跑到了,不知道什么问题,怎么办

集合的测试 es插入没问题,但用kafka流式逻辑插入就没响应,断点也跑到了,不知道什么问题,怎么办

大神们,数据在kafka的分区里是有序的,flink消费kafka分区,sink到es,怎么保持消息

大神们,数据在kafka的分区里是有序的,flink消费kafka分区,sink到es,怎么保持消息有序呢?

安装ECS、阿里云ES、阿里云Logstash、阿里云消息队列Kafka 时需要注意什么?

安装 Filebeat 的 ECS、阿里云 ES、阿里云 Logstash、阿里云消息队列 Kafka 时需要注意什么?

本页面内关键词为智能算法引擎基于机器学习所生成,如有任何问题,可在页面下方点击"联系我们"与我们沟通。

云消息队列 Kafka 版es相关内容

云消息队列 Kafka 版您可能感兴趣

- 云消息队列 Kafka 版数据

- 云消息队列 Kafka 版python

- 云消息队列 Kafka 版hologres

- 云消息队列 Kafka 版java

- 云消息队列 Kafka 版字段

- 云消息队列 Kafka 版flink

- 云消息队列 Kafka 版mysql

- 云消息队列 Kafka 版功能

- 云消息队列 Kafka 版阿里云

- 云消息队列 Kafka 版组件

- 云消息队列 Kafka 版cdc

- 云消息队列 Kafka 版消费

- 云消息队列 Kafka 版分区

- 云消息队列 Kafka 版集群

- 云消息队列 Kafka 版配置

- 云消息队列 Kafka 版报错

- 云消息队列 Kafka 版同步

- 云消息队列 Kafka 版apache

- 云消息队列 Kafka 版安装

- 云消息队列 Kafka 版消息队列

- 云消息队列 Kafka 版topic

- 云消息队列 Kafka 版消息

- 云消息队列 Kafka 版sql

- 云消息队列 Kafka 版入门

- 云消息队列 Kafka 版消费者

- 云消息队列 Kafka 版实战

- 云消息队列 Kafka 版原理