【深度学习】实验13 使用Dropout抑制过拟合 2

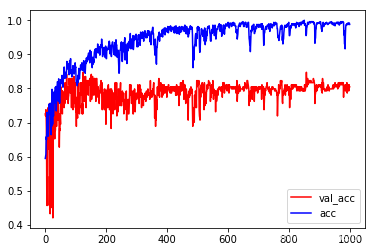

4.3 训练模型history = model.fit(x_train, y_train, epochs=1000, validation_data=(x_test, y_test)) Train on 489 samples, validate on 164 samples Epoch 1/100...

【深度学习】实验13 使用Dropout抑制过拟合 1

使用Dropout抑制过拟合Dropout是一种常用的神经网络正则化方法,主要用于防止过拟合。在深度学习中,由于网络层数过多,参数数量庞大,模型容易过拟合,并且在测试时产生较大的泛化误差。Dropout方法借鉴了集成学习中的Bagging思想,通过随机的方式,将一部分神经元的输出设置为0...

【深度学习】改进Hinton的Dropout:可以用来减轻欠拟合了

前言深度学习三巨头之一 Geoffrey Hinton 在 2012 年提出的 dropout 主要用来解决过拟合问题,但近日的一项工作表明,dropout 能做的事情不止于此。正文2012 年,Hinton 等人在其论文《Improving neural networks by preventin...

深度学习基础入门篇[六(1)]:模型调优:注意力机制[多头注意力、自注意力],正则化【L1、L2,Dropout,Drop Connect】等

深度学习基础入门篇[六(1)]:模型调优:注意力机制[多头注意力、自注意力],正则化【L1、L2,Dropout,Drop Connect】等1.注意力机制在深度学习领域,模型往往需要接收和处理大量的数据,然而在特定的某个时刻,往往只有少部分的某些数据是重要的,这种情况就非常适合Attention机...

# 【深度学习】:《PyTorch入门到项目实战》第九天:Dropout实现

✨本文收录于【深度学习】:《PyTorch入门到项目实战》专栏,此专栏主要记录如何使用PyTorch实现深度学习笔记,尽量坚持每周持续更新,欢迎大家订阅!个人主页:JoJo的数据分析历险记个人介绍:小编大四统计在读,目前保研到统计学top3高校继续攻读统计研究生如果文章对你有帮助,欢迎✌关注、点赞、...

深度学习入门基础CNN系列——批归一化(Batch Normalization)和丢弃法(dropout)

想要入门深度学习的小伙伴们,可以了解下本博主的其它基础内容:我的个人主页深度学习入门基础CNN系列——卷积计算深度学习入门基础CNN系列——填充(padding)与步幅(stride)深度学习入门基础CNN系列——感受野和多输入通道、多输出通道以及批量操作基本概念 深度学习入门基础CNN系列——池化...

【深度学习】Dropout原理以及代码实现

Drouout起源随着深度学习的发展,各种网络结构层出不穷,导致网络越来越深,数据的容纳量越来越大,模型的参数也越来越多,这样就会导致神经网络很容易过拟合,过拟合的模型几乎是不能用于实践中的,因为拟合的数据与测试数据不一致,导致模型的泛化性能较低。由于这个问题,现在有很多...

【从零开始学习深度学习】14. 防止过拟合方法:Dropout方法介绍及示例演示

1 Dropout丢弃法1.1 方法1.2 从零开始实现带dropout的根据丢弃法的定义,下面我们去实现它。下面的dropout函数将以drop_prob的概率丢弃X中的元素。%matplotlib inline import torch import torch.nn as nn import ...

深度学习网络大杀器之Dropout——深入解析Dropout

首发地址:https://yq.aliyun.com/articles/68901 更多深度文章,请关注云计算频道:https://yq.aliyun.com/cloud 过拟合是深度神经网(DNN)中的一个常见问题:模型只学会在训练集上分类,这些年提出的许多过拟合问题的解决方案;其中dropout...

深度学习网络大杀器之Dropout——深入解析Dropout

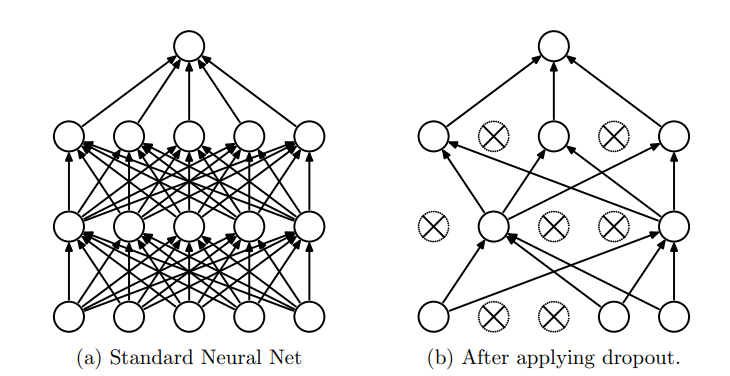

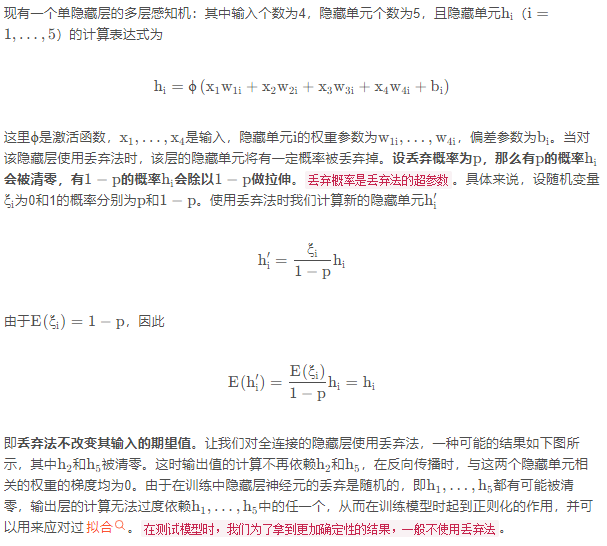

过拟合是深度神经网(DNN)中的一个常见问题:模型只学会在训练集上分类,这些年提出的许多过拟合问题的解决方案;其中dropout具有简单性并取得良好的结果: Dropout 上图为Dropout的可视化表示,左边是应用Dropout之前的网络,右边是应用了Dropout的同一个网络。 Dropout...

本页面内关键词为智能算法引擎基于机器学习所生成,如有任何问题,可在页面下方点击"联系我们"与我们沟通。

产品推荐

社区圈子

最佳实践