细数NLP与CV的融合创新:盘点多模态深度学习这几年

本文概述了最先进的多模态深度学习研究中使用的各类方法。近年来,NLP 和 CV 领域在方法上突破不断。不只是单模态模型有所进展,而大规模多模态方法也已经成为非常热门的研究领域。论文地址:https://arxiv.org/pdf/2301.04856v1.pdf项目地址:https://github...

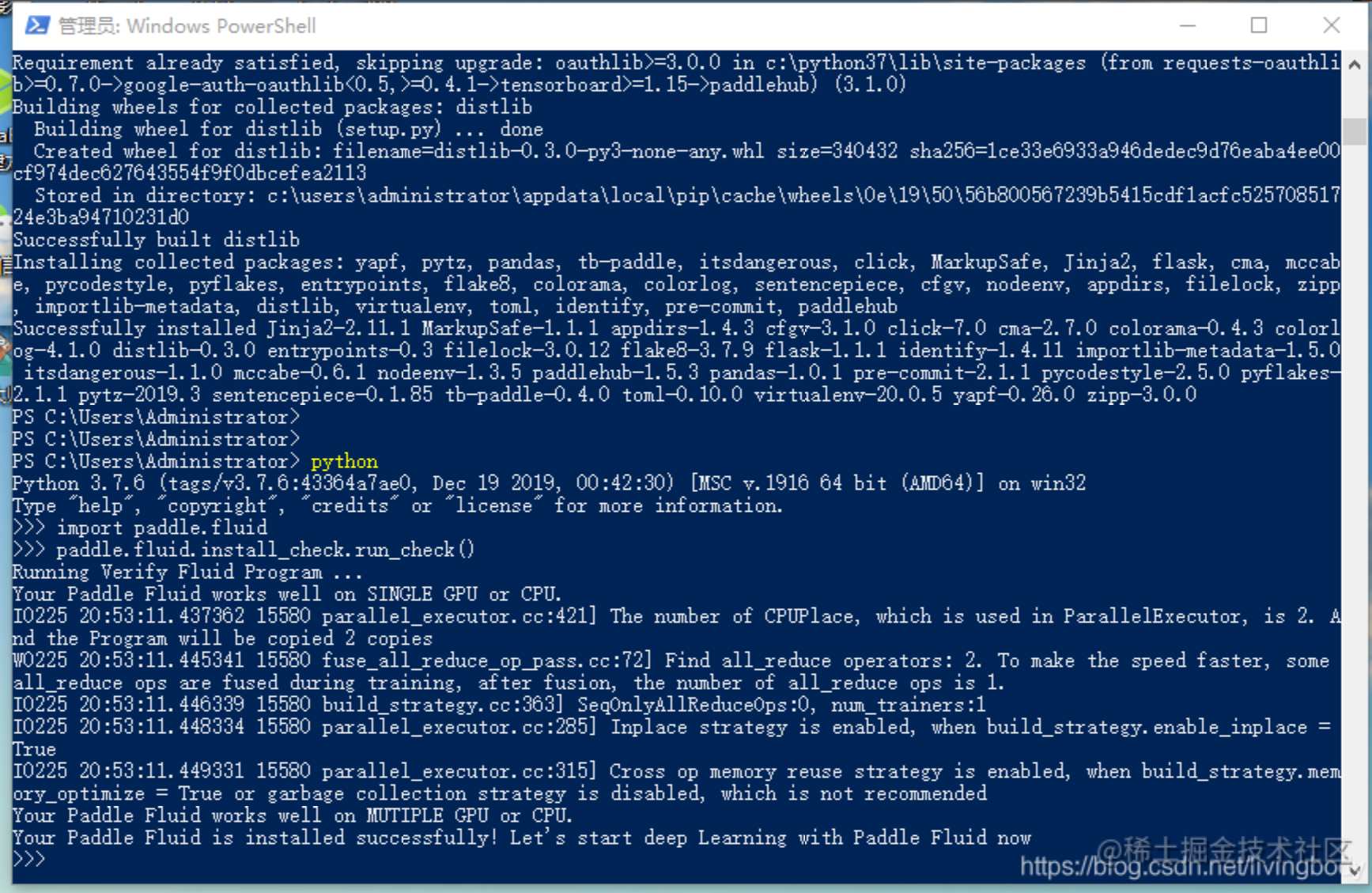

作业帖 | NLP+推荐-深度学习集训营 【第一次作业】

AI Studio 用户名: javaroom作业 1-1 :( 1 ) paddlepaddle 安装pip3 install paddlepaddle -i https://pypi.tuna.tsinghua.edu.cn/simple ( 2 )学习使用 PaddleNLP 下面的...

NLP:LSTM之父眼中的深度学习十年简史《The 2010s: Our Decade of Deep Learning / Outlook on the 2020s》的参考文献

目录The 2010s: Our Decade of Deep Learning / Outlook on the 2020sReferences Beyond Those in Reference [MIR]Selected References from Reference ...

斯坦福NLP课程 | 第20讲 - NLP与深度学习的未来

作者:韩信子@ShowMeAI,路遥@ShowMeAI,奇异果@ShowMeAI教程地址:http://www.showmeai.tech/tutorials/36本文地址:http://www.showmeai.tech/article-detail/258声明:版权所有,转载请联系平台与作者并注...

动手学深度学习(十四) NLP注意力机制和Seq2seq模型(下)

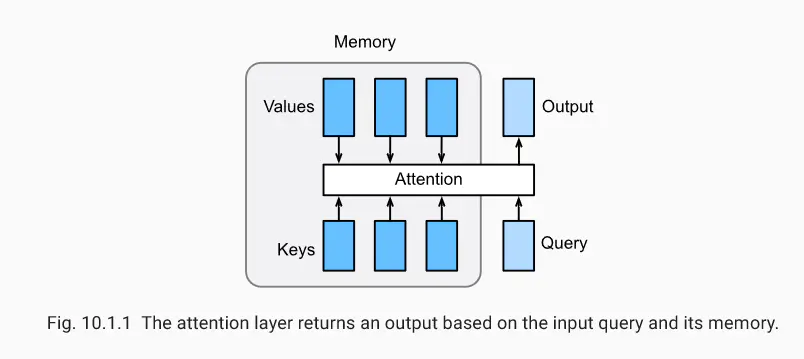

引入注意力机制的Seq2seq模型本节中将注意机制添加到sequence to sequence 模型中,以显式地使用权重聚合states。下图展示encoding 和decoding的模型结构,在时间步为t的时候。此刻attention layer保存着encodering看到的所有信息——即en...

动手学深度学习(十四) NLP注意力机制和Seq2seq模型(上)

注意力机制在“编码器—解码器(seq2seq)”⼀节⾥,解码器在各个时间步依赖相同的背景变量(context vector)来获取输⼊序列信息。当编码器为循环神经⽹络时,背景变量来⾃它最终时间步的隐藏状态。将源序列输入信息以循环单位状态编码,然后将其传递给解码器以生成目标序列。然而这种结构存在着问题...

动手学深度学习(十三) NLP机器翻译(下)

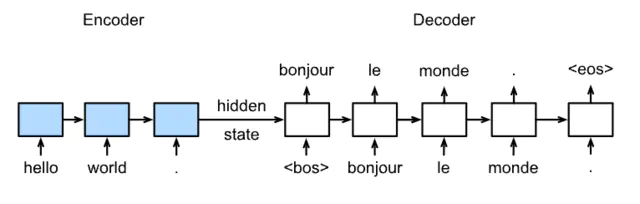

Sequence to Sequence模型模型:训练Image Name预测Image Name具体结构:Image NameEncoderclass Seq2SeqEncoder(d2l.Encoder): def __init__(self, vocab_size, embed_size, n...

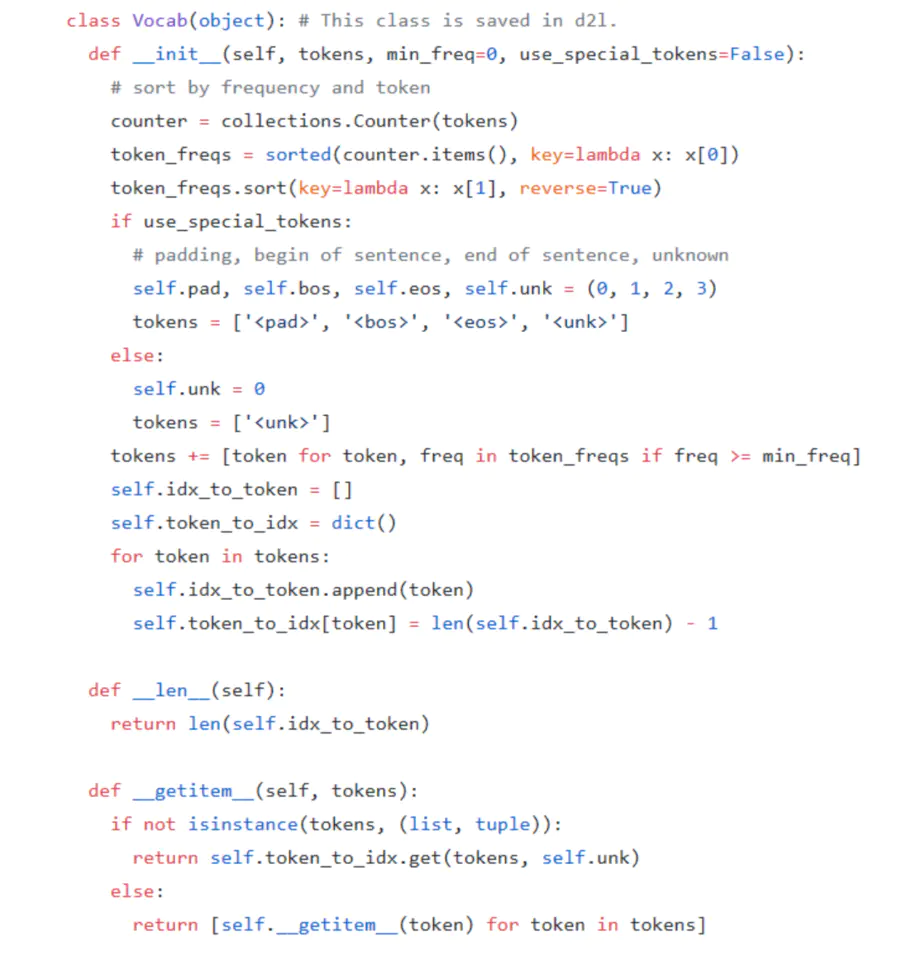

动手学深度学习(十三) NLP机器翻译(上)

机器翻译和数据集机器翻译(MT):将一段文本从一种语言自动翻译为另一种语言,用神经网络解决这个问题通常称为神经机器翻译(NMT)。主要特征:输出是单词序列而不是单个单词。 输出序列的长度可能与源序列的长度不同。import os os.listdir('/home/kesci/input/&...

动手学深度学习(十二) NLP循环神经网络进阶(下)

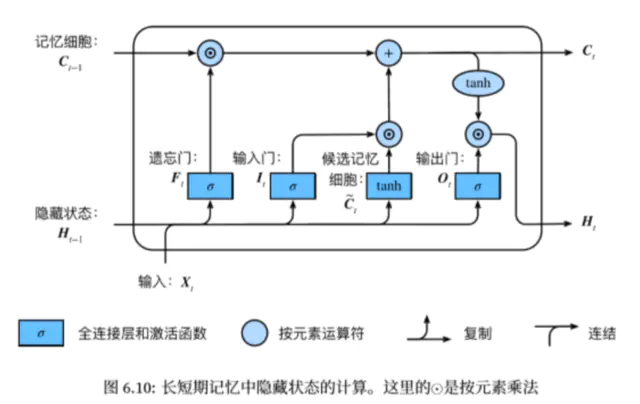

LSTM** 长短期记忆long short-term memory **:遗忘门:控制上一时间步的记忆细胞输入门:控制当前时间步的输入输出门:控制从记忆细胞到隐藏状态记忆细胞:⼀种特殊的隐藏状态的信息的流动Image Name初始化参数num_inputs, num_hiddens, num_ou...

动手学深度学习(十二) NLP循环神经网络进阶(上)

GRURNN存在的问题:梯度较容易出现衰减或爆炸(BPTT)⻔控循环神经⽹络:捕捉时间序列中时间步距离较⼤的依赖关系RNN:Image NameGRU:Image Name• 重置⻔有助于捕捉时间序列⾥短期的依赖关系;• 更新⻔有助于捕捉时间序列⾥⻓期的依赖关系。载入数据集import os os....

本页面内关键词为智能算法引擎基于机器学习所生成,如有任何问题,可在页面下方点击"联系我们"与我们沟通。

产品推荐

社区圈子

最佳实践