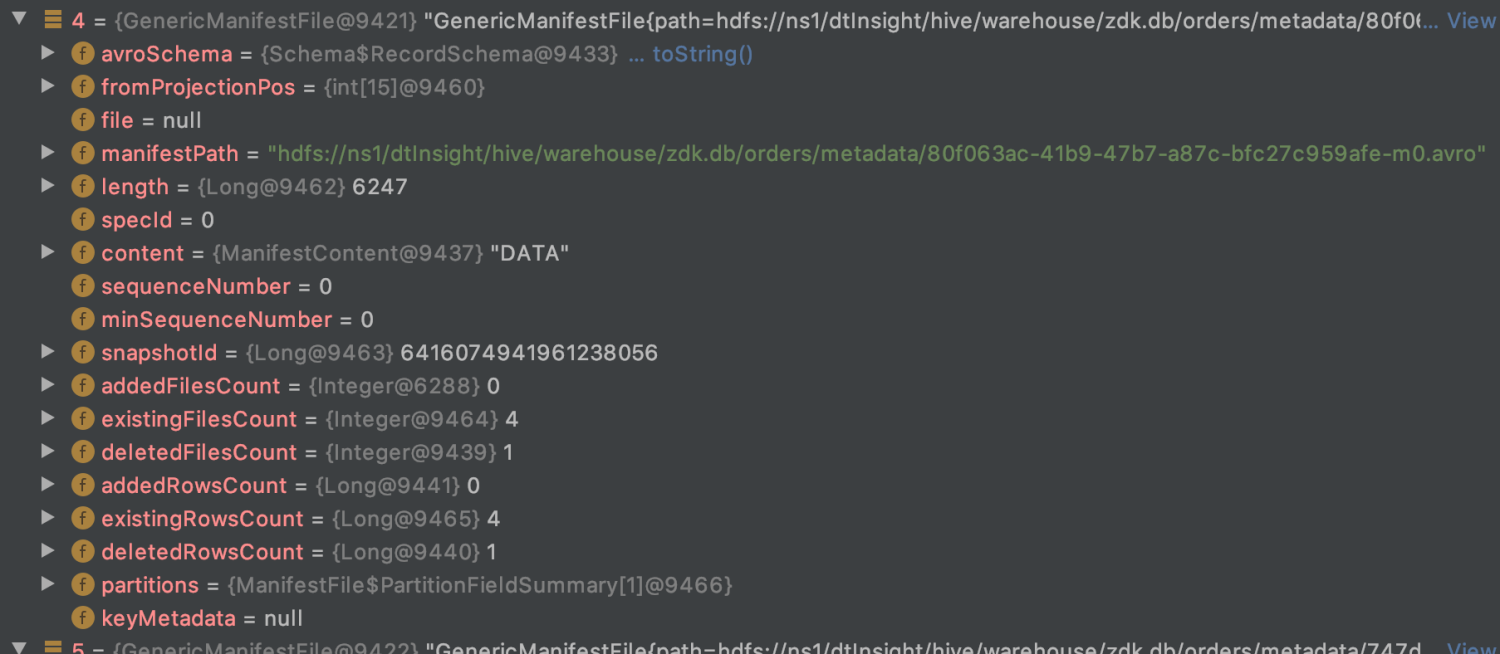

flink 读取iceberg 表数据流程

一.执行建立表语句CREATE TABLE IF NOT EXISTS iceberg_hive.db1.sink6 ( order_id INTEGER COMMENT 'unique id', `order_date` DATE , `order_time` TIMESTAMP(3), `qua...

flink cdc 的join 是真的把维表数据都加载到rocksdb里了吗?

flink cdc 的join 是真的把维表数据都加载到rocksdb里了吗?

麻烦问下,flink表数据会删除或者过期吗?我需要针对全量和增量的数据做聚合操作

麻烦问下,flink表数据会删除或者过期吗?我需要针对全量和增量的数据做聚合操作

请问flink mysql cdc 全量读取mysql某个表数据,对原始的mysql数据库有影响吗

请问flink mysql cdc 全量读取mysql某个表数据,对原始的mysql数据库有影响吗

Flink SQL>查询的hive表数据全L部为NUL

Flink SQL>select * from table1; 在Flink客户端查询hive数据,结果每个字段全为NULL,但数据条数是对的,select count是正确的,查具体数据就是NULL,不知何故?同样的查询在hive客户端是可以查到数据的 hive表时orc文件load的数据。...

flink 1.11.1 与HDP3.0.1中的hive集成,查询不出hive表数据怎么办?

我使用的环境是HDP3.0.1的沙盒,flink是最新版本的1.11.1,从官网直接下载的编译好的jar包。我想测试flink与hive的集成,包括查询hive表的数据、写入数据到hive表等操作。目前我遇到问题就是通过flink sql client查询不出表数据,并且也不报错。但是该表在hive...

flink 1.13.1 读取hive orc格式表数据,报数组越界错误

at org.apache.orc.impl.TreeReaderFactory$TreeReader.nextVector(TreeReaderFactory.java:269) ~[flink-sql-connector-hive-1.2.2_2.11-1.13.1.jar:1.13.1] at...

如何通过Flink将Iceberg表数据写入到阿里云OSS

版本要求我在以下两个环境下都验证过flink的读写流程:环境一hadoop == 3.1.0hive == 3.1.2 apache flink == 1.12.1环境二hadoop == 2.9.2hive == 2.3.6flink == 1.12.1依赖环境验证hadoop包读取oss文件第一...

维表如果是存储在hbase,主流跟hbase关联的时候,维表数据发生变化(比如新增) 关#Flink

维表如果是存储在hbase,主流跟hbase关联的时候,维表数据发生变化(比如新增) 关联是否是最新的维表信息? #Flink

本页面内关键词为智能算法引擎基于机器学习所生成,如有任何问题,可在页面下方点击"联系我们"与我们沟通。

实时计算 Flink版表数据相关内容

实时计算 Flink版您可能感兴趣

- 实时计算 Flink版设置

- 实时计算 Flink版数据

- 实时计算 Flink版窗口

- 实时计算 Flink版作业

- 实时计算 Flink版内置函数

- 实时计算 Flink版jar

- 实时计算 Flink版udf

- 实时计算 Flink版项目

- 实时计算 Flink版逻辑

- 实时计算 Flink版运行

- 实时计算 Flink版CDC

- 实时计算 Flink版SQL

- 实时计算 Flink版mysql

- 实时计算 Flink版报错

- 实时计算 Flink版同步

- 实时计算 Flink版任务

- 实时计算 Flink版oracle

- 实时计算 Flink版版本

- 实时计算 Flink版kafka

- 实时计算 Flink版表

- 实时计算 Flink版实时计算

- 实时计算 Flink版flink

- 实时计算 Flink版配置

- 实时计算 Flink版Apache

- 实时计算 Flink版 CDC

- 实时计算 Flink版模式

- 实时计算 Flink版数据库