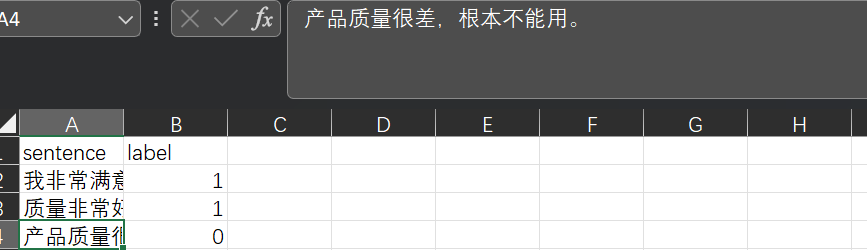

训练你自己的自然语言处理深度学习模型,Bert预训练模型下游任务训练:情感二分类

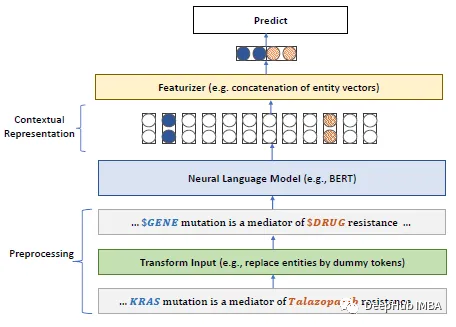

基础介绍:Bert模型是一个通用backbone,可以简单理解为一个句子的特征提取工具更直观来看:我们的自然语言是用各种文字表示的,经过编码器,以及特征提取就可以变为计算机能理解的语言了下游任务:提取特征后,我们便可以自定义其他自然语言处理任务了,以下是一个简单的示例(效果可能不好,但算是一个基本流...

19ContraBERT:顶会ICSE23 数据增强+对比学习+代码预训练模型,提升NLP模型性能与鲁棒性:处理程序变异(变量重命名)【网安AIGC专题11.15】

写在最前面随着大规模代码的崛起,无监督学习成为了提高代码预训练模型性能的有效手段。这些预训练模型在广泛的下游任务中表现出色,如自然语言处理和程序语言处理。例如,像CodeBERT和GraphCodeBERT这样的模型在预训练阶段通过大规模代码数据学到通用的表示,并在下游任务上进行微调,取得了优于传统...

PubMedBERT:生物医学自然语言处理领域的特定预训练模型

论文的主要要点如下: 对于具有大量未标记文本的特定领域,如生物医学,从头开始预训练语言模型比持续预训练通用领域语言模型效果显著。提出了生物医学语言理解与推理基准(BLURB)用于特定领域的预训练。 PubMedBERT 1、特定领域Pretraining 研究表明,从头开始的特定领域预训练大大优于通...

人工智能领域:面试常见问题超全(深度学习基础、卷积模型、对抗神经网络、预训练模型、计算机视觉、自然语言处理、推荐系统、模型压缩、强化学习、元学习)

人工智能领域:面试常见问题 1.深度学习基础 为什么归一化能够提高求解最优解的速度?为什么要归一化?归一化与标准化有什么联系和区别?归一化有哪些类型?Min-max归一化一般在什么情况下使用?Z-score归一化在什么情况下使用?学习率过大或过小对网络会有什么影响?batch size...

NLP领域任务如何选择合适预训练模型以及选择合适的方案【规范建议】

1.常见NLP任务信息抽取:从给定文本中抽取重要的信息,比如时间、地点、人物、事件、原因、结果、数字、日期、货币、专有名词等等。通俗说来,就是要了解谁在什么时候、什么原因、对谁、做了什么事、有什么结果。文本生成:机器像人一样使用自然语言进行表达和写作。依据输入的不同,文本生成技术主要包括数据到文本生...

预约直播 | 基于预训练模型的自然语言处理及EasyNLP算法框架

一、分享议题:基于预训练模型的自然语言处理及EasyNLP算法框架二、直播时间:2022年08月24日(周三)18:00-18:30 三、 议题介绍:此次分享将深入介绍预训练语言模型的研究进展以及各种下游自然语言理解的应用;为了解决大模型落地难问题,重点展示多种知识蒸馏、...

自然语言处理预训练模型招标中标信息抽取-高级版服务 Quick Start

使用前提:服务开通与资源包购买自然语言处理:开通地址NLP自学习平台:开通地址自学习平台资源包:购买地址获取阿里云账号的AccessKey ID 和AccessKey Secret授权子账号(无需子账号,可以忽略此步骤):RAM鉴权操作步骤:1.添加pom依赖 <dependency> ...

自然语言处理预训练模型招中标公告类型分类服务 Quick Start

使用前提:服务开通与资源包购买自然语言处理:开通地址NLP自学习平台:开通地址自学习平台资源包:购买地址获取阿里云账号的AccessKey ID 和AccessKey Secret授权子账号(无需子账号,可以忽略此步骤):RAM鉴权操作步骤:1.添加pom依赖 <dependency> ...

自然语言处理预训练模型在线客服场景客户咨询解析 Quick Start

使用前提:服务开通与资源包购买自然语言处理:开通地址NLP自学习平台:开通地址自学习平台资源包:购买地址获取阿里云账号的AccessKey ID 和AccessKey Secret授权子账号(无需子账号,可以忽略此步骤):RAM鉴权操作步骤:1.添加pom依赖 <dependency> ...

从BERT、XLNet到MPNet,细看NLP预训练模型发展变迁史

20世纪以来,自然语言处理(NLP)领域的发展涌现了许多创新和突破。NLP中许多之前机器不可能完成的任务,如阅读理解、人机对话、自动写新闻稿等,正逐渐成为现实,甚至超越了人类的表现。如果总结过去20年里,无数先辈辛劳付出带来的璀璨成果,以下3个代表性工作列入NLP名人堂,...

本页面内关键词为智能算法引擎基于机器学习所生成,如有任何问题,可在页面下方点击"联系我们"与我们沟通。