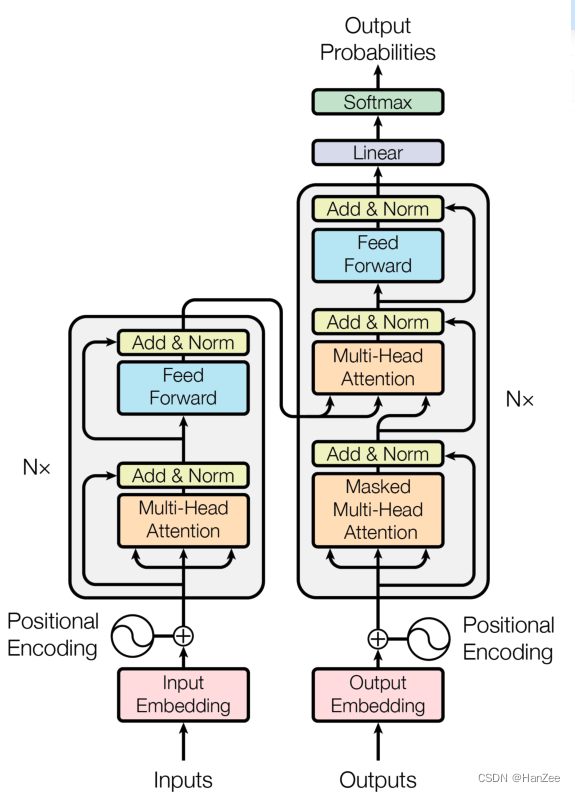

深度学习:Self-Attention与Multi-heads Attention详解

深度学习:Self-Attention与Multi-heads Attention详解IntroductionTransformer 最初是由 Ashish Vaswani等人提出的一种用以完成机器翻译的 Seq2Seq 学习任务的全新网络结构,它完全基于注意力机制来实现从序列到序列的建模。相比于以...

用深度学习(CNN RNN Attention)解决大规模文本分类问题 - 综述和实践

近来在同时做一个应用深度学习解决淘宝商品的类目预测问题的项目,恰好硕士毕业时论文题目便是文本分类问题,趁此机会总结下文本分类领域特别是应用深度学习解决文本分类的相关的思路、做法和部分实践的经验。 业务问题描述: 淘宝商品的一个典型的例子见下图,图中商品的标题是“夏装雪纺条纹短袖t恤女春半袖衣服夏天中...

2017年ACL的四个NLP深度学习趋势 (二):可解释性和注意力(Interpretability and Attention)

更多深度文章,请关注:https://yq.aliyun.com/cloud 2017年ACL的四个NLP深度学习趋势 (一):语言结构和词汇嵌入(Linguistic Structure and Word Embeddings) 趋势3:可解释性(Interpretability) 我最近一直在思...

最前沿:图文结合详解深度学习Memory & Attention

首发地址:https://yq.aliyun.com/articles/65356 本文由北邮@爱可可-爱生活 老师推荐,阿里云云栖社区组织翻译。 以下为译文: 深度学习中的记忆和注意力前沿 作者 Stephen Merity 当你有好的数据集时候,深...

最前沿:图文结合详解深度学习Memory & Attention

本文由北邮@爱可可-爱生活 老师推荐,阿里云云栖社区组织翻译。 以下为译文: 深度学习中的记忆和注意力前沿 作者 Stephen Merity 当你有好的数据集时候,深度学习在图像和文字分类方面可以给出高的精度,这是由于大数据可以很好的训练自己的分类器...

本页面内关键词为智能算法引擎基于机器学习所生成,如有任何问题,可在页面下方点击"联系我们"与我们沟通。

产品推荐

社区圈子

最佳实践