自然语言处理第3天:Word2Vec模型

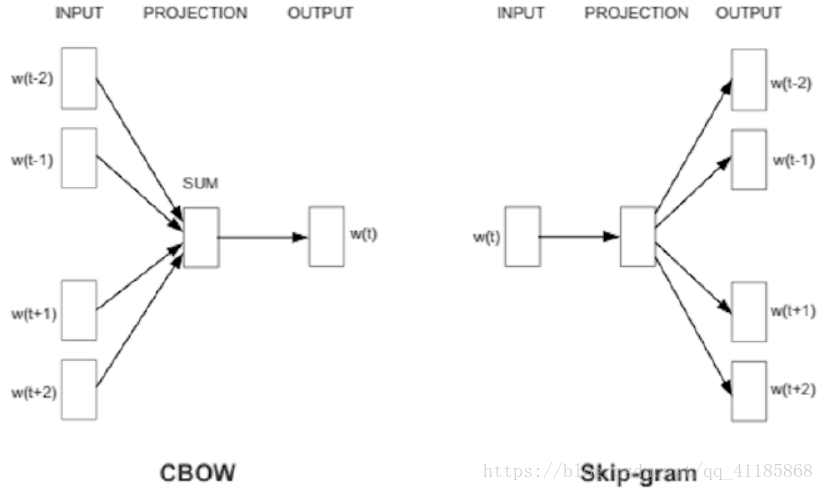

什么是语言模型语言模型的工作原理基于统计学习和概率论,其目标是捕捉语言的概率分布,即我们通过不同的任务训练模型,都是为了使语言模型获取这种概率关系,如文本生成模型,它会判断下一个应该生成什么词,一步步生成完整的文本序列Word2Vec介绍介绍Word2Vec是一个经典的语言模型,它的模型参数是一个词...

自然语言处理=======python利用word2vec实现计算词语相似度【gensim实现】

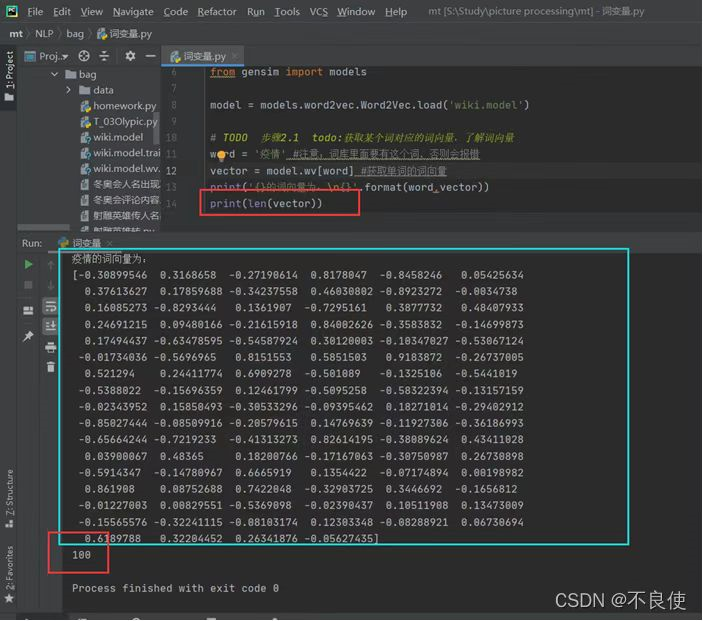

💥实验目的🚀1、要利用已训练过的词向量模型进行词语相似度计算,实验中采用的词向量模型已事先通过训练获取的。🚀2、于数据采用的是 2020 年特殊年份的数据,“疫情”是主要 话题。🚀3、在计算词语之间的相似度时,采用的词语与“疫情”相关💥实验内容🚀1、加载已训练...

【自然语言处理(NLP)】基于Skip-gram实现Word2Vec

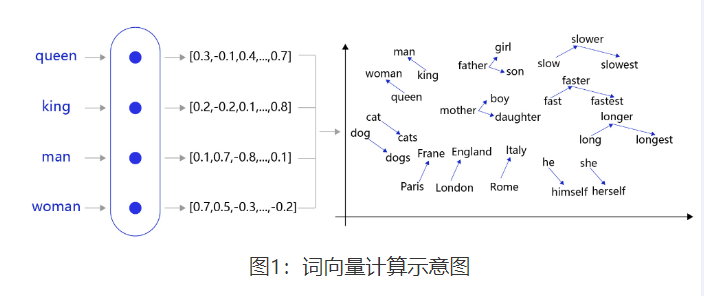

【自然语言处理(NLP)】基于Skip-gram实现Word2Vec前言什么是词向量训练?在自然语言处理任务中,词向量是表示自然语言里单词的一种方法,即把每个词都表示为一个N维空间内的点,即一个高维空间内的向量。通过这种方法,实现把自然语言计算转换为向量计算。如 图1 所示的词向量计算任务中,先把每...

②机器学习之自然语言处理——基于TfidfVectorizer和CountVectorizer及word2vec构建词向量矩阵(代码+原理)

代码实操import numpy as np from sklearn.feature_extraction.text import TfidfVectorizer from sklearn.feature_extraction.text import CountVectorizer text = ...

①机器学习之自然语言处理——基于TfidfVectorizer和CountVectorizer及word2vec构建词向量矩阵(代码+原理)

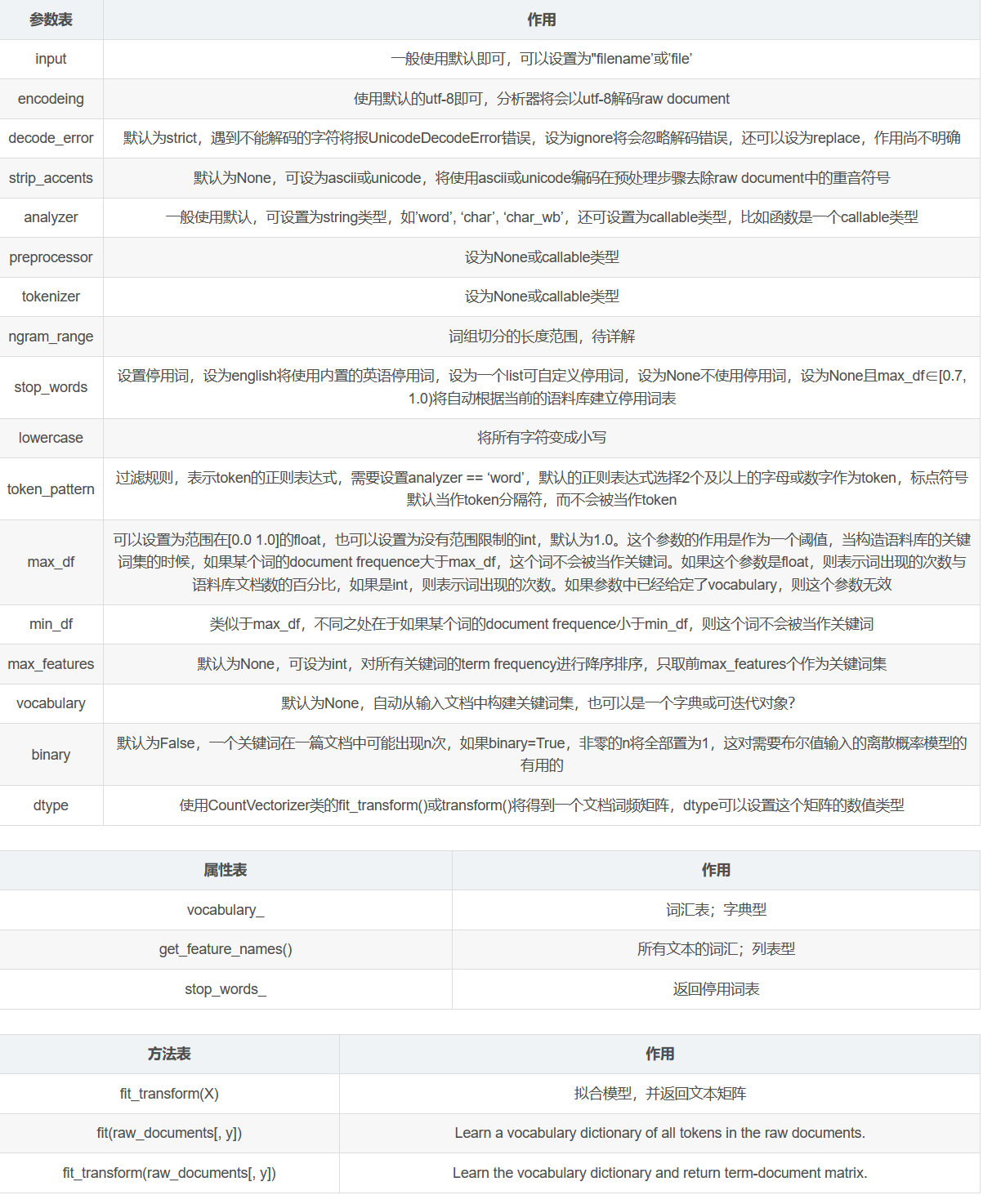

理论知识准备前期我们对分词进行了详细的讲解,那么分词之后,哪些关键词对一个文档才是重要的?比如可以通过单词出现的次数,次数越多就表示越重要。构造文本特征向量Count (文档:空格连接的字符串)TFIDF (文档:空格连接的字符串)Word2Vec (文档:...

NLP教程(1) - 词向量、SVD分解与Word2Vec

作者:韩信子@ShowMeAI教程地址:http://www.showmeai.tech/tutorials/36本文地址:http://www.showmeai.tech/article-detail/230声明:版权所有,转载请联系平台与作者并注明出处收藏ShowMeAI查看更多精彩内容本系列为...

NLP之word2vec:利用 Wikipedia Text(中文维基百科)语料+Word2vec工具来训练简体中文词向量(二)

实现代码对下边文件代码的说明#We create word2vec model use wiki Text like this https://dumps.wikimedia.org/zhwiki/20161001/zhwiki-20161001-pages-articles-multistream...

NLP之word2vec:利用 Wikipedia Text(中文维基百科)语料+Word2vec工具来训练简体中文词向量(一)

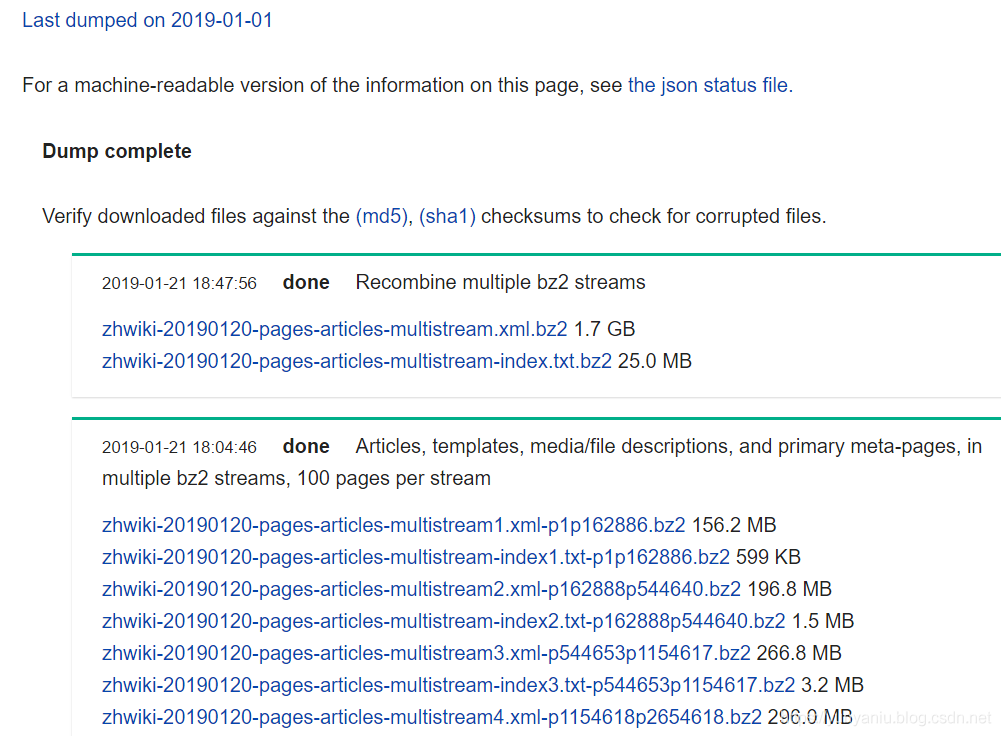

输出结果后期更新……最后的modelword2vec_wiki.model.rar设计思路后期更新……1、Wikipedia Text语料来源Wikipedia Text语料来源及其下载:zhwiki dump progress on 20190120 其中...

NLP之word2vec:word2vec简介、安装、使用方法之详细攻略

word2vec简介 word distributed embedding最早是Bengio 03年的论文"A Neural Probabilistic Language Model"提出来,rnn lm 在10年被mikolov提出。 &nb...

带你读《TensorFlow自然语言处理》之三:Word2vec——学习词嵌入

点击查看第一章点击查看第二章 第3章 Word2vec——学习词嵌入在本章中,我们将讨论NLP中一个至关重要的主题—Word2vec,这是一种学习词嵌入或单词的分布式数字特征表示(即向量)的技术。学习单词表示是许多NLP任务的基础,因为许多NLP任务依赖于能够保留其语义及其在语言中的上下文的单词的良...

本页面内关键词为智能算法引擎基于机器学习所生成,如有任何问题,可在页面下方点击"联系我们"与我们沟通。