[帮助文档] 通过Docker镜像启动Jupyter交互式环境并提交Spark作业

AnalyticDB MySQL Spark支持使用Docker镜像快速启动Jupyter交互式开发环境,帮助您使用本地Jupyter Lab连接AnalyticDB MySQL Spark,从而利用AnalyticDB MySQL的弹性资源进行交互测试和计算。

基于Docker搭建大数据集群(四)Spark部署

主要内容spark部署前提zookeeper正常使用JAVA_HOME环境变量HADOOP_HOME环境变量安装包微云下载 | tar包目录下Spark2.4.4一、环境准备上传到docker镜像docker cp spark-2.4.4-bin-hadoop2.7.tar.gz cluster-m...

docker下的spark集群,调整参数榨干硬件

欢迎访问我的GitHub这里分类和汇总了欣宸的全部原创(含配套源码):https://github.com/zq2599/blog_demos本篇概览本文是《docker下,极速搭建spark集群(含hdfs集群)》的续篇,前文将spark集群搭建成功并进行了简单的验证,但是存在以下几个小问题:sp...

docker下,极速搭建spark集群(含hdfs集群)

欢迎访问我的GitHub这里分类和汇总了欣宸的全部原创(含配套源码):https://github.com/zq2599/blog_demos搭建spark和hdfs的集群环境会消耗一些时间和精力,处于学习和开发阶段的同学关注的是spark应用的开发,他们希望整个环境能快速搭建好,从而尽快投入编码和...

D001.8 Docker搭建Spark集群(实践篇)

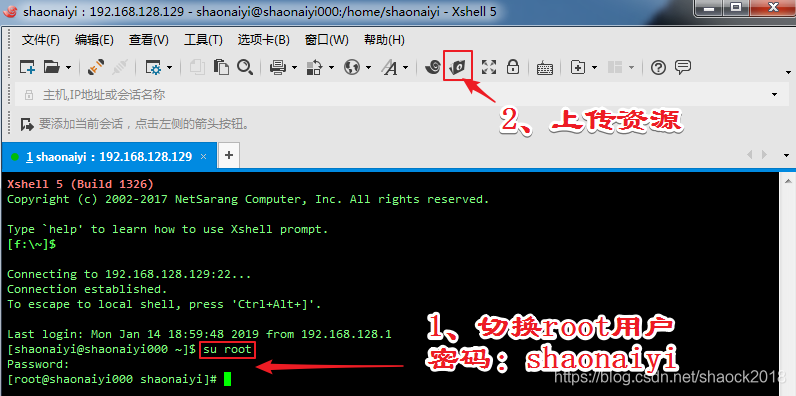

0x01 环境及资源准备1. 安装Docker请参考:D001.5 Docker入门(超级详细基础篇)的“0x01 Docker的安装”小节2. 准备资源a. 根据文末总结的文件目录结构,拷贝文章的资源,资源请参考:D001.6 Docker搭建Hadoop集群b. 模仿Hadoop自己写一份c. ...

MaxCompute Spark中用Docker容器打包的作用是什么呢?

MaxCompute Spark中用Docker容器打包的作用是什么呢?

Spark on Yarn 使用Docker Container 400 请求报错

Spark on Yarn 使用Docker Container Executor处理任务时出错ExitCodeException exitCode=1 运行命令: spark-submit --class org.apache.spark.examples.SparkPi --master yar...

Hadoop Spark docker swarm其中pyspark给出BlockMissingException但文件很好

基于https://github.com/gotthardsen/docker-hadoop-spark-workbench/tree/master/swarm我有一个带有hadoop,spark,hue和jupyter笔记本设置的docker swarm设置。使用Hue我将文件上传到hdfs,我没...

windows 基于docker下的 spark 开发环境搭建

docker toolbox https://www.docker.com/products/docker-toolbox spark https://hub.docker.com/r/singularities/spark/~/dockerfile/ # start-hadoop-namenode...

使用Docker在本地搭建hadoop,spark集群

本环境使用的单个宿主主机,而不是跨主机集群,本spark集群环境存在的意义可能在于便于本地开发测试使用,非常轻量级和便捷。这个部署过程,最好在之前有过一定的hadoop,spark集群部署经验的基础,本文重点在于docker相关的操作,至于hadoop和spark集群的部署,极力推荐这两个网页: H...

本页面内关键词为智能算法引擎基于机器学习所生成,如有任何问题,可在页面下方点击"联系我们"与我们沟通。