深度学习入门基础CNN系列——批归一化(Batch Normalization)和丢弃法(dropout)

想要入门深度学习的小伙伴们,可以了解下本博主的其它基础内容:我的个人主页深度学习入门基础CNN系列——卷积计算深度学习入门基础CNN系列——填充(padding)与步幅(stride)深度学习入门基础CNN系列——感受野和多输入通道、多输出通道以及批量操作基本概念 深度学习入门基础CNN系列——池化...

【深度学习】batch normalization和layer normalization区别

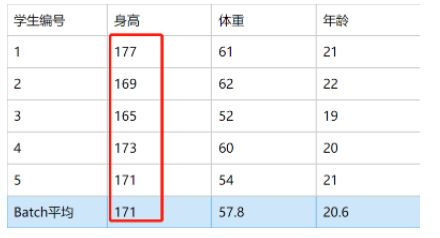

零、基础知识铺垫“独立同分布”的数据能让人很快地发觉数据之间的关系,因为不会出现像过拟合等问题。一般在模型训练之前,需要对数据做归一化。为了解决ICS问题,即internal covarivate shift(内部协变量漂移)问题,即数据分布会发生变化,对下一层网络的学习带来困难。在深度神经网络中&...

深度学习之优化详解:batch normalization

认识上图这些人吗?这些人把自己叫做“The Myth Busters”,为什么?在他们的启发下,我们才会在Paperspace做类似的事情。我们要解决是Batch Normalization(BN)是否确实解决了Internal Covariate Shift的问题。虽然Batch Normaliz...

本页面内关键词为智能算法引擎基于机器学习所生成,如有任何问题,可在页面下方点击"联系我们"与我们沟通。

社区圈子

最佳实践