[帮助文档] 在分布式训练(DLC)中挂载OSS

DLC支持将对象存储OSS类型的数据集挂载到容器的指定路径,方便您在训练过程中直接读写存储在OSS中的数据。本文为您介绍如何在DLC训练任务中挂载OSS类型的数据集。

机器学习PAI有没有配置cluster 系统自动生成分布式参数 的文档?

机器学习PAI有没有配置cluster 系统自动生成分布式参数 的文档?

机器学习PAI报错问题之跑collective gpu分布式报错如何解决

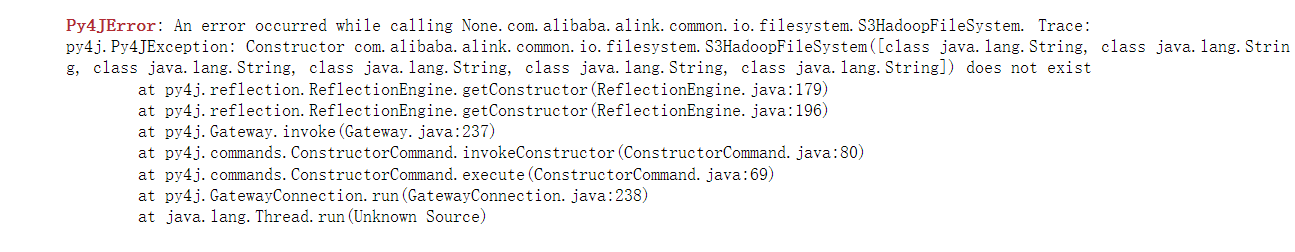

问题一:这边报错是Java类找不到,这种机器学习PAI问题该怎么解决呢? 我们在python通过S3HadoopFileSystem连接S3的时候报错,我这边是已经下载了s3-hadoop的plugin,版本号是'1.11.788' ...

机器学习PAI在分布式评估的时候,遇到了这个错误这是不是要改一下?

机器学习PAI在分布式评估的时候,遇到了这个错误这是不是要改一下?

[帮助文档] AI加速:使用TorchAcc实现Stable Diffusion模型分布式训练加速_人工智能平台 PAI(PAI)

阿里云PAI为您提供了部分典型场景下的示例模型,便于您便捷地接入TorchAcc进行训练加速。本文为您介绍如何在Stable Diffusion分布式训练中接入TorchAcc并实现训练加速。

机器学习PAI的EasyRec在使用DLC做分布式训练时得到如下错误怎么解决?

机器学习PAI的EasyRec在使用DLC做分布式训练时得到如下错误怎么解决?

想问下机器学习PAI,分布式训练时一定要设置num_steps,这一条现在还是这样吗?

想问下机器学习PAI,分布式训练时一定要设置num_steps,否则评估任务会结束不了这一条现在还是这样吗?我刚才没设置num_steps,也评估完了

机器学习PAI分布式训练有最佳实践吗,如同步/异步模式,optimizer怎么选择等 ?

机器学习PAI分布式训练有最佳实践吗,如同步/异步模式,optimizer怎么选择等 ?

机器学习PAI分布式训练同步模式时num_steps的设置方法?

机器学习PAI分布式训练同步模式时num_steps的设置方法?

机器学习PAI我们用了分布式训练(4个Worker),比单机(1个Worker),麻烦帮忙看下?

机器学习PAI我们用了分布式训练(4个Worker),比单机(1个Worker),用PAI-TF进行训练,时间上看分布式训练和单机训练是一样的(甚至还慢一些)。麻烦帮忙看下?

本页面内关键词为智能算法引擎基于机器学习所生成,如有任何问题,可在页面下方点击"联系我们"与我们沟通。

产品推荐

社区圈子

最佳实践