DataWorks中ODDS Spark链接EMR Starrocks报链接超时该如何处理?

DataWorks中ODDS Spark链接EMR Starrocks报链接超时该如何处理?

[帮助文档] Spark on MaxCompute访问Lindorm报错连接超时

使用Spark on MaxCompute访问Lindorm实例时可能会出现Connection Timeout的报错,这可能涉及Spark on MaxCompute的网络架构和数据通信方式等多方面的影响。本文介绍出现Connection Timeout报错的原因和解决方法。

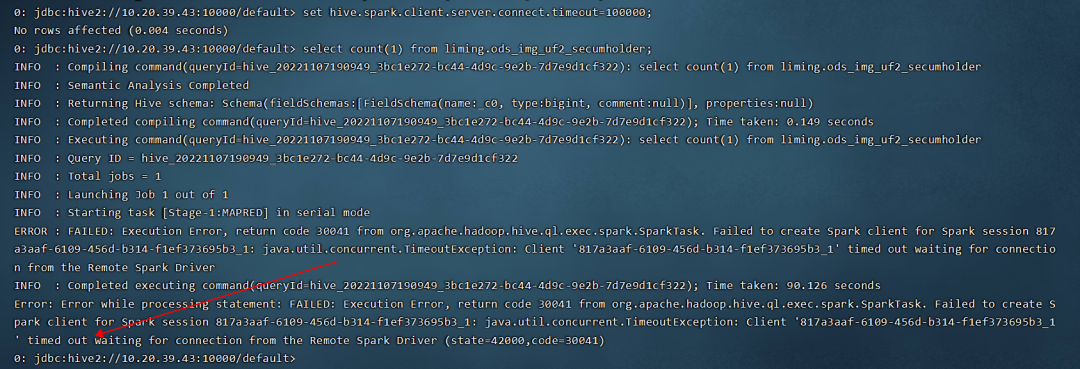

线上 hive on spark 作业执行超时问题排查案例分享

线上 hive on spark 作业执行超时问题排查案例分享大家好,在此分享一个某业务系统的线上 hive on spark 作业在高并发下频现作业失败问题的原因分析和解决方法,希望对大家有所帮助。1 问题现象某业务系统中,HIVE SQL 以 hive on spark 模式运行在 yarn上指...

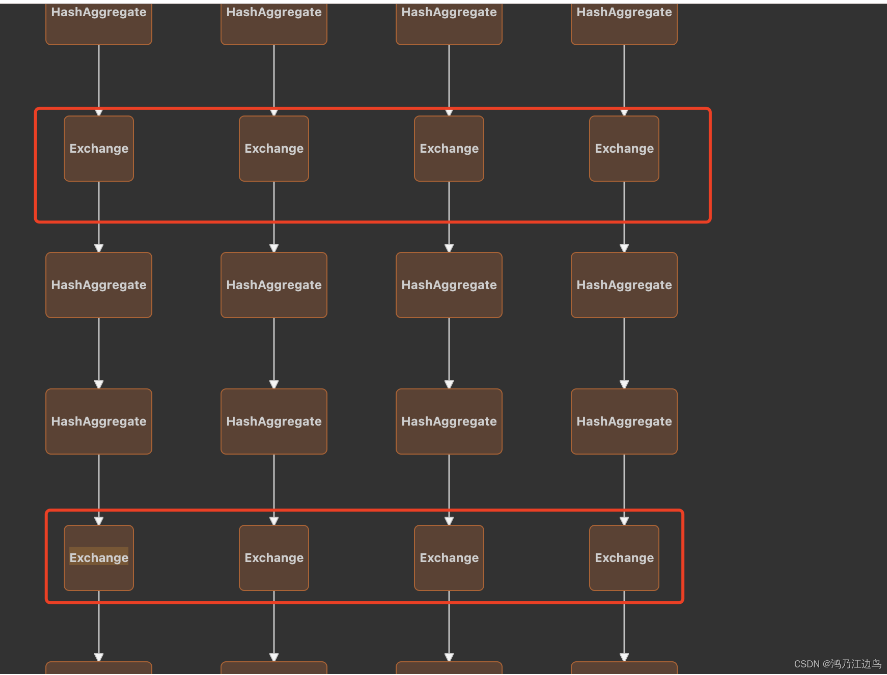

spark shuffle(ExchangeExec)过多导致任务运行过慢甚至超时

背景以及现象本文基于 spark 3.1.2设置spark.driver.memory=2g在调试spark sql任务的时候,发现有任务产生了200多个exchange,而且任务长期运行不出来。分析运行对应的sql(多个连续的join操作,且join的key都不一样),得到如下的物理计划(...

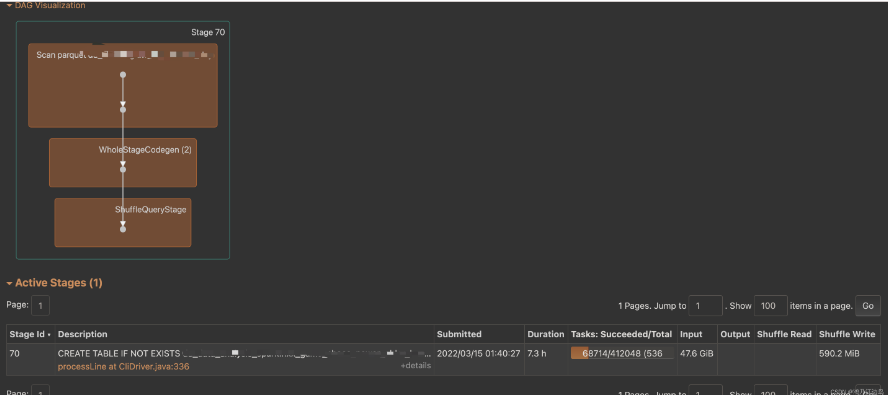

spark task过多导致任务运行过慢甚至超时

背景以及现象本文基于 spark 3.1.2设置spark.driver.memory=2g在调试spark sql任务的时候,发现有几个任务产生了40多万个Task,而且任务长期运行不出来。分析运行此sql,可以得到如下的dag(我们只截取产生Task多的Stage),由此可以看到是scan的文件...

spark程序偶尔会运行超时,怎样才能让sparksql程序如果超过一个小时就自动kill掉?

spark程序偶尔会运行超时,怎样才能让sparksql程序如果超过一个小时就自动kill掉?

【问题】spark运行python写的mapreduce任务,hadoop平台报错,java.net.ConnectException: 连接超时

问题: 用spark-submit以yarn-client方式提交任务,在集群的某些节点上的任务出现连接超时的错误,排查过各种情况后,确定在防火墙配置上出现问题。 原因: 我猜测是python程序启动后,作为Server,hadoop中资源调度是以java程序作为Client端访问, Python启...

本页面内关键词为智能算法引擎基于机器学习所生成,如有任何问题,可在页面下方点击"联系我们"与我们沟通。

社区圈子

apache spark您可能感兴趣

- apache spark Hadoop

- apache spark数据

- apache spark分析

- apache spark Python

- apache spark可视化

- apache spark数据处理

- apache spark入门

- apache spark大数据

- apache spark配置

- apache spark安装

- apache spark SQL

- apache spark streaming

- apache spark Apache

- apache spark rdd

- apache spark MaxCompute

- apache spark运行

- apache spark集群

- apache spark summit

- apache spark模式

- apache spark学习

- apache spark机器学习

- apache spark实战

- apache spark Scala

- apache spark flink

- apache spark程序

- apache spark操作