Flink数据源问题合集之定时扫描key如何解决

问题一:Flink中如果数据源为kafka,每条数据格式为结构化的csv格式,把接收到的数据? 求问各位大佬,Flink中如果数据源为kafka,每条数据格式为结构化的csv格式,把接收到的数据insert到hive中,能把数据源的更新和删除同步到hive吗?如何告诉flink这条数据流是inser...

Flink CDC 数据源问题合集之定时扫描key如何解决

问题一:Flink CDC中大佬们遇到数据源是Posegresql 主从集群,报一下错有遇到的吗? 请问Flink CDC中大佬们遇到数据源是Posegresql 主从集群,报一下错有遇到的吗? ...

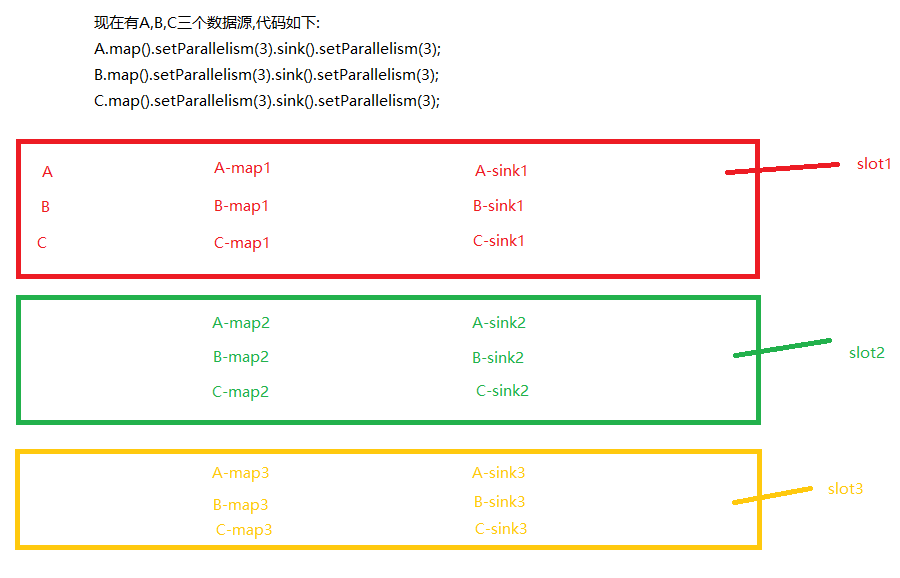

Flink中和各位大哥请教一下, 自定义redis数据源,定时扫描key,然后供下游使用, 请问下?

Flink中和各位大哥请教一下, 自定义redis数据源,定时扫描key,然后供下游使用, 请问下多并行度意义不大吧 ?

和各位大哥请教一下, Flink CDC中自定义redis数据源,定时扫描key,然后供下游使用,?

和各位大哥请教一下, Flink CDC中自定义redis数据源,定时扫描key,然后供下游使用, 请问下多并行度意义不大吧 ?

本页面内关键词为智能算法引擎基于机器学习所生成,如有任何问题,可在页面下方点击"联系我们"与我们沟通。

实时计算 Flink版您可能感兴趣

- 实时计算 Flink版内网

- 实时计算 Flink版连接超时

- 实时计算 Flink版测试

- 实时计算 Flink版数据更新

- 实时计算 Flink版告警

- 实时计算 Flink版增量

- 实时计算 Flink版源表

- 实时计算 Flink版tm

- 实时计算 Flink版表

- 实时计算 Flink版ck

- 实时计算 Flink版CDC

- 实时计算 Flink版数据

- 实时计算 Flink版SQL

- 实时计算 Flink版mysql

- 实时计算 Flink版同步

- 实时计算 Flink版报错

- 实时计算 Flink版任务

- 实时计算 Flink版oracle

- 实时计算 Flink版版本

- 实时计算 Flink版kafka

- 实时计算 Flink版配置

- 实时计算 Flink版设置

- 实时计算 Flink版 CDC

- 实时计算 Flink版模式

- 实时计算 Flink版运行

- 实时计算 Flink版数据库

- 实时计算 Flink版Yarn

- 实时计算 Flink版连接

- 实时计算 Flink版库