[帮助文档] 通过Docker镜像启动Jupyter交互式环境并提交Spark作业

AnalyticDB for MySQL Spark支持使用Docker镜像快速启动Jupyter交互式开发环境,帮助您使用本地Jupyter Lab连接AnalyticDB for MySQL Spark,从而利用AnalyticDB for MySQL的弹性资源进行交互测试和计算。

【Spark】 Spark的基础环境 Day03

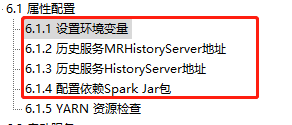

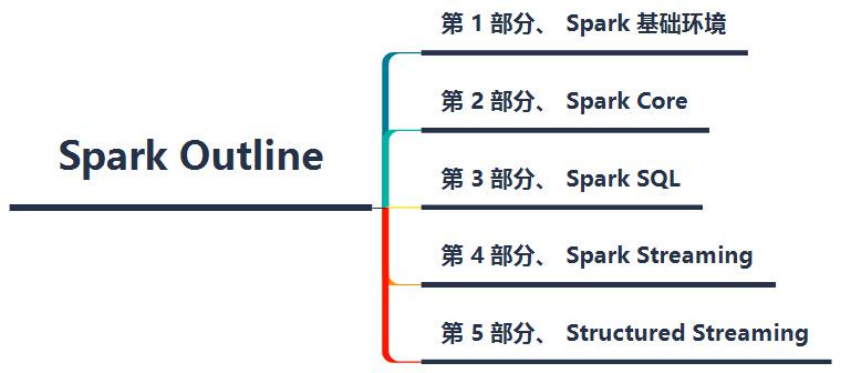

Spark Day03:Spark 基础环境02-[了解]-今日课程内容提纲主要讲解2个方面内容:Spark on YARN集群和RDD 是什么1、Spark on YARN 将Spark应用程序,提交运行到YARN集群上,企业中绝大多数运行模式,必须掌握 - 如何配置 - 提交应用运行 - Spa...

Note_Spark_Day01:Spark 基础环境

stypora-copy-images-to: imgtypora-root-url: ./Spark Day01:Spark 基础环境预习视频: https://www.bilibili.com/video/BV1uT4y1F7ap Spark:基于Scala语言 Flink:基于Java语言01...

大数据计算MaxCompute spark节点报这种错误是环境原因吗?

大数据计算MaxCompute spark节点报这种错误是环境原因吗?

window环境下安装spark

原文window环境下安装spark这个非常成功https://zhuanlan.zhihu.com/p/149469688加上参考https://blog.csdn.net/ruangaoyan/article/details/100154959完善:在Windows上安装Apache Spark...

如何在dataworks里面的odps spark节点使用pyspark环境,如何import --

如何在dataworks里面的odps spark节点使用pyspark环境,如何import --archives ARCHIVES压缩包选项里面的py文件?我看运行日志,你们会自动解压缩的,比如我的配置是--archives abc.zip,你们会生成--archives abc.zip#abc...

如何在dataworks里面的odps spark节点使用pyspark环境?

如何在dataworks里面的odps spark节点使用pyspark环境,如何import --archives ARCHIVES压缩包里面的py文件?

[帮助文档] 如何在本地搭建Spark的调试环境(以IDEA为例)

本文为您介绍如何在本地搭建Spark的调试环境(以IDEA为例)。

MaxCompute中报错是因为什么?spark文件太大吗?问题环境出在上传spark资源的时候,所

MaxCompute中报错是因为什么?spark文件太大吗? 问题环境出在上传spark资源的时候,所以任务还未提交到MaxCompute,没有logview

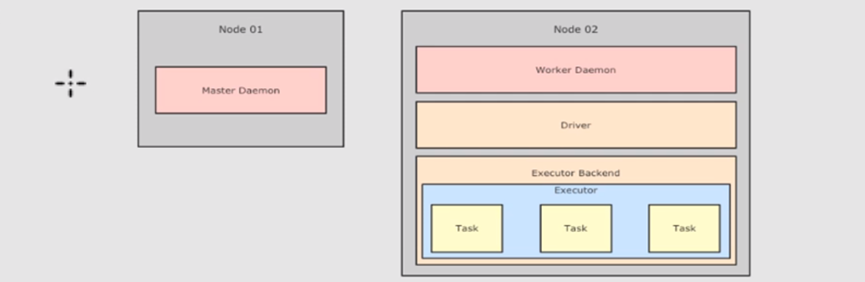

Spark 原理_总体介绍_集群环境 | 学习笔记

开发者学堂课程【大数据 Spark 2020版(知识精讲与实战演练)第三阶段:Spark 原理_总体介绍_集群环境】学习笔记,与课程紧密联系,让用户快速学习知识。课程地址:https://developer.aliyun.com/learning/course/689/detail/12006Spa...

本页面内关键词为智能算法引擎基于机器学习所生成,如有任何问题,可在页面下方点击"联系我们"与我们沟通。

社区圈子

apache spark更多环境相关

apache spark您可能感兴趣

- apache spark实验

- apache spark编程

- apache spark streaming

- apache spark SQL

- apache spark实践

- apache spark rdd

- apache spark安装使用

- apache spark Hadoop

- apache spark环境搭建

- apache spark计算

- apache spark Apache

- apache spark数据

- apache spark大数据

- apache spark MaxCompute

- apache spark运行

- apache spark summit

- apache spark集群

- apache spark模式

- apache spark分析

- apache spark学习

- apache spark机器学习

- apache spark实战

- apache spark flink

- apache spark Scala

- apache spark任务

- apache spark程序