【Hadoop】HDFS 读写流程

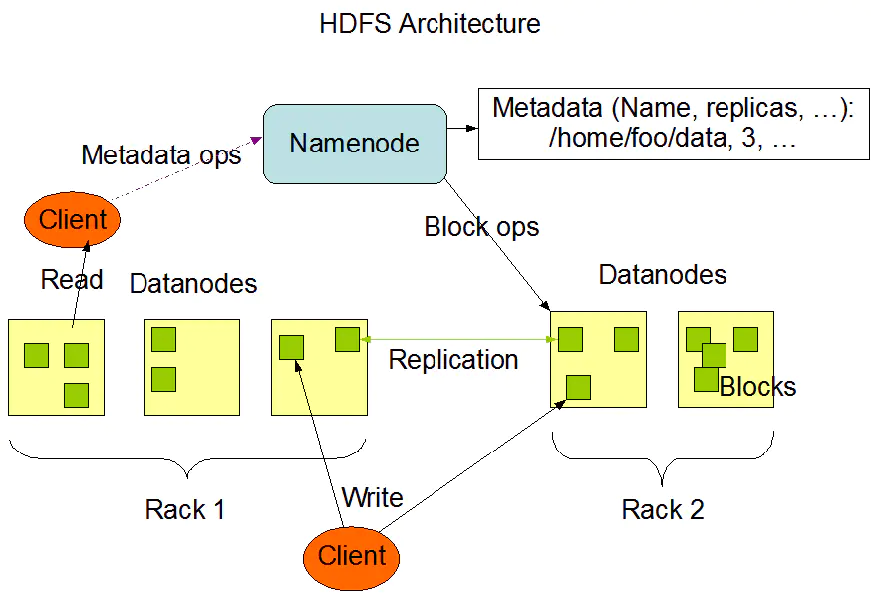

当我们谈论大数据时,就不得不提到HDFS,即Hadoop分布式文件系统。它是Apache Hadoop项目的核心组件之一,被设计用来存储和处理大规模数据集。那么,HDFS是如何实现读写数据的呢?让我来详细解析一下。 HDFS概述 在深入了解HDFS的读写流程之前,让我们先了解一下HDFS的基本概念。...

Hadoop中HDFS的读写流程(面试重点)、为什么搜不到BlockPlacementPolicyDefault、网络拓扑-节点距离计算、机架感知(副本存储节点选择)

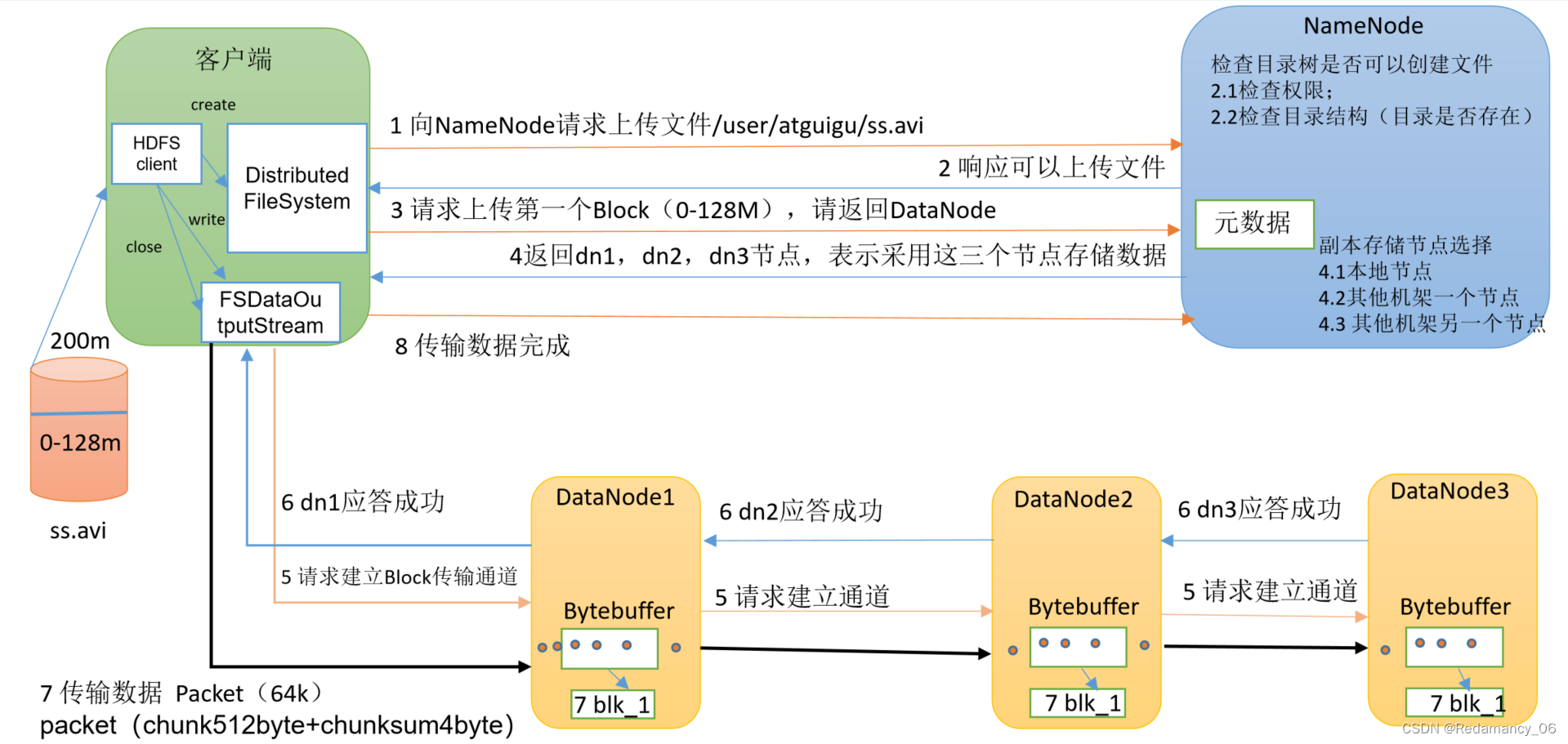

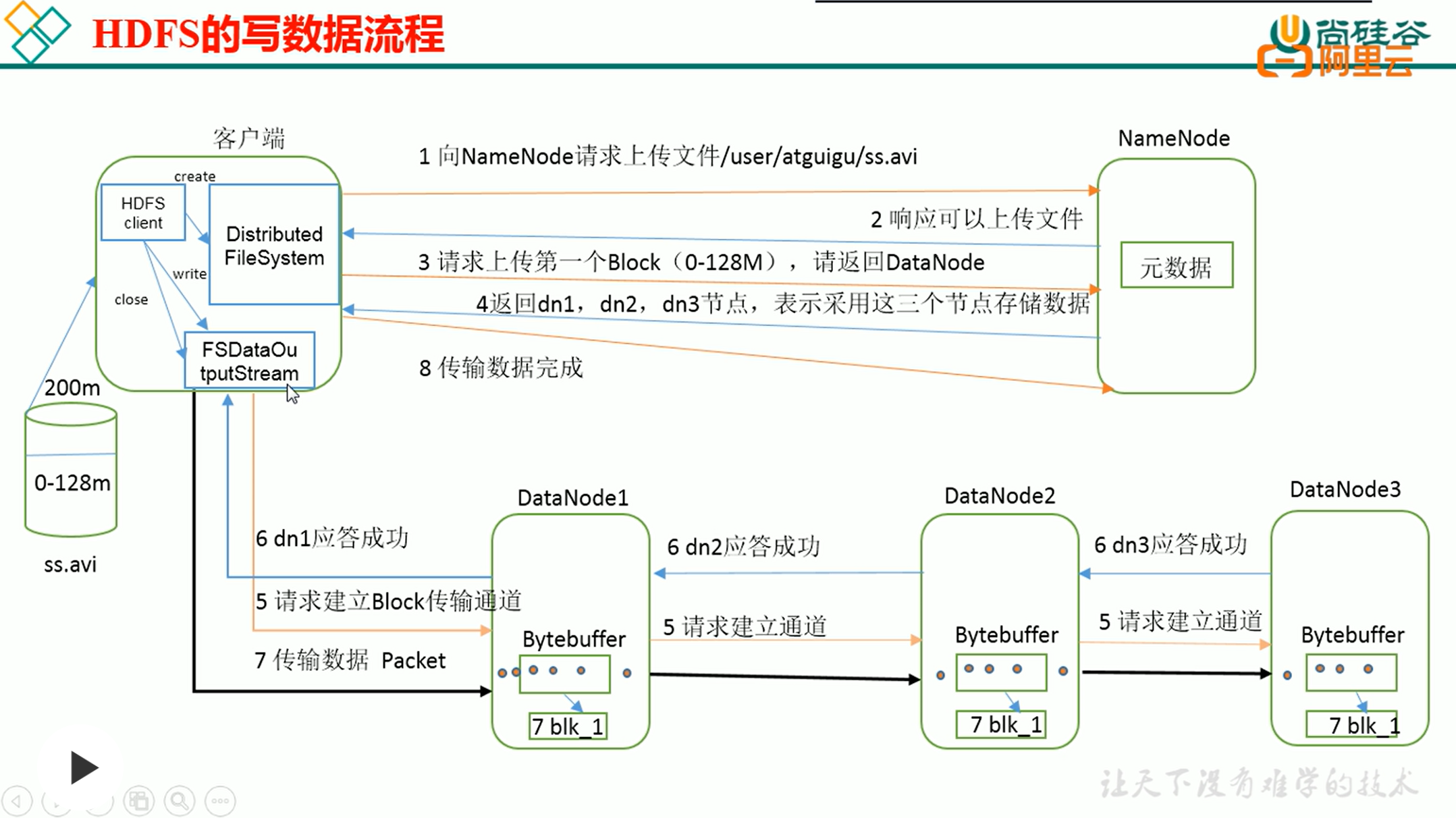

@[toc]8.HDFS的读写流程(面试重点)8.1HDFS写数据流程8.1.1剖析文件写入(1)客户端通过Distributed FileSystem模块向NameNode请求上传文件,NameNode检查目标文件是否已存在,父目录是否存在。(2)NameNode返回是否可以上传。(3)客户端请求...

Hadoop-HDFS读写流程

HDFS数据写入流程1、HDFS客户端向NameNode请求上传文件。2、NameNode判断文件是否存在,不存在返回客户端,可以上传。3、HDFS客户端切分文件,上传第一个Block文件,请求NameNode4、NameNode返回,可以上传存储的DataNode节点。5、向DataNode请求建...

Hadoop系列之HDFS初识、理论基础与读写流程

1 HDFS初识考虑这样一个问题:文件切成很多小文件块散列存储在集群中时,是如何知道每个小文件块存储的位置的呢?让我们举个例子来解释一下,假设现在有100台机器,如果有10个人拿着10批数据过来存储,那么他们可能会找到不同的人把他们的数据各自存储在不同的机器上,过了10天之后,这些人想...

Hadoop核心-HDFS读写流程

HDFS写数据步骤: 1. client发起文件上传请求,通过RPC与NameNode建立连接,NameNode检查目标文件是否已经存在,父目录是否存在,并检查用户是否有相应的权限,若检查通过, 会为该文件创建一个新的记录,否则的话文件创建失败,客户端得到异常信息, 2. client通过请求Nam...

本页面内关键词为智能算法引擎基于机器学习所生成,如有任何问题,可在页面下方点击"联系我们"与我们沟通。

hadoop您可能感兴趣

- hadoop集群

- hadoop flink

- hadoop secondarynamenode

- hadoop硬件

- hadoop hdfs

- hadoop高可靠

- hadoop sql

- hadoop产品

- hadoop任务

- hadoop ecs

- hadoop大数据

- hadoop安装

- hadoop配置

- hadoop mapreduce

- hadoop spark

- hadoop分布式

- hadoop学习

- hadoop文件

- hadoop yarn

- hadoop hive

- hadoop搭建

- hadoop命令

- hadoop数据

- hadoop hbase

- hadoop系统

- hadoop部署

- hadoop运行

- hadoop启动