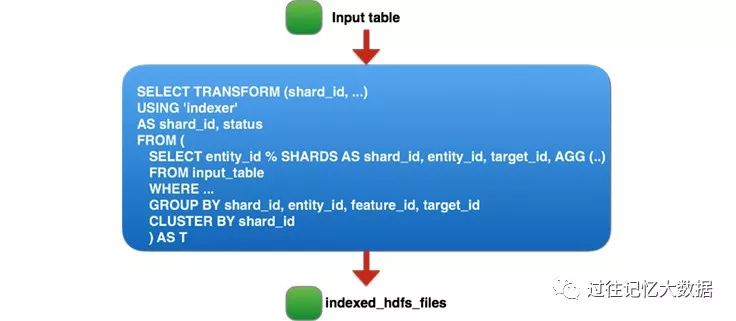

60TB 数据量的作业从 Hive 迁移到 Spark 在 Facebook 的实践

Facebook 经常使用分析来进行数据驱动的决策。在过去的几年里,用户和产品都得到了增长,使得我们分析引擎中单个查询的数据量达到了数十TB。我们的一些批处理分析都是基于 Hive 平台(Apache Hive 是 Facebook 在2009年贡献给社区的)和 Corona( Facebook 内...

Bug剖析篇-"Facebook 60TB+级的Apache Spark应用案例"

前言 Facebook 60TB+级的Apache Spark应用案例,本来上周就准备看的,而且要求自己不能手机看,要在电脑上细细的看。然而终究是各种忙拖到了昨天晚上。 文章体现的工作,我觉得更像是一次挑战赛,Facebook团队通过层层加码,最终将单个Spark Batch实例跑到了6...

本页面内关键词为智能算法引擎基于机器学习所生成,如有任何问题,可在页面下方点击"联系我们"与我们沟通。

社区圈子

apache spark您可能感兴趣

- apache spark dataworks

- apache spark oom

- apache spark odps

- apache spark开发

- apache spark任务

- apache spark e-mapreduce

- apache spark streaming

- apache spark作业

- apache spark MaxCompute

- apache spark报错

- apache spark SQL

- apache spark Apache

- apache spark数据

- apache spark Hadoop

- apache spark rdd

- apache spark大数据

- apache spark运行

- apache spark集群

- apache spark summit

- apache spark模式

- apache spark分析

- apache spark机器学习

- apache spark实战

- apache spark学习

- apache spark flink

- apache spark Scala

- apache spark大数据分析