大数据计算MaxCompute的Maxcompute Spark 任务,开启动态资源调度,怎么报错?

问题一:大数据计算MaxCompute的Maxcompute Spark 任务,开启动态资源调度,怎么报错? FetchFailed(BlockManagerId(21, workera90f372b-92dd-49f9-9c01-eb3e9ca0e350cupid-11-220-53-239, 4...

基于yarn,spark任务可以配置动态资源内存和核数,flink呢?

基于yarn,spark任务可以配置动态资源内存和核数,flink呢,是任务一开始配置多大内存就是多大吗?flink不用配置核数,一个任务会使用多少核呢?

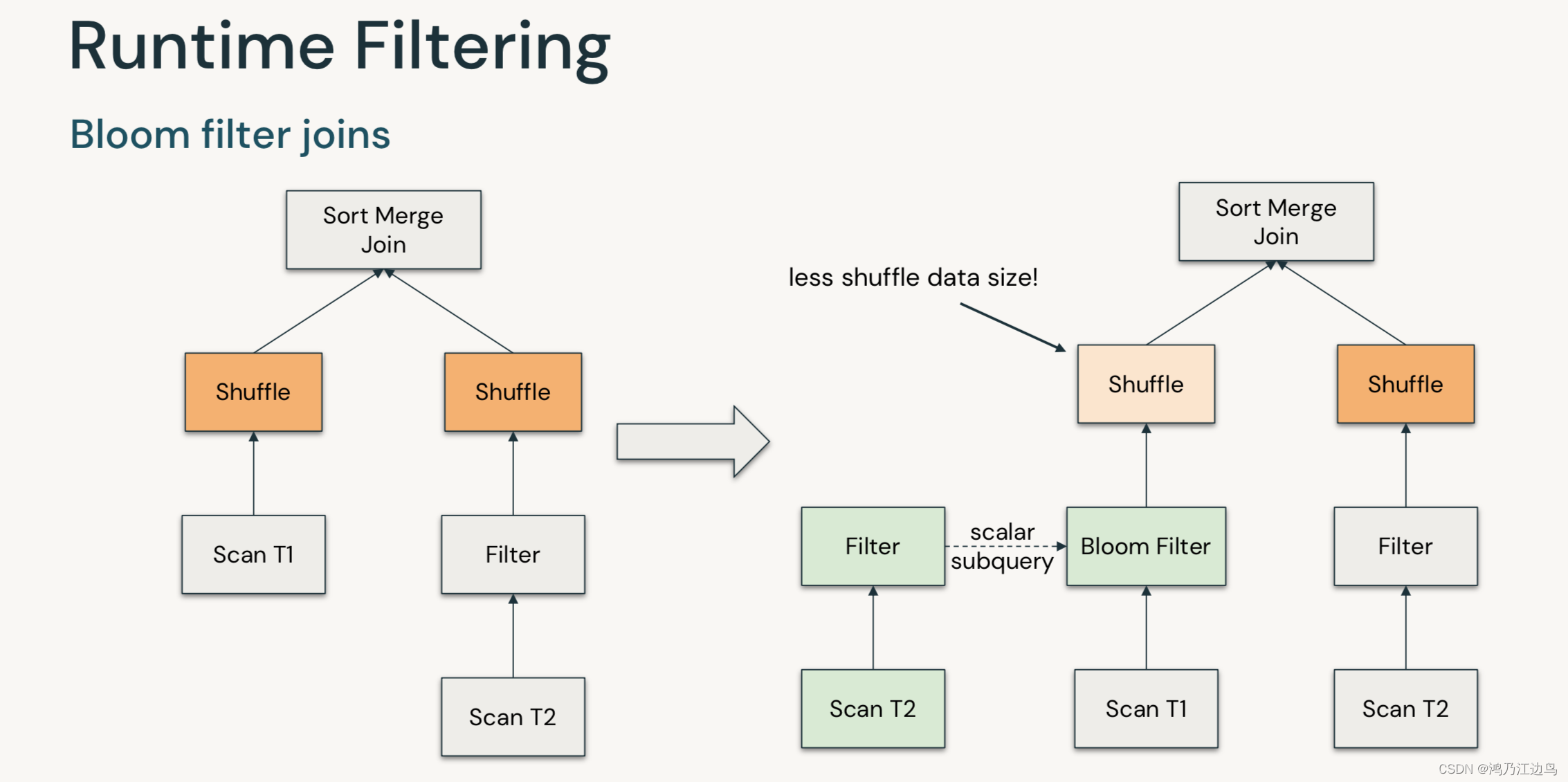

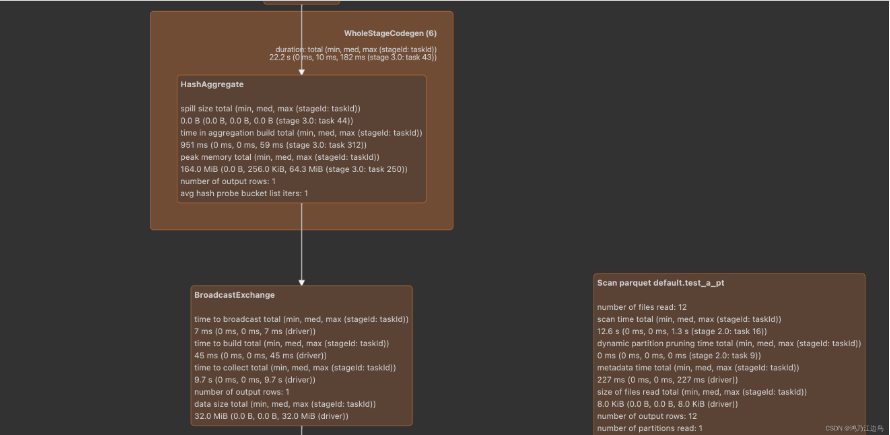

SPARK最新特性Runtime Filtering(运行时过滤)以及与动态分区裁剪的区别

背景本文基于 SPARK 3.3.0在最新发布的SPARK RELEASE,第一个显著的特性就是row-level Runtime Filtering,我们来分析一下分析直接转到对应的Jira SPARK-32268,里面涉及到的TPC benchmark,在数据行数比较大的情况下,Blo...

Spark DPP(动态分区裁剪)导致的DataSourceScanExec NullPointerException问题分析以及解决

背景本文基于spark 3.1.2,且运行在yarn模式下最近在调试 spark sql的时候遇到了空指针的问题,如下: Caused by: java.lang.NullPointerException at org.apache.spark.sql.execution.DataSourceSca...

【spark系列11】spark 的动态分区裁剪下(Dynamic partition pruning)-物理计划

背景本文基于delta 0.7.0spark 3.0.1spark 3.x引入了动态分区裁剪,在 spark 的动态分区裁剪上(Dynamic partition pruning)-逻辑计划我们提到在逻辑计划阶段会加入DynamicPruningSubquery,今天我们分析一下在物理阶段怎么对Dy...

【spark系列9】spark 的动态分区裁剪上(Dynamic partition pruning)-逻辑计划

背景本文基于delta 0.7.0spark 3.0.1spark 3.x引入了动态分区裁剪,今天我们分析以下代码是怎么实现的分析直接定位到PartitionPruning.applyPartitionPruning是逻辑计划的规则override def apply(plan: LogicalPl...

spark动态资源申请功能被禁用是在什么情况?

spark动态资源申请功能被禁用是在什么情况?

「Spark从精通到重新入门(一)」Spark 中不可不知的动态优化

前言Apache Spark 自 2010 年面世,到现在已经发展为大数据批计算的首选引擎。而在 2020 年 6 月份发布的Spark 3.0 版本也是 Spark 有史以来最大的 Release,其中将近一半的 issue 都属于 SparkSQL。这也迎合我们现在的主要场景(90% 是 SQL...

Spark 3.0中的AQE中动态优化join中的数据倾斜什么意思?

Spark 3.0中的AQE中动态优化join中的数据倾斜什么意思? 求大佬解答

Spark 3.0中的AQE中动态合并shuffle分区什么意思?

Spark 3.0中的AQE中动态合并shuffle分区什么意思? 求大佬解答

本页面内关键词为智能算法引擎基于机器学习所生成,如有任何问题,可在页面下方点击"联系我们"与我们沟通。

社区圈子

apache spark动态相关内容

apache spark您可能感兴趣

- apache spark入门

- apache spark大数据

- apache spark配置

- apache spark安装

- apache spark单机

- apache spark环境搭建

- apache spark案例

- apache spark测试

- apache spark streaming

- apache spark分布式

- apache spark SQL

- apache spark Apache

- apache spark数据

- apache spark rdd

- apache spark Hadoop

- apache spark MaxCompute

- apache spark运行

- apache spark集群

- apache spark summit

- apache spark模式

- apache spark学习

- apache spark分析

- apache spark机器学习

- apache spark实战

- apache spark Scala

- apache spark flink

- apache spark程序

- apache spark操作