OpenAI及DeepMind两团队令未来的AI机器更安全

OpenAI和DeepMind的研究人员使用的新算法从人类反馈中学习,他们希望这样做能使人工智能更安全。 两家公司均为强化学习的专家,强化学习是机器学习的一个领域,其基本思想是,如果代理在特定的环境里采取正确的行动完成了任务就给予奖励。该目标是通过一种算法来指定的,代理经过程序后就会追逐奖励,例如游...

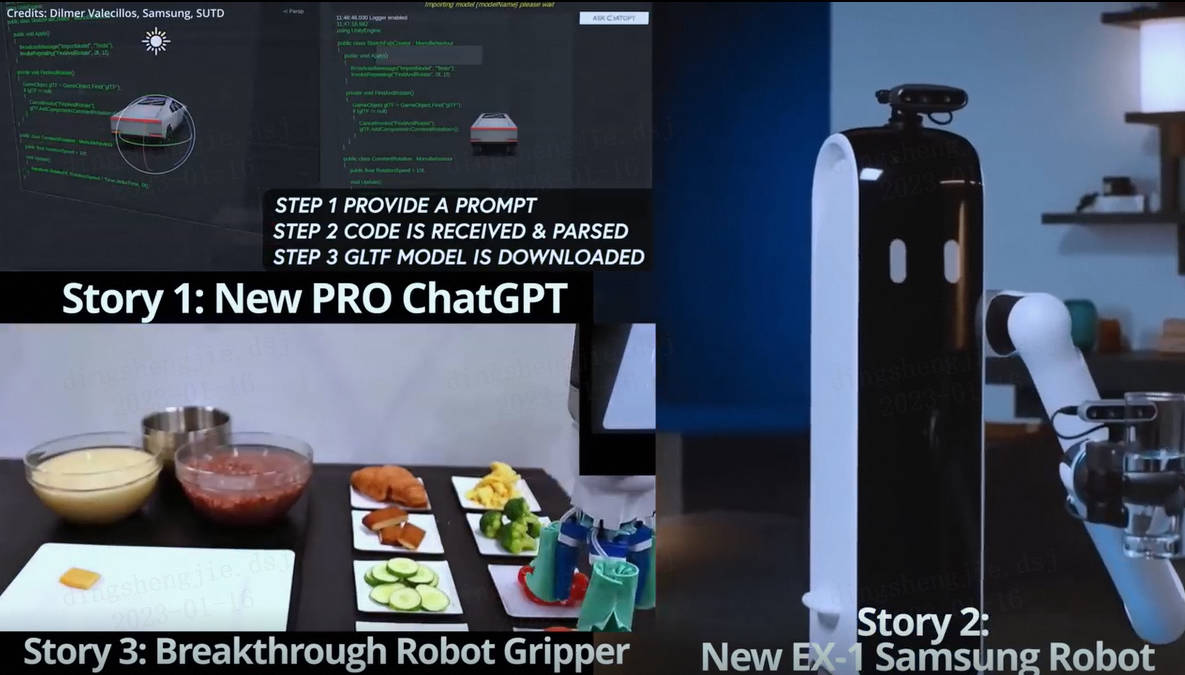

时间序列预测教程;OpenAI 谈对抗样本:自然语言处理入门 | AI 开发者日报

Jason Brownlee 的时间序列预测教程 这是澳大利亚机器学习专家 Jason Brownlee 撰写的教程,提供了一套用 Python 语言处理时间序列预测问题的模板。该教程一步步向读者展示了应该用什么工具、如何操作,以及为什么这样操作。它使用了波士顿持械抢劫案数量作为案例,旨在解决的问题...

Nvidia助力OpenAI非营利研究项目 赠AI超级计算机

上周,英伟达CEO黄仁勋(Jen-Hsun Huang)亲自在旧金山将一台DGX-1超级计算机赠与了OpenAI研究人员。DGX-1有着“装在盒子里的AI超级计算机”之称,它将由OpenAI非营利组织的研究团队用来探索与人工智能相关的诸多挑战。 其想法在于寻找OpenAI组织可以利用超级计算机的方法...

OpenAI最新研究:“对抗样本”能轻易黑掉AI系统,如何抵御?

雷锋网(公众号:雷锋网)按:近日,OpenAI发表最新研究,论述了AI安全领域的一大隐忧:“对抗样本”,它可以轻易地让机器学习系统产生误判,这会对AI的应用实践产生影响。在这篇由“GANs”之父Ian Goodfellow领衔撰写的文章里,OpenAI针对“对抗样本”进行了防御策略的实验,其中有两种...

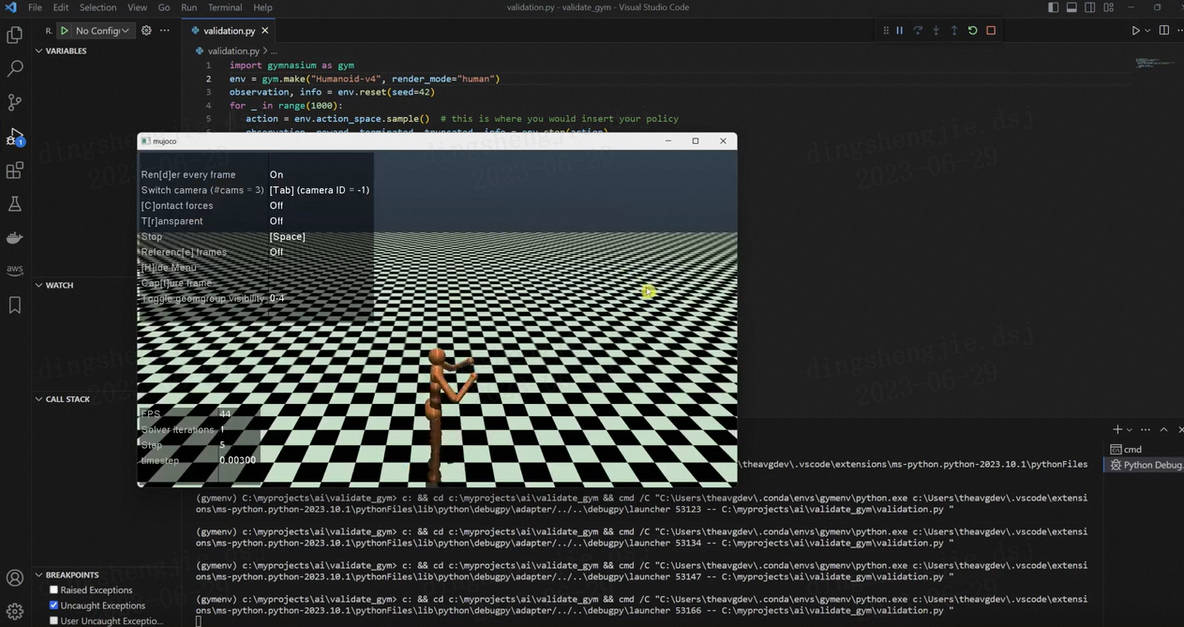

如何管教AI的行为举止?OpenAI早已开始研究,而这只是整个AI安全领域的前哨

雷锋网 AI 科技评论按:在比赛中刷成绩和在游戏中击败人类职业选手仅仅是 AI 研究的一部分,OpenAI 的研究人员们同样重视对 AI 安全性的研究。这篇文章是纽约时报来到 OpenAI 实验室的报道,介绍了 OpenAI 近期在 AI 安全领域的想法和一些成果,也让我们看到了 OpenAI 研究...

OpenAI发布“宇宙”平台,用1000+训练环境赋予AI“类人智力”

当人工智能领域大牛在西班牙NIPS会议酒店吃早餐的时候,Open AI 宣布开源了其新平台“宇宙”(Universe)。这家由伊隆·马斯克资助的非赢利性AI开源组织,在周一的上午搞了个大新闻,相信NIPS的餐桌上一定热闹非凡。当然,Open AI后续也在NIPS的会场展示了自己的成果。 Open A...

本页面内关键词为智能算法引擎基于机器学习所生成,如有任何问题,可在页面下方点击"联系我们"与我们沟通。