[帮助文档] LLM模型离线推理组件说明_人工智能平台 PAI(PAI)

LLM模型离线推理组件支持的LLM模型来源于PAI的快速开始中的部分LLM模型,将在线推理转为离线推理。

魔搭社区牵手FastChat&vLLM,打造极致LLM模型部署体验

引言FastChat是一个开放平台,用于训练、服务和评估基于LLM的ChatBot。FastChat的核心功能包括:优秀的大语言模型训练和评估代码。具有Web UI和OpenAI兼容的RESTful API的分布式多模型服务系统。vLLM是一个由加州伯克利分校、斯坦福大学和加州大学圣迭戈分校的研究人...

魔搭社区LLM模型部署实践, 以ChatGLM3为例(一)

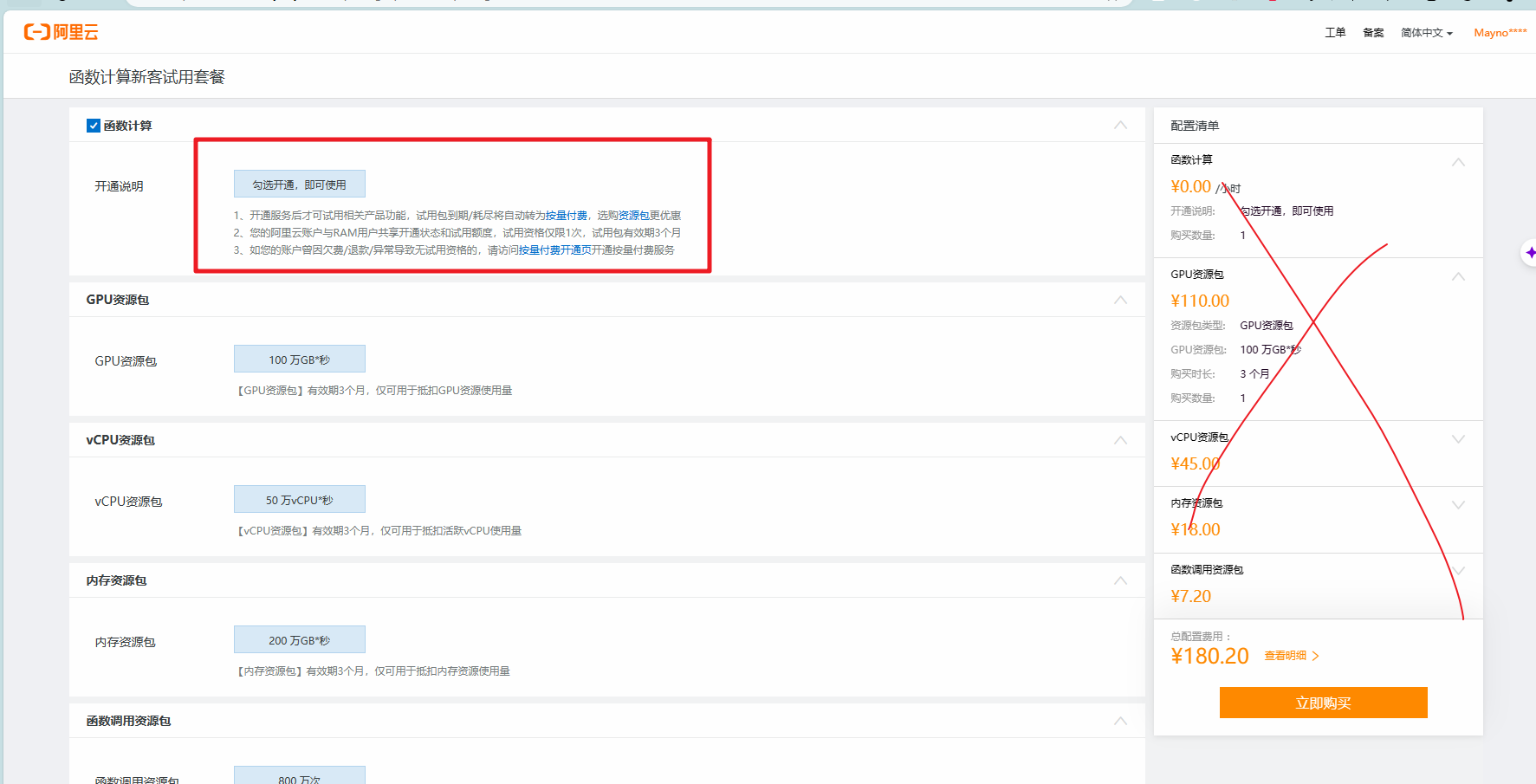

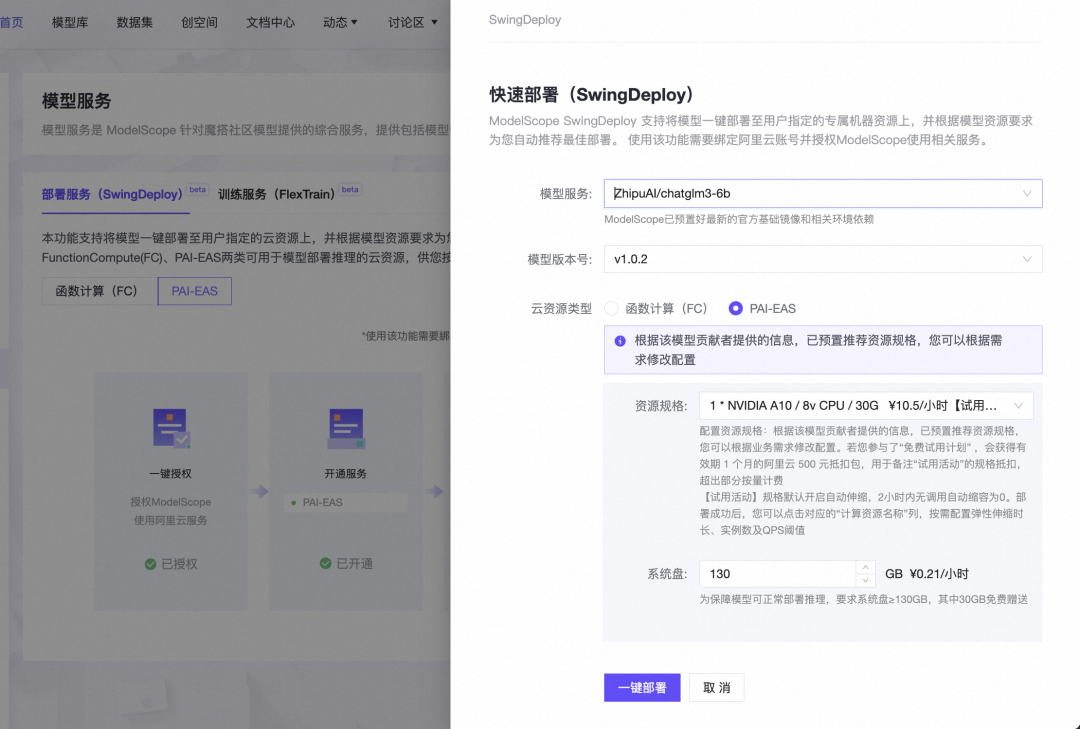

魔搭社区LLM模型部署实践, 以ChatGLM3为 例本文以ChatGLM3-6B为例, 主要介绍在魔搭社区如何部署LLM, 主要包括如下内容:● SwingDeploy - 云端部署, 实现零代码一键部署● 多端部署 - MAC个人笔记本, CPU服务器● 定制化模型部署 - 微调后部署一 、 S...

魔搭社区LLM模型部署实践, 以ChatGLM3为例(二)

二 、多端部署-以ChatGLM3+个人Mac电脑为例魔搭社区和Xinference合作, 提供了模型GGML的部署方式, 以ChatGLM3为例。Xinference支持大语言模型, 语音识别模型, 多模态模型的部署, 简化了部署流程, 通过一行命令完 成模型的部署工作 。并支持众多前沿的大语言模...

魔搭社区LLM模型部署实践 —— 以ChatGLM3为例

本文将以ChatGLM3-6B为例,介绍在魔搭社区如何部署LLM,主要包括如下内容:SwingDeploy - 云端部署,实现零代码一键部署多端部署 - MAC个人笔记本,CPU服务器定制化模型部署 - 微调后部署SwingDeploy&n...

LLM系列 | 02: Vicuna简介及模型部署实测

简介 月黑见渔灯,孤光一点萤。微微风簇浪,散作满河星。小伙伴们好,我是微信公众号《小窗幽记机器学习》的小编:卖钢丝球的小男孩。今天这篇小作文主要介绍Vicuna模型、基于官方模型13B模型部署服务及对话实测。更多、更新文章欢迎关注微信公众号:小窗幽记机器学习。后续会持续整理模型加速、模型部署、模型压...

本页面内关键词为智能算法引擎基于机器学习所生成,如有任何问题,可在页面下方点击"联系我们"与我们沟通。

产品推荐

最佳实践