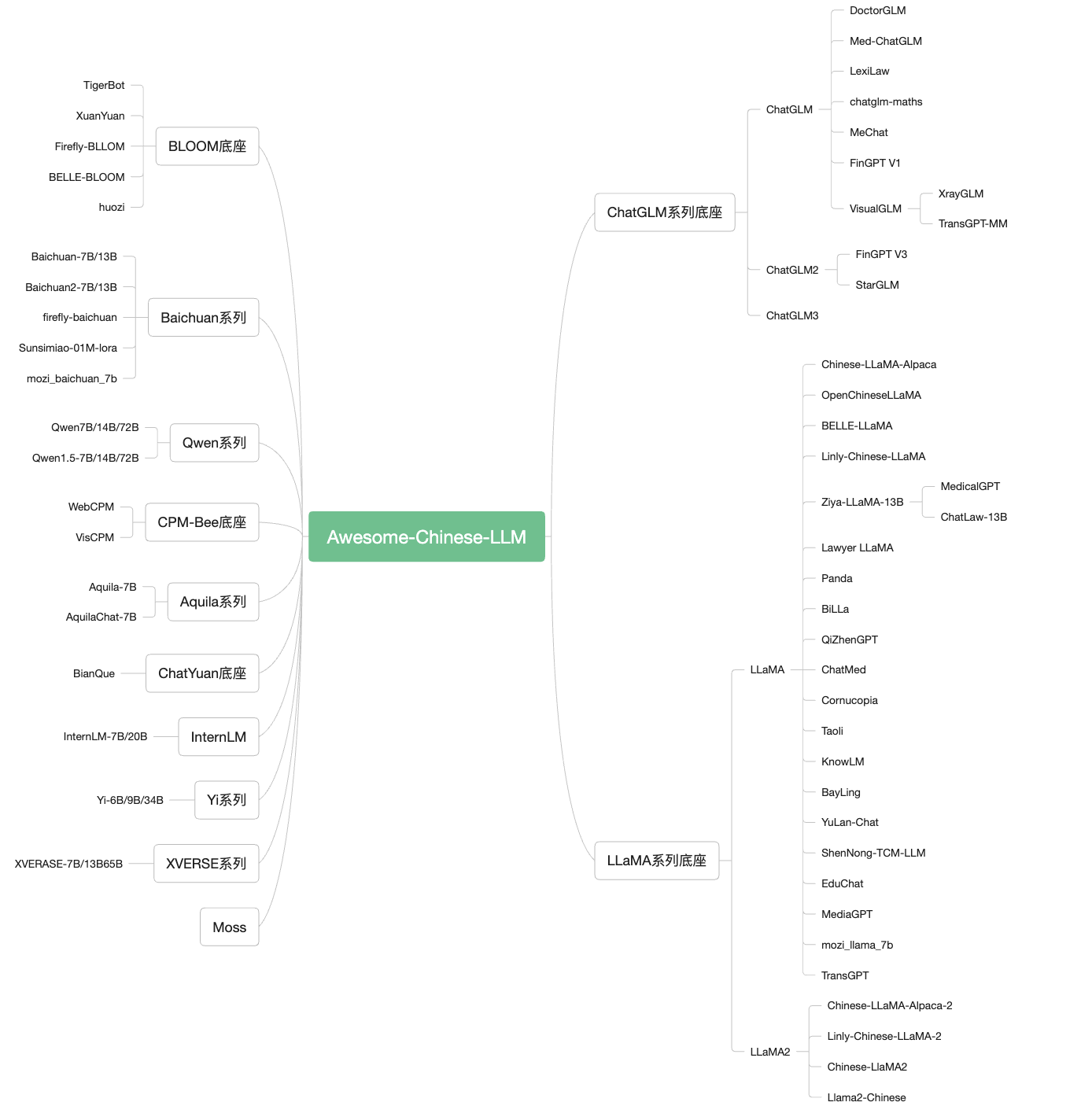

LLM资料大全:文本多模态大模型、垂直领域微调模型、STF数据集、训练微调部署框架、提示词工程等

LLM资料大全:文本多模态大模型、垂直领域微调模型、STF数据集、训练微调部署框架、提示词工程等 自ChatGPT为代表的大语言模型(Large Language Model, LLM)出现以后,由于其惊人的类通用人工智能(AGI)的能力,掀起了新一轮自然语言处理领域的研究和应用的浪潮。尤其是以Ch...

使用CLIP和LLM构建多模态RAG系统

什么是RAG 在人工智能领域,检索增强生成(retrieve - augmented Generation, RAG)作为一种变革性技术改进了大型语言模型(Large Language Models)的能力。从本质上讲,RAG通过允许模型从外部源动态检索实时信息来增强AI响应的特异性。 该体系结构将...

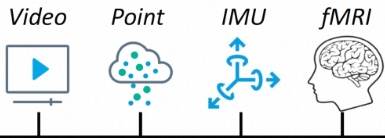

OneLLM,将所有模态和LLM Align的统一框架

引言OneLLM使用通用编码器和统一的投影模块与LLM对齐多模式输入,它还利用modality tokens 实现了在模态之间的切换。上图展现了OneLLM的四个重要的组件:不同模态的tokenizer,通用编码器,统一的投影模块,大语言模型。多模态token的tokenizer:将输入的各种模态的...

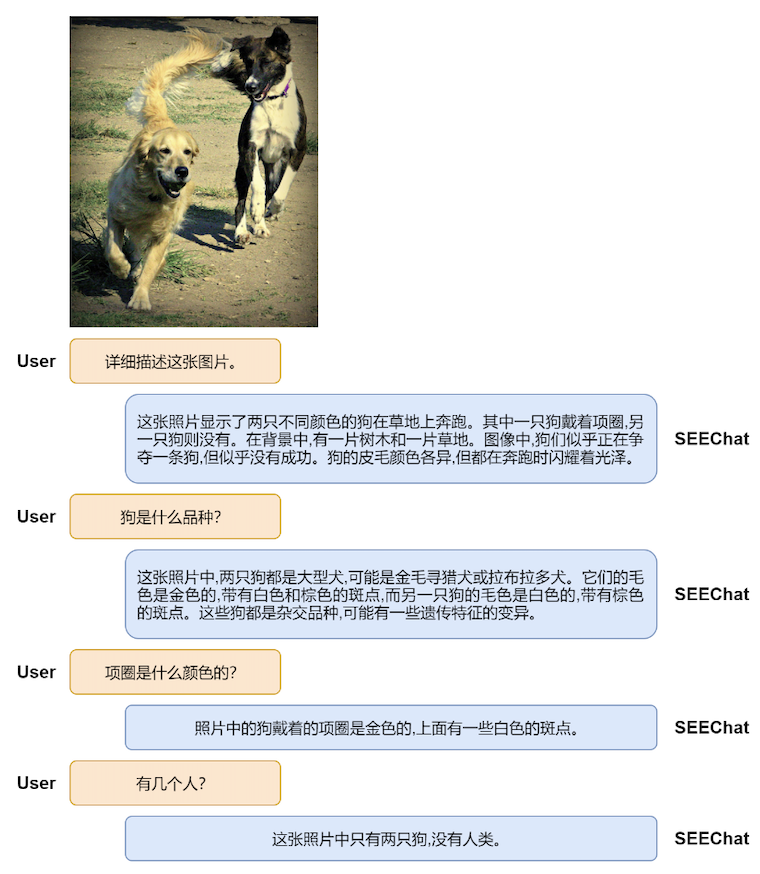

赋予LLM视觉理解能力,360人工智能研究院开源中文多模态对话模型SEEChat(1)

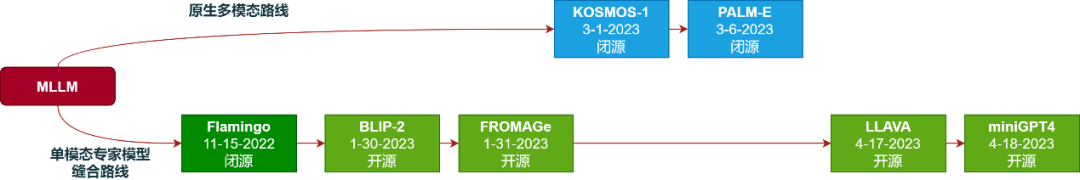

作者:冷大炜,360 人工智能研究院刚刚过去的 22 年被媒体誉为 “AIGC 元年”,这一年中 AI 绘画和 chatGPT 相继引爆了全球科技界,成为人工智能领域的两大里程碑事件,特别是 chatGPT 的推出,又重新点燃了人们对通用人工智能 AGI 的新一轮期待,chatGPT 所表现出来的前...

赋予LLM视觉理解能力,360人工智能研究院开源中文多模态对话模型SEEChat(2)

SEEChat v1.0 的训练分为两个阶段:第一阶段是图文对齐训练,使用我们之前开源的高质量中文图文对数据集 Zero [7],总共 2300 万样本进行训练;第二阶段是人机对齐训练,使用 miniGPT4+LLAVA 开源的指令微调数据经英 - 中翻译后,对第一阶段训练好的模型进行指令微调。下图...

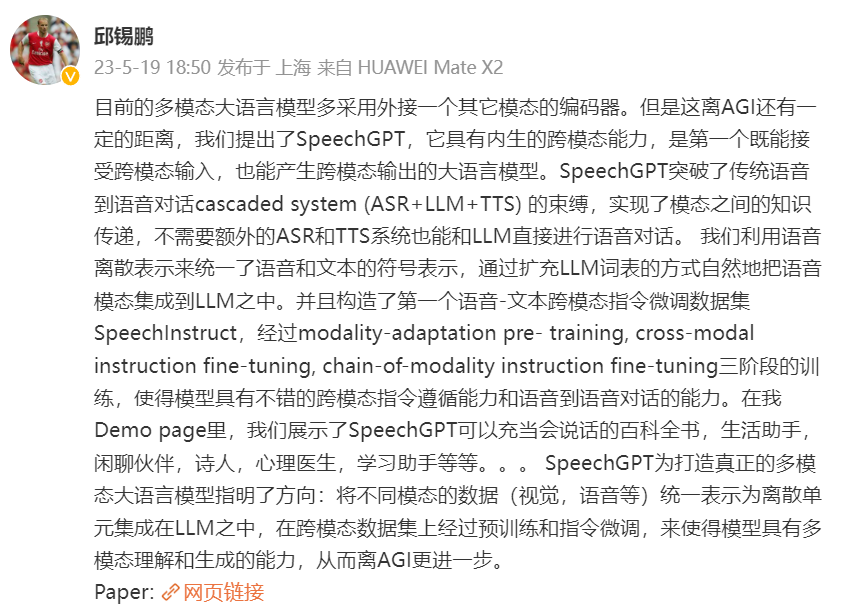

为多模态LLM指明方向,邱锡鹏团队提出具有内生跨模态能力的SpeechGPT

「 SpeechGPT 为打造真正的多模态大语言模型指明了方向:将不同模态的数据(视觉,语音等)统一表示为离散单元集成在 LLM 之中,在跨模态数据集上经过预训练和指令微调,来使得模型具有多模态理解和生成的能力,从而离 AGI 更进一步。」—— 复旦大学计算机学院教授邱锡鹏大型语言模型(...

本页面内关键词为智能算法引擎基于机器学习所生成,如有任何问题,可在页面下方点击"联系我们"与我们沟通。

产品推荐

最佳实践