脚本实现:从 HIVE 中导入数据到 MYSQL

脚本实现:从 HIVE 中导入数据到 MYSQL代码如下:import os import pymysql hive_sql = """ beeline -u jdbc:hive2://10.5.145.113:10000 -n 用户名 -p 密码 --showHeader=false --outp...

【hive】(电影推荐系统的数据)在hive中创表,并导入数据,同时取出自己想要的数据

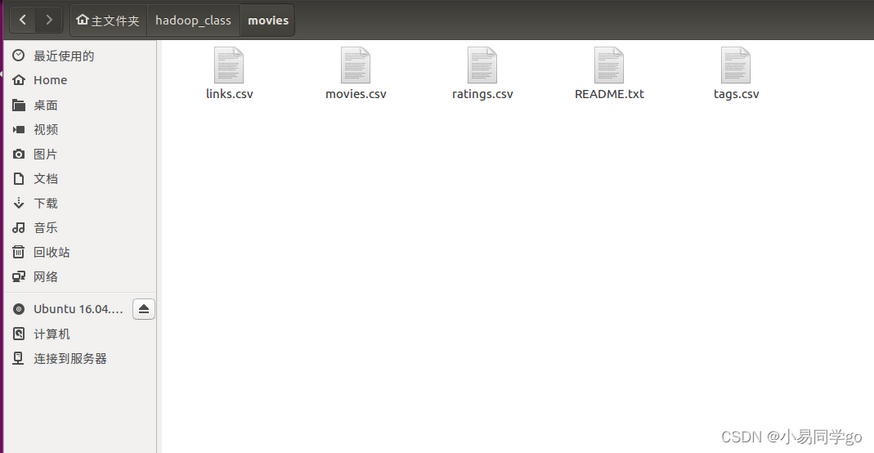

目标将本地表导入hive中,并完成一系列的查询 我这里一共有四个表,分别是 movies ratings tags links,分别如下一、在HDFS中创建文件夹二、将本地的四张表上传到新建文件夹中,并检验是否成功导入三、在hive中创表,并将数据导入1.查有哪些数据库,接着创建新的数据库,并使用相...

Hive中追加导入数据的4种方式是什么?

Hive中追加导入数据的4种方式是什么?

Hive导入数据的五种方式分别是什么?

Hive导入数据的五种方式分别是什么?

从自建hive往MaxCompute内导入数据的时候,默认数据为覆盖,覆盖是整张表 drop 掉,重

是的, 覆盖类似于整张表 drop 掉,完全重新写入(insert overwrite)。

hive导入数据到【有分区的表】(partitioned by)就报错,提示hi?400报错

服务器centos7.2 hive版本0.12 hadoop版本2.7.6 ----------------分割线----------------- 创建table的时候,用的外部表,放置于mysql,其中使用了partitioned by 关键字 ( partitioned by (logdate...

Hive向分区表导入数据File not found: File does no?400报错

Hive向分区表导入数据File not found: File does not exist:reduce.xml? 400 报错 启动hdfs正常,NN、DN、SN都正常。 启动hive只有一个runjar进程,但查询、建本地表、查表都正常。 在从本地表tb3导入分区表tb4_p时出错: ins...

hive 使用load导入数据时是否可以指定分隔符

hive load数据只是单纯的把文件拷贝到hdfs的相应目录下面,并不作格式检查和解析只有在查询数据的时候,才会根据创建表时定义的序列化方式解析数据建表的时候可以指定分隔符 本文转自 yntmdr 51CTO博客,原文链接:http://blog.51cto.com/yntmdr/1744290,...

Hive数据导入——数据存储在Hadoop分布式文件系统中,往Hive表里面导入数据只是简单的将数据移动到表所在的目录中!

转自:http://blog.csdn.net/lifuxiangcaohui/article/details/40588929 Hive是基于Hadoop分布式文件系统的,它的数据存储在Hadoop分布式文件系统中。Hive本身是没有专门的数据存储格式,也没有为数据建立索引,只需要在创建表的时候告...

[Hive]Hive使用指南四 客户端导入数据

版权声明:本文为博主原创文章,未经博主允许不得转载。 https://blog.csdn.net/SunnyYoona/article/details/52935649 根据导入的地方不一样,主要介绍下面几种方式: 从本地文件系统中导入数据到Hive表 从HDFS上导入数据到Hive表 从别的表中查...

本页面内关键词为智能算法引擎基于机器学习所生成,如有任何问题,可在页面下方点击"联系我们"与我们沟通。