机器学习 - [集成学习]Bagging算法的编程实现

机器学习 - [集成学习]Bagging算法的编程实现【导读】本文主要介绍如何实现Bagging算法,作为一种集成算法我们假设其基分类器已经写好。本文代码中,直接使用sklearn中的决策树分类器等基分类器。1. 回顾知识点从训练集中均匀随机有放回地采样不同的子集且训练不同的基础模型给定集合 D通过...

![机器学习 - [集成学习] - Bagging算法的编程实现](https://ucc.alicdn.com/pic/developer-ecology/drgdp2rj2g4eq_a2074af365724dfd96d539751e44812c.png)

机器学习 - [集成学习] - Bagging算法的编程实现

机器学习 - [集成学习] Bagging算法的编程实现李俊才 (jcLee95)的个人博客已入驻阿里云博客邮箱 :291148484@163.com本文地址:- https://developer.aliyun.com/article/- https://blog.csdn.net/qq_2855...

ML之LoR&Bagging&RF:依次利用Bagging、RF算法对泰坦尼克号数据集 (Kaggle经典案例)获救人员进行二分类预测——模型融合(二)

核心代码clf=RandomForestClassifier(n_estimators=500, criterion='entropy', max_depth=5, min_samples_split=2, min_samples_leaf=1, max_features='auto',...

ML之LoR&Bagging&RF:依次利用LoR、Bagging、RF算法对泰坦尼克号数据集 (Kaggle经典案例)获救人员进行二分类预测(最全)(二)

核心代码clf_LoR = linear_model.LogisticRegression(C=1.0, penalty='l1', tol=1e-6)clf_LoR.fit(X, y)#LoR算法class LogisticRegression Found at: sklearn.linear_m...

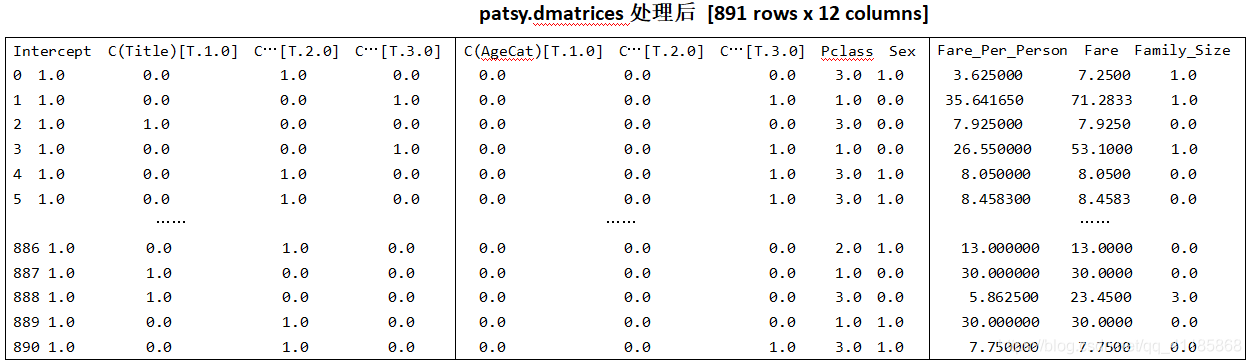

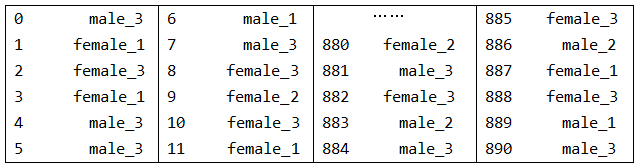

ML之LoR&Bagging&RF:依次利用LoR、Bagging、RF算法对泰坦尼克号数据集 (Kaggle经典案例)获救人员进行二分类预测(最全)(一)

输出结果1、数据集可视化以及统计分析2、优化baseline模型ML之LoR&Bagging&RF:依次利用LoR、Bagging、RF算法对泰坦尼克号数据集 (Kaggle经典案例)获救人员进行二分类预测——优化baseline模型https://blog.csdn.net/qq_...

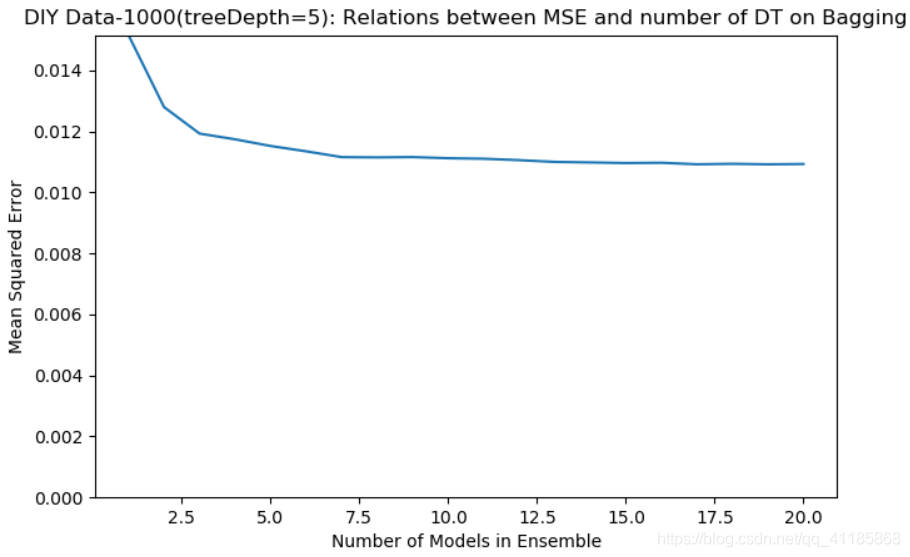

EL之Bagging:利用Bagging算法实现回归预测(实数值评分预测)问题

输出结果设计思路

EL之Bagging(DTR):利用DIY数据集(预留30%数据+两种树深)训练Bagging算法(DTR)

输出结果设计思路核心代码for iTrees in range(numTreesMax): idxBag = [] for i in range(nBagSamples): idxBag.app...

bagging算法(随机森林RF算法)

bagging算法(随机森林RF算法简介) bagging算法特点是各个弱学习器之间没有依赖关系,可以并行拟合。加快计算速度。那么,bagging算法其实是一种工程思维,真正把这个思维转换成可以应用于工程计算的就是随机森林算法 通过上图我们知道,bagging是每个弱学习器之间的并行计算最后综合预测...

本页面内关键词为智能算法引擎基于机器学习所生成,如有任何问题,可在页面下方点击"联系我们"与我们沟通。