集成学习之随机森林、Adaboost、Gradient Boosting、XGBoost原理及使用

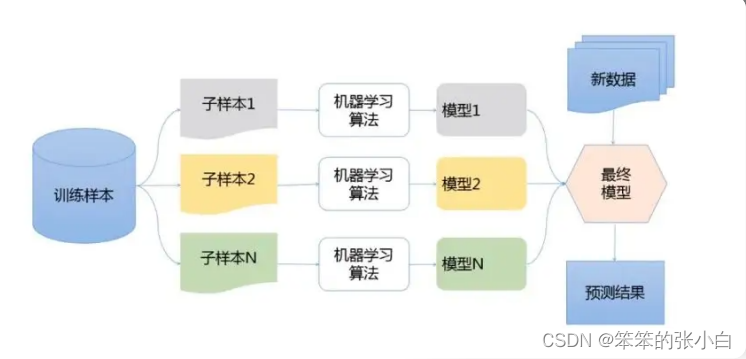

集成学习 什么是集成学习集成学习(ensemble learning)本身不是一个单独的机器学习算 法,而是通过构建并结 合多个机器学习模型来完成学习任务——博采众长。集成学习很好 的避免了单一学习模型带 来的过拟合问题。 集成学习的类型根据个体学习器的生成方式,目前的集成学习方法大致可分为两 大类...

06 集成学习 - Boosting - GBDT算法原理、总结

05 集成学习 - Boosting - GBDT初探 十四、GBDT的构成 ● GBDT由三部分构成:DT(Regression Decistion Tree-回归决策树)、GB(Gradient Boosting-梯度提升)、Shrinkage(衰减)1、先构建__回归决策树__,然后用到提升的...

03 集成学习 - Boosting - AdaBoost算法原理

02 集成学习 - 特征重要度、Extra Tree、TRTE、IForest、随机森林总结 八、Boosting 提升学习 提升学习是一种机器学习技术,可以用于__回归__和__分类__问题。它每一步产生__弱预测模型__ (如决策树),并__加权累加__到总模型中。如果每一步的弱预测模型的生成都...

集成学习之Boosting —— Gradient Boosting原理

集成学习之Boosting —— AdaBoost原理 集成学习之Boosting —— AdaBoost实现 集成学习之Boosting —— Gradient Boosting原理 集成学习之Boosting —— Gradient Boosting实现 上一篇介绍了AdaBoost算法,Ada...

本页面内关键词为智能算法引擎基于机器学习所生成,如有任何问题,可在页面下方点击"联系我们"与我们沟通。