一文介绍CNN/RNN/GAN/Transformer等架构 !!

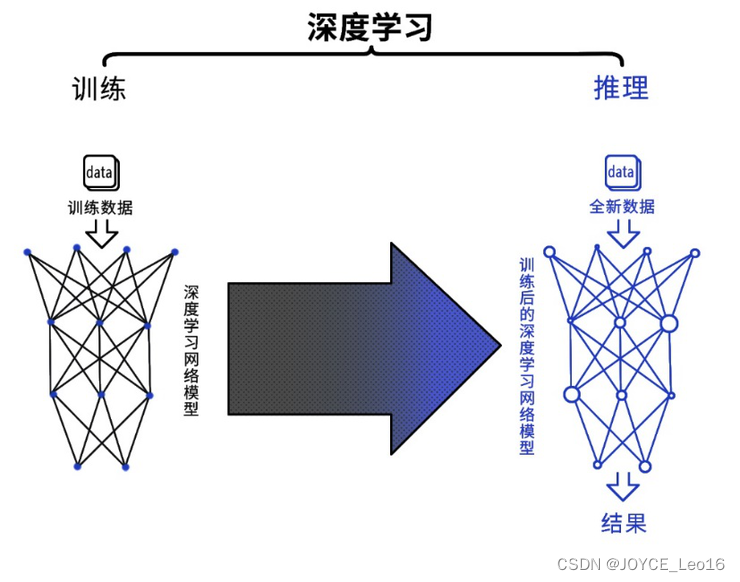

前言 本文旨在介绍深度学习架构,包括卷积神经网络CNN、循环神经网络RNN、生成对抗网络GAN、Transformer和Encoder-Decoder架构。 1、卷积神经网络(CNN) 卷积神经网络CNN是...

Mamba详细介绍和RNN、Transformer的架构可视化对比

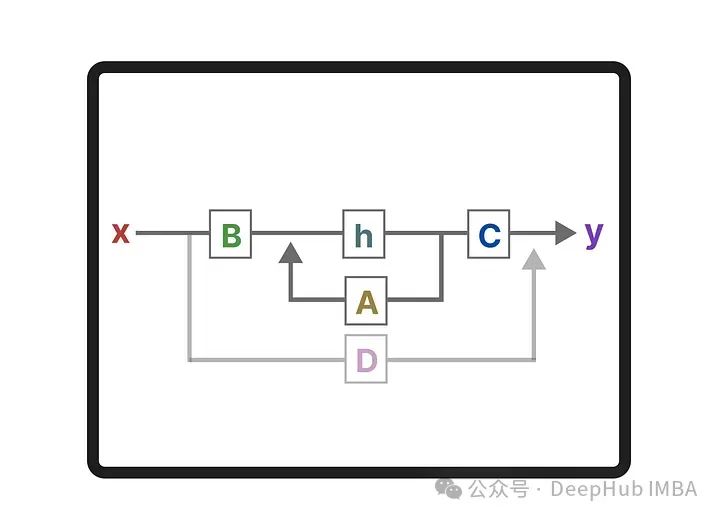

Mamba: Linear-Time Sequence Modeling with Selective State Spaces一文中提出了Mamba,我们在之前的文章中也有详细的介绍。 在本篇文章中,通过将绘制RNN,transformer,和Mamba的架构图,并进行详细的对比,这样我们可以更详...

在Transformer时代重塑RNN,RWKV将非Transformer架构扩展到数百亿参数

机器之心编辑部Transformer 模型在几乎所有自然语言处理(NLP)任务中都带来了革命,但其在序列长度上的内存和计算复杂性呈二次方增长。相比之下,循环神经网络(RNNs)在内存和计算需求上呈线性增长,但由于并行化和可扩展性的限制,很难达到与 Transformer 相同的性能水平...

本页面内关键词为智能算法引擎基于机器学习所生成,如有任何问题,可在页面下方点击"联系我们"与我们沟通。