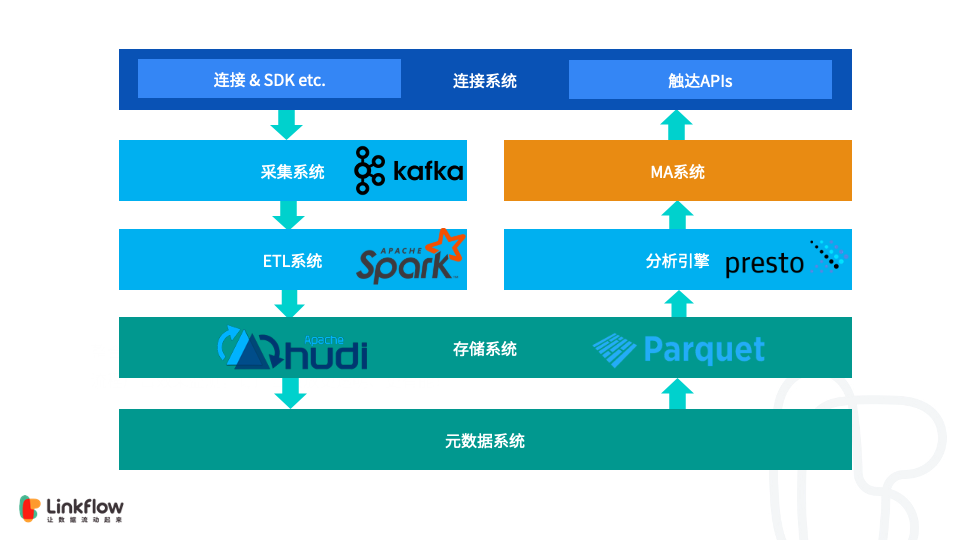

Apache Hudi在Linkflow构建实时数据湖的生产实践

1. 背景 Linkflow 作为客户数据平台(CDP),为企业提供从客户数据采集、分析到执行的运营闭环。每天都会通过一方数据采集端点(SDK)和三方数据源,如微信,微博等,收集大量的数据。这些数据都会经过清洗,计算,整合后写入存储。使用者可以通过灵活的报表或标签对持久化的数据进行分析和计算,结果又...

字节跳动基于Apache Hudi构建实时数据湖平台实践

一篇关于字节跳动基于 Apache Hudi 的实时数据湖平台的分享。 ...

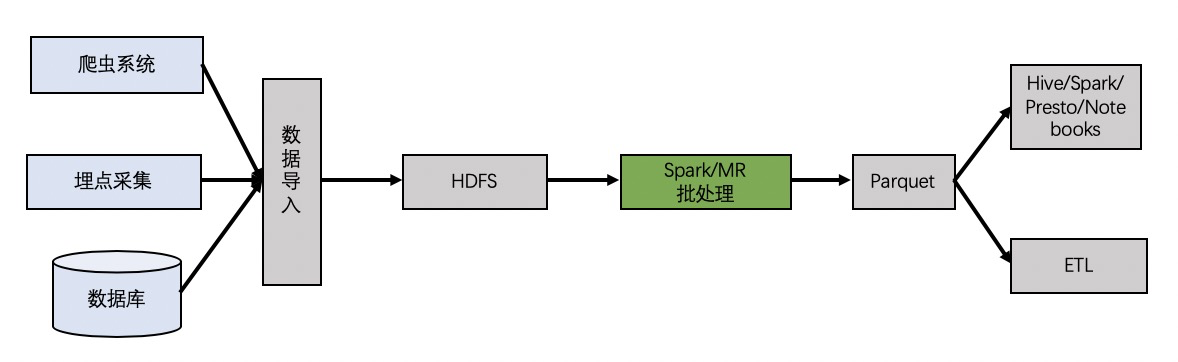

Apache Hudi 在 B 站构建实时数据湖的实践

本文作者喻兆靖,介绍了为什么 B 站选择 Flink + Hudi 的数据湖技术方案,以及针对其做出的优化。主要内容为:传统离线数仓痛点数据湖技术方案Hudi 任务稳定性保障数据入湖实践增量数据湖平台收益社区贡献未来的发展与思考GitHub 地址 https://github.com/apache/...

基于阿里云数据湖分析服务和Apache Hudi构建云上实时数据湖

1. 什么是实时数据湖 大数据时代数据格式的多样化,如结构化数据、半结构化数据、非结构化数据,传统数据仓库难以满足各类数据的存储,同时传统数仓已经难以满足上层应用如交互式分析、流式分析、ML等的多样化需求。而数仓T+1的数据延迟导致分析延迟较大,不利于企业及时洞察数据价值;同时随着云计算技术发展以及...

本页面内关键词为智能算法引擎基于机器学习所生成,如有任何问题,可在页面下方点击"联系我们"与我们沟通。

Apache您可能感兴趣

- Apache入门

- Apache tomcat

- Apache web

- Apache pdf

- Apache文本

- Apache mod_proxy

- Apache负载均衡

- Apache配置

- Apache svn

- Apache服务器

- Apache flink

- Apache rocketmq

- Apache安装

- Apache php

- Apache dubbo

- Apache linux

- Apache spark

- Apache开发

- Apache报错

- Apache服务

- Apache微服务

- Apache从入门到精通

- Apache hudi

- Apache doris

- Apache mysql

- Apache日志

- Apache kafka