详细介绍线性回归的原理、Python的实现方式以及相关应用技巧

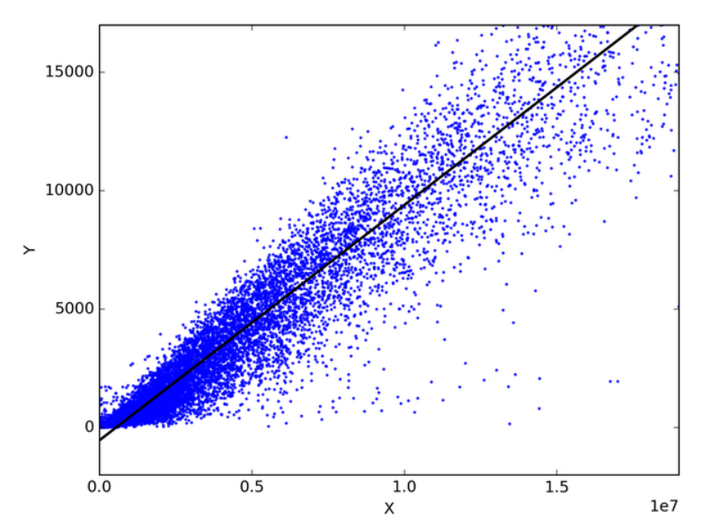

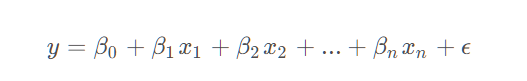

线性回归是一种常用的统计方法,用于建立特征和目标变量之间的线性关系模型。在Python数据分析中,线性回归是一种基础技能,被广泛应用于预测分析、关联分析和特征选择等领域。本文将详细介绍线性回归的原理、Python的实现方式以及相关应用技巧。 1. 线性回归原理 1.1 线性回归模型 线性回归模型假设...

线性回归 梯度下降原理与基于Python的底层代码实现

1 梯度下降算法原理梯度下降是一种常用的优化算法,可以用来求解许包括线性回归在内的许多机器学习中的问题。前面讲解了直接使用公式求解θ \thetaθ (最小二乘法的求解推导与基于Python的底层代码实现),但是对于复杂的函数来说,可能较难求出对应的公式,因此需要使用梯度下降。假设我们要求解的线性回...

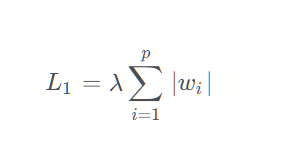

线性回归 正则项(惩罚项)原理、正则项的分类与Python代码的实现

1 正则项的含义在线性回归中,正则项是一种用于控制模型复杂度的技术,它通过将系数的大小加入到损失函数中,以限制模型的复杂度。在线性回归中,通常使用L1正则项或L2正则项。正则项的形式可以表示为:L1正则项(Lasso):L2正则项(Ridge):...

线性回归 特征扩展的原理与python代码的实现

1 多项式扩展的作用在线性回归中,多项式扩展是种比较常见的技术,可以通过增加特征的数量和多项式项的次数来提高模型的拟合能力。举个例子,多项式扩展可以将一个包含 n 个特征的样本向量 x 扩展为一个包含 k 个特征的样本向量,其中 k 可以是 n 的任意多项式。例如,如果我们使用二次多项式扩展,可以将...

线性回归与梯度下降法-原理与Python实现【重要】

本文主要讲了梯度下降法的两种迭代思路,随机梯度下降(Stochastic gradient descent)和批量梯度下降(Batch gradient descent)。以及他们在python中的实现。 梯度下降法 梯度下降是一个最优化算法,通俗的来讲也就是沿着梯度下降的方向来求出一个函数的极小值...

本页面内关键词为智能算法引擎基于机器学习所生成,如有任何问题,可在页面下方点击"联系我们"与我们沟通。

Python原理相关内容

- Python asyncio原理

- Python异步编程原理

- Python原理应用

- Python reduce原理

- Python神经网络原理

- 视频原理Python

- 支持向量机原理Python

- 视频原理Python流失

- 原理Python

- 机械视觉原理Python

- 人工智能原理Python

- 神经网络原理Python

- lstm原理Python

- Python原理方法

- Python虚拟机原理

- Python super原理

- Python多线程编程原理

- Python线程原理

- Python原理使用场景

- Python人工智能原理

- 梯度下降原理Python

- 原理Python流程

- oeasy Python原理

- Python py原理