日志分析实战之清洗日志小实例1:使用spark&Scala分析Apache日志

about云日志分析,那么过滤清洗日志。该如何实现。这里参考国外的一篇文章,总结分享给大家。使用spark分析网站访问日志,日志文件包含数十亿行。现在开始研究spark使用,他是如何工作的。几年前使用hadoop,后来发现spark也是容易的。下面是需要注意的:如果你已经知道如何使用spark并想知...

Spark-再次分析Apache访问日志

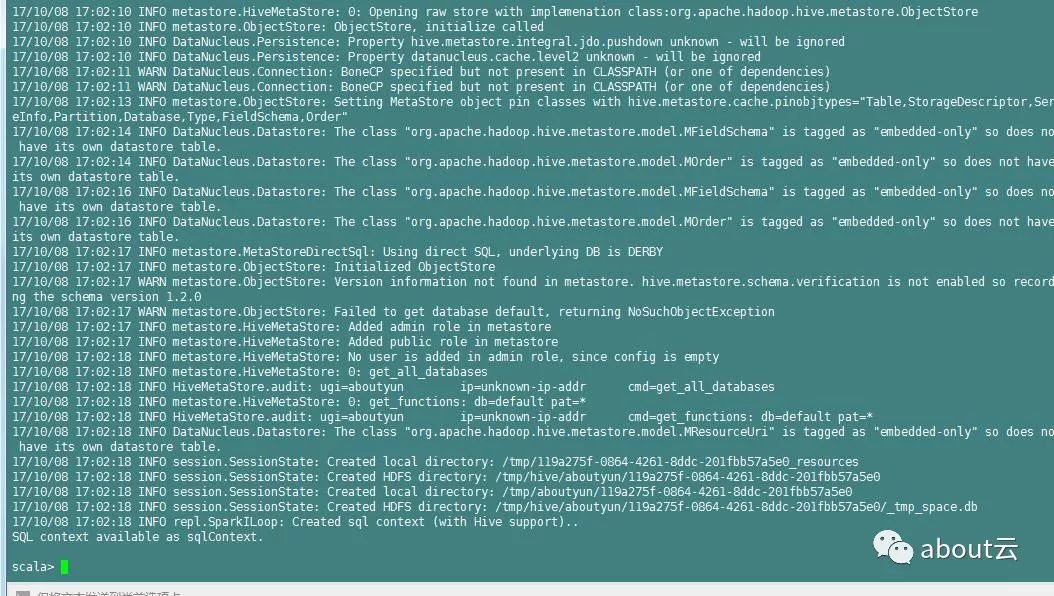

分析日志的包 自己编译下: sbt compile sbt test sbt package ApacheLogParser.jar 对于访问日志简单分析grep等利器比较好,但是更复杂的查询就需要Spark了。 代码: import com.alvinalexander.accesslogpars...

本页面内关键词为智能算法引擎基于机器学习所生成,如有任何问题,可在页面下方点击"联系我们"与我们沟通。

社区圈子

apache spark您可能感兴趣

- apache spark教程

- apache spark步骤

- apache spark访问外网

- apache spark配置

- apache spark集群

- apache spark数据

- apache spark MySQL

- apache spark超时

- apache spark MaxCompute

- apache spark大数据计算

- apache spark SQL

- apache spark streaming

- apache spark rdd

- apache spark Hadoop

- apache spark大数据

- apache spark运行

- apache spark summit

- apache spark模式

- apache spark学习

- apache spark分析

- apache spark实战

- apache spark机器学习

- apache spark Scala

- apache spark flink

- apache spark程序

- apache spark大数据分析