[帮助文档] 基于TensorFlow Serving推理服务引擎部署PAI eas模型服务

TensorFlow Serving是一个适用于深度学习模型的推理服务引擎,支持将TensorFlow标准的SavedModel格式的模型部署为在线服务,并支持模型热更新与模型版本管理等功能。本文为您介绍如何使用镜像部署的方式部署TensorFlow Serving模型服务。

[帮助文档] 通过ServerlessDevs部署TensorFlow的Serverless AI推理代码_函数计算(旧版)(FC)

您可以通过Serverless Devs开发工具快速将AI推理类的应用部署到函数计算控制台,从而实现按需、自动扩展的AI模型推理,无需管理底层基础设施,节省成本并快速迭代。

[帮助文档] 如何使用PAI-Blade的SDK部署TensorFlow模型推理

PAI-Blade提供了C++ SDK帮助您部署优化后的模型推理。本文以TensorFlow模型为例,介绍PAI-Blade的SDK的使用方法。

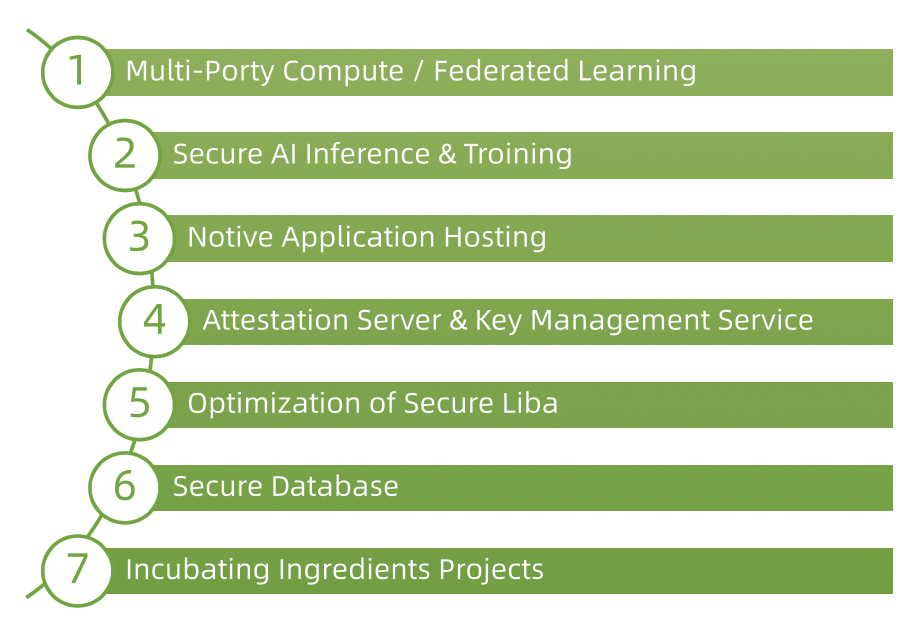

《云原生机密计算最佳实践白皮书》——07解决方案——Intel Confidential Computing Zoo: Intel机 密计算开源解决方案——部署TensorFlow Serving在线推理服务(1)

Intel Confifidential Computing Zoo: Intel机密计算开源解决方案项目位置链接https://github.com/intel/confidential-computing-zoo技术自身介绍问题&挑战目前,机密计算还处于早期阶段,用户对SGX和TDX技术...

《云原生机密计算最佳实践白皮书》——07解决方案——部署TensorFlow Serving在线推理服务(2)

步骤一:部署客户端本实践运行的环境信息参考:• 规格:加密内存≥8G• 镜像: Ubuntu20.04• 公网IP• 安装SGX软件栈1、环境配置安装所需的mesa-libGL软件包。sudo pip3 install --upgrade pip sudo pip install multidict...

《云原生机密计算最佳实践白皮书》——07解决方案——部署TensorFlow Serving在线推理服务(3)

步骤二:部署Anolis OS SGX端1、下载本实践所用的TensorFlow Serving脚本代码git clone https://github.com/intel/confifidential-computing-zoo.git cd confifidential-computing-zo...

[帮助文档] 如何将Tensorflow,Pytorch和Python等模型部署到Seldon中

DataScience集群的KubeFlow服务内置了SeldonCore组件, 可以为模型提供在线服务,基于Kubernetes,您无需关心在线服务的运维工作。您可以根据提供的dsdemo代码,将Tensorflow,Pytorch和Python等模型部署到Seldon中。

本页面内关键词为智能算法引擎基于机器学习所生成,如有任何问题,可在页面下方点击"联系我们"与我们沟通。

社区圈子

TensorFlow您可能感兴趣

- TensorFlow编译

- TensorFlow区别

- TensorFlow pytorch

- TensorFlow深度学习

- TensorFlow迁移学习

- TensorFlow模型

- TensorFlow迁移

- TensorFlow学习

- TensorFlow预训练模型

- TensorFlow目标检测

- TensorFlow机器学习

- TensorFlow教程

- TensorFlow网络

- TensorFlow安装

- TensorFlow python

- TensorFlow神经网络

- TensorFlow keras

- TensorFlow框架

- TensorFlow训练

- TensorFlow实战

- TensorFlow api

- TensorFlow实践

- TensorFlow gpu

- TensorFlow入门

- TensorFlow学习笔记

- TensorFlow数据集