原创 | SQL优化之使用正确的去重方法

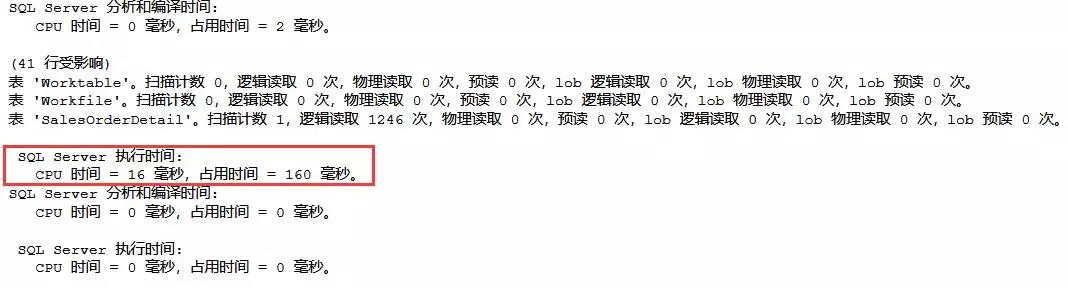

1.使用DISTINCT去掉重复数据我们重复一下上一讲的例子:SELECT DISTINCT UnitPrice FROM [Sales].[SalesOrderDetail] WHERE UnitPrice>1000;执行完之后的结果如下:接下来,我们将这个表里的数据增大到194万条,再重复...

SQL去重是用DISTINCT好,还是GROUP BY好?

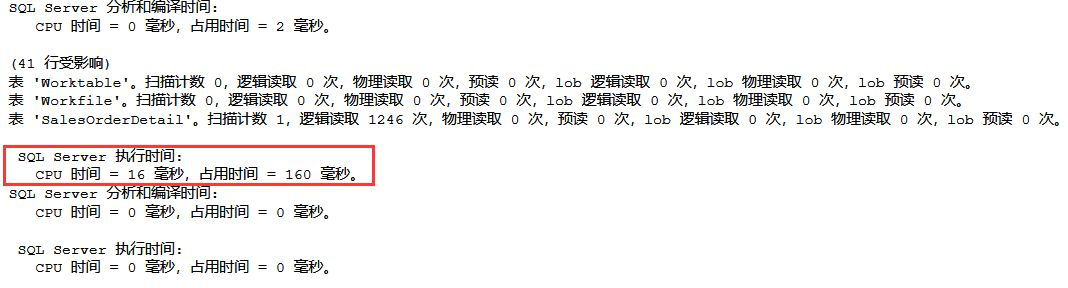

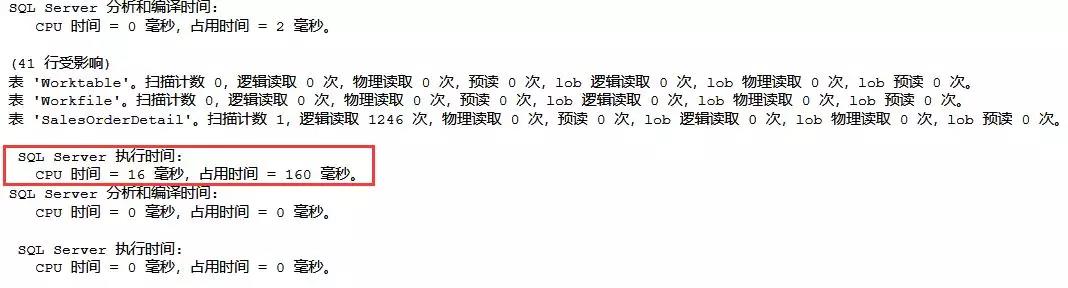

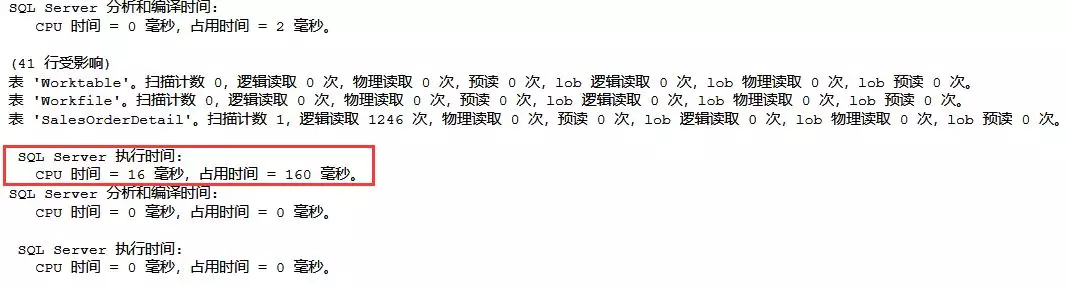

我们知道DISTINCT可以去掉重复数据,GROUP BY在分组后也会去掉重复数据,那这两个关键字在去掉重复数据时的效率,究竟谁会更高一点?1.使用DISTINCT去掉重复数据我们先看下面这个例子:SELECT DISTINCT UnitPrice FROM [Sales].[SalesOrderD...

SQL优化小讲堂(二)——使用正确的去重方法

1.使用DISTINCT去掉重复数据我们重复一下上一讲的例子:SELECT DISTINCT UnitPrice FROM [Sales].[SalesOrderDetail] WHERE UnitPrice>1000;执行完之后的结果如下:接下来,我们将这个表里的数据增大到194万条,再重复...

MaxCompute SQL优化中的算子顺序优化时优先执行可去重的算子的优点是啥?

MaxCompute SQL优化中的算子顺序优化时优先执行可去重的算子的优点是啥?

如何用 Flink SQL 做简单的数据去重?

最近我有一个使用 Flink SQL 做简单的数据去重的需求,想使用 Flink 的 ScalarFunction,通过阅读 API 发现 FunctionContext context 并不支持访问 state。 我准备使用 Guava cache 做,不知道小伙伴有没有更好的建议哈!感谢。 *来...

flink sql 去重算法是怎么样的?

请问flink sql count(disitinct) 底层的算法是怎样的? 是bitmap ? 还是简单通过java的set容器去重的呢?*来自志愿者整理的flink邮件归档

MaxCompute SQL 去重ID怎么做?

MaxCompute SQL 去重ID怎么做?

SQL优化之使用正确的去重方法

作者:丶平凡世界 SQL数据库开发 上一讲我们使用DISTINCT来去掉重复行以提高查询效率,没看过的小伙伴戳这里 《原创 | SQL优化之不查询多余的行和列》。 这和小伙伴们平常听到的一条优化建议:尽量少使用DISTINCT相悖。下面我们来看看DISTINCT到底该不该使用。如果不想看处理过程的可...

Hive SQL去重a,b和b,a类型

昨天开发找到我们DBA,要我们写一条Hive SQL。 需求: 有一个t表,主要有机场名称airport,机场的经纬度distance这两个列组成,想得到所有距离小于100的两个机场名。 其实写这个SQL的逻辑并不是很困难,难点是如何去重复值, 我用MySQL模拟的一个表,其实Hive语法和SQL差...

[@徐雷frank][¥20]如下sql为当前我们的业务库中的一个去重的逻辑

如下sql为当前我们的业务库中的一个去重的逻辑。 select * from test_user where (user_id,area_id) in ( select user_id,area_id from test_user where user_id is not null group by...

本页面内关键词为智能算法引擎基于机器学习所生成,如有任何问题,可在页面下方点击"联系我们"与我们沟通。