scrapy_selenium爬取Ajax、JSON、XML网页:豆瓣电影

导语 在网络爬虫的开发过程中,我们经常会遇到一些动态加载的网页,它们的数据不是直接嵌入在HTML中,而是通过Ajax、JSON、XML等方式异步获取的。这些网页对于传统的scrapy爬虫来说,是很难直接解析的。那么,我们该如何使用scrapy_selenium来爬取这些数据格式的网页呢?本文将为你介...

Python爬虫:scrapy内置网页解析库parsel-通过css和xpath解析xml、html

文档https://pypi.org/project/parsel/https://github.com/scrapy/parsel安装pip install parsel代码示例from parsel import Selector selector = Selector(text="""<...

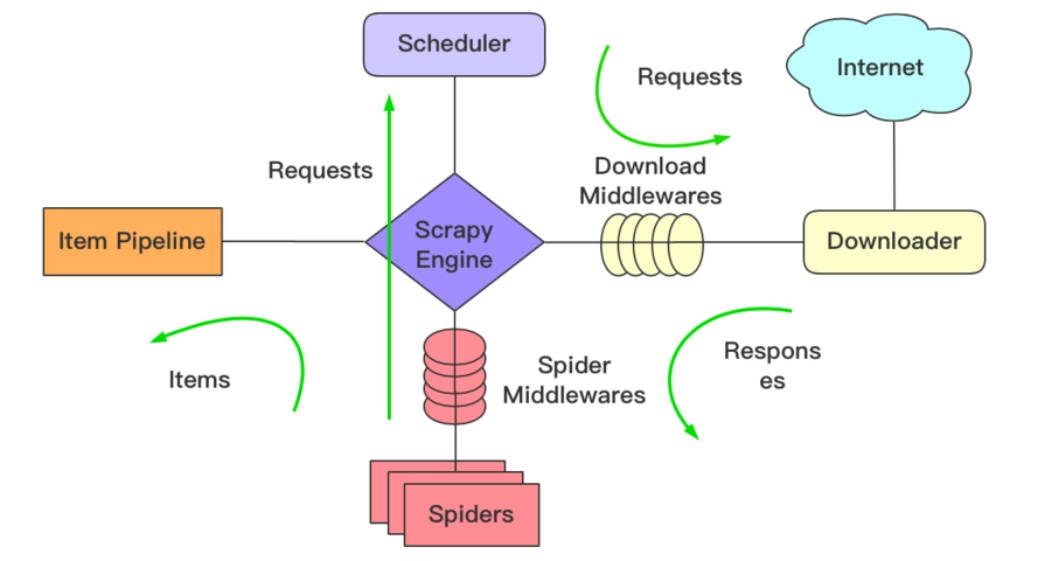

Crawler之Scrapy:数据挖掘必备的scrapy框架之最完整爬取网页内容攻略

scrapy框架之最完整爬取网页内容攻略

Crawler之Scrapy:Python实现scrapy框架爬虫两个网址下载网页内容信息

输出结果后期更新……实现代码import scrapyclass DmozSpider(scrapy.Spider): name ="dmoz" allowed_domains = ["dmoz.org"] start_u...

scrapy自动多网页爬取CrawlSpider类(五)

一.目的。 自动多网页爬取,这里引出CrawlSpider类,使用更简单方式实现自动爬取。 二.热身。 1.CrawlSpider (1)概念与作用: 它是Spider的派生类,首先在说下Spider,它是所有爬虫的基类,对于它的设计原则是只爬取start_url列表中的网页,而从爬取的网页中获取l...

本页面内关键词为智能算法引擎基于机器学习所生成,如有任何问题,可在页面下方点击"联系我们"与我们沟通。

社区圈子