[帮助文档] 如何使用Flume同步EMRKafka集群的数据至阿里云OSS-HDFS服务

本文为您介绍如何使用Flume同步EMR Kafka集群的数据至阿里云OSS-HDFS服务。

java flink + kafka,后端状态放hdfs后,每次重启服务,又从最早的消息开始消费问题

java flink + kafka,后端状态放hdfs后,每次重启服务,又从最早的消息开始消费,不是每次会提交检查点到hdfs吗,重启后,不应从最新的检查点开始处理么?

Flume实现Kafka数据持久化存储到HDFS

一、场景描述对于一些实时产生的数据,除了做实时计算以外,一般还需要归档保存,用于离线数据分析。使用Flume的配置可以实现对数据的处理,并按一定的时间频率存储,本例中将从Kafka中按天存储数据到HDFS的不同文件夹。1. 数据输入本场景中数据来自Kafka中某个Topic订阅,数据格式为json。...

Flume 读取本地数据输出到 HDFS/Kafka

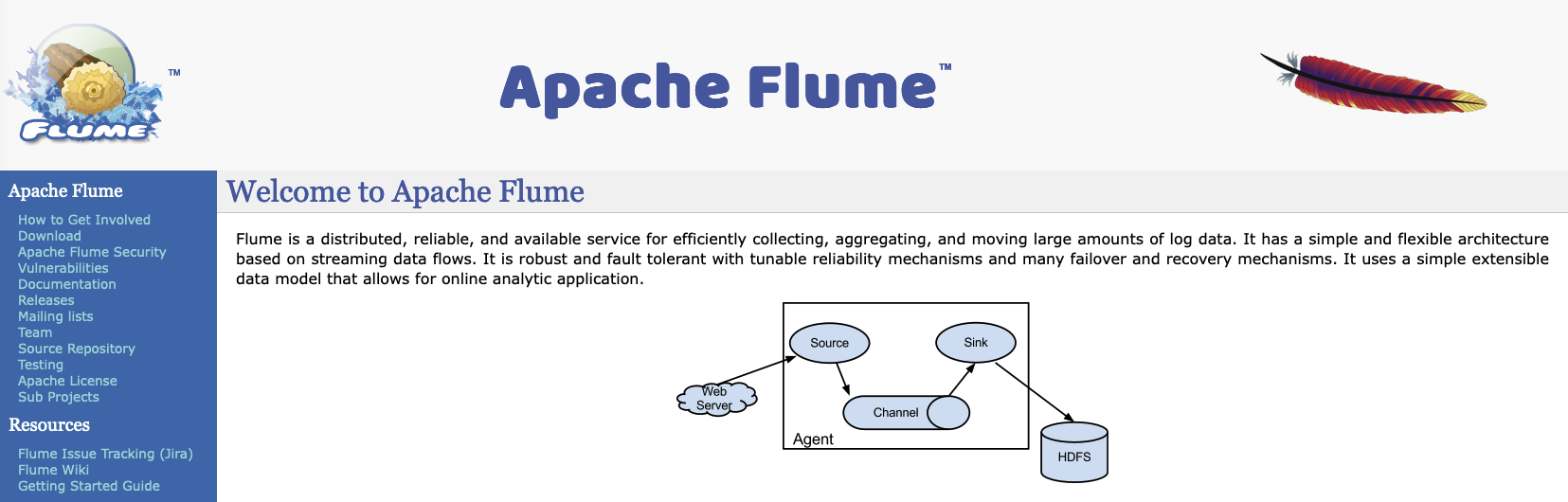

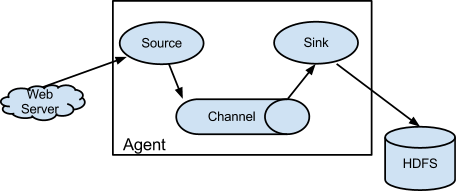

一、介绍Flume是一种分布式,可靠且可用的服务,用于有效地收集,聚合和移动大量日志数据。它具有基于流数据流的简单灵活的体系结构。它具有可调整的可靠性机制以及许多故障转移和恢复机制,具有强大的功能和容错能力。它使用一个简单的可扩展数据模型,允许在线分析应用程序。1.9.0版是Flume的第11版,是...

[帮助文档] 如何使用Flume同步数据至JindoFS服务

本文为您介绍如何使用Flume同步EMR Kafka集群的数据至阿里云OSS-HDFS(JindoFS服务)。

[帮助文档] 如何同步EMRDataFlow数据至EMRDataLake的HDFS

本文为您介绍如何同步EMR DataFlow集群的数据至EMR DataLake集群的HDFS。

请问,使用flume 消费kafka数据,上传到hdfs,出现重复消费的数据,是什么原因导致的呢

请问,使用flume 消费kafka数据,上传到hdfs,出现重复消费的数据,是什么原因导致的呢

flink 在别的集群里面运行,我怎么将kafka数据写到远程hdfs

flink 在别的集群里面运行,我怎么将kafka数据写到远程hdfs

flink消费kafka的数据写入到hdfs中,我采用了BucketingSink 这个sink将o

flink消费kafka的数据写入到hdfs中,我采用了BucketingSink 这个sink将operator出来的数据写入到hdfs文件上,并通过在hive中建外部表来查询这个。但现在有个问题,处于in-progress的文件,hive是无法识别出来该文件中的数据,可我想能在hive中实时查询...

flink将kafka中的数据落地到hdfs,在小文件和落地效率方面有什么好的建议?

背景: 现在使用的是spark streaming消费kafka的数据,然后落地到hdfs目录,产生了2个问题: 1、对于数据量较大的topic,且使用压缩存储之后,spark streaming程序会出现延迟。 2、落地的数据文件里有大量的小文件产生,namenode的压力增大 对于问题1,暂时分...

本页面内关键词为智能算法引擎基于机器学习所生成,如有任何问题,可在页面下方点击"联系我们"与我们沟通。

产品推荐

文件存储HDFS版kafka相关内容

文件存储HDFS版您可能感兴趣

- 文件存储HDFS版文件

- 文件存储HDFS版flink

- 文件存储HDFS版parquet

- 文件存储HDFS版设置

- 文件存储HDFS版格式

- 文件存储HDFS版hive

- 文件存储HDFS版映射

- 文件存储HDFS版cdc

- 文件存储HDFS版javaapi

- 文件存储HDFS版测试

- 文件存储HDFS版hadoop

- 文件存储HDFS版数据

- 文件存储HDFS版大数据

- 文件存储HDFS版操作

- 文件存储HDFS版api

- 文件存储HDFS版命令

- 文件存储HDFS版java

- 文件存储HDFS版集群

- 文件存储HDFS版存储

- 文件存储HDFS版文件存储

- 文件存储HDFS版配置

- 文件存储HDFS版分布式文件系统

- 文件存储HDFS版目录

- 文件存储HDFS版架构

- 文件存储HDFS版读取

- 文件存储HDFS版namenode

- 文件存储HDFS版mapreduce