机器学习PAI一般部署类bert的funetune模型的方法有文档参考吗?

机器学习PAI一般部署类bert的funetune模型的方法有文档参考吗?在自己环境下finetune,但想将fintune的模型部署到eas

机器学习PAI中EAS部署Bert微调模型有参考文档不,保存模型是.pth格式文件?

机器学习PAI中EAS部署Bert微调模型有参考文档不,保存模型是.pth格式文件?

[帮助文档] BERT模型离线推理组件说明

BERT模型离线推理组件主要用于BERT模型的离线推理,利用已经训练完的BERT分类模型,对输入表中的文本进行分类。

[帮助文档] 使用AIACC加速BERTFinetune模型的训练效率

本文适用于自然语言训练场景,例如,通过使用GPU云服务器和极速型NAS训练BERT Finetune模型,同时使用AIACC-Training(AIACC训练加速)进行该模型的训练加速,可有效加快多机多卡的训练速度,提升模型的训练效率和性能。

如何快速部署本地训练的 Bert-VITS2 语音模型到 Hugging Face

Hugging Face是一个机器学习(ML)和数据科学平台和社区,帮助用户构建、部署和训练机器学习模型。它提供基础设施,用于在实时应用中演示、运行和部署人工智能(AI)。用户还可以浏览其他用户上传的模型和数据集。Hugging Face通常被称为机器学习界的GitHub,因为它让开发人员公开分享和...

[帮助文档] 如何使用Blade优化通过TensorFlow训练的BERT模型

BERT(Bidirectional Encoder Representation from Transformers)是一个预训练的语言表征模型。作为NLP领域近年来重要的突破,BERT模型在多个自然语言处理的任务中取得了最优结果。然而BERT模型存在巨大的参数规模和计算量,因此实际生产中对该模型...

[帮助文档] 如何使用ACCL优化套件进行PyTorch分布式训练(BERT-Large模型为例)

本文以BERT-Large模型为例,介绍如何使用ACCL优化套件进行PyTorch分布式训练。

[帮助文档] AI加速:使用TorchAcc实现Bert模型分布式训练加速

阿里云PAI为您提供了部分典型场景下的示例模型,便于您便捷地接入TorchAcc进行训练加速。本文为您介绍如何在BERT-Base分布式训练中接入TorchAcc并实现训练加速。

模型部署专题 | 01:基于Triton Server部署BERT模型

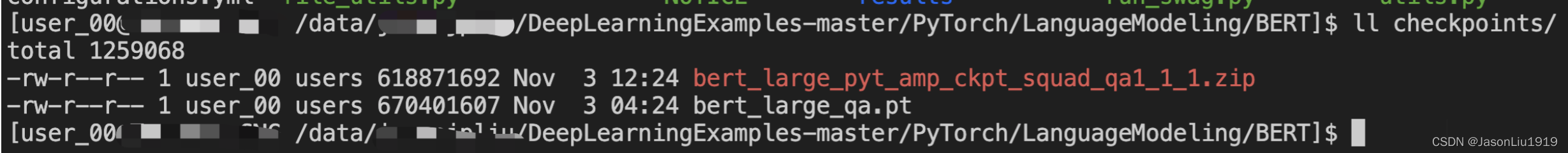

背景 本文简要介绍如何使用 Triton 部署 BERT模型,主要参考 NVIDIA/DeepLearningExamples 更多、更及时内容欢迎留意微信公众号: 小窗幽记机器学习 准备工作 下载数据 进入到/data/DeepLearningExamples-master/PyTorch/Lan...

本页面内关键词为智能算法引擎基于机器学习所生成,如有任何问题,可在页面下方点击"联系我们"与我们沟通。