[帮助文档] 如何在MaxCompute中如何创建外部项目,并查询Hadoop中的表数据

本文以E-MapReduce的Hive为例,为您介绍在MaxCompute中如何创建外部项目,并查询Hadoop中的表数据。

[帮助文档] 迁移Hadoop集群至DataLake集群

本文将详细阐述如何将您已有的旧版数据湖集群(Hadoop),高效地迁移至数据湖集群(DataLake),以下分别简称“旧集群”和“新集群”。迁移过程将充分考虑旧集群的版本、元数据类型以及存储方式,并针对这些因素,提供适应新集群的迁移策略与步骤。

[帮助文档] 基于Hadoop集群支持Delta Lake或Hudi存储机制

Delta Lake和Hudi是数据湖方案中常用的存储机制,为数据湖提供流处理、批处理能力。MaxCompute基于开源的Hadoop集群提供了支持Delta或Hudi存储机制的湖仓一体架构。您可以通过MaxCompute查询到实时数据,即时洞察业务数据变化。

[帮助文档] 如何通过MaxCompute与Hadoop构建湖仓一体

通过MaxCompute与Hadoop构建湖仓一体方案旨在实现对海量数据的统一管理、存储和分析,提供了一个既能处理结构化、半结构化数据,又能满足高并发分析需求的一体化数据平台。本文为您介绍如何通过MaxCompute与Hadoop构建湖仓一体,以及管理湖仓一体项目。

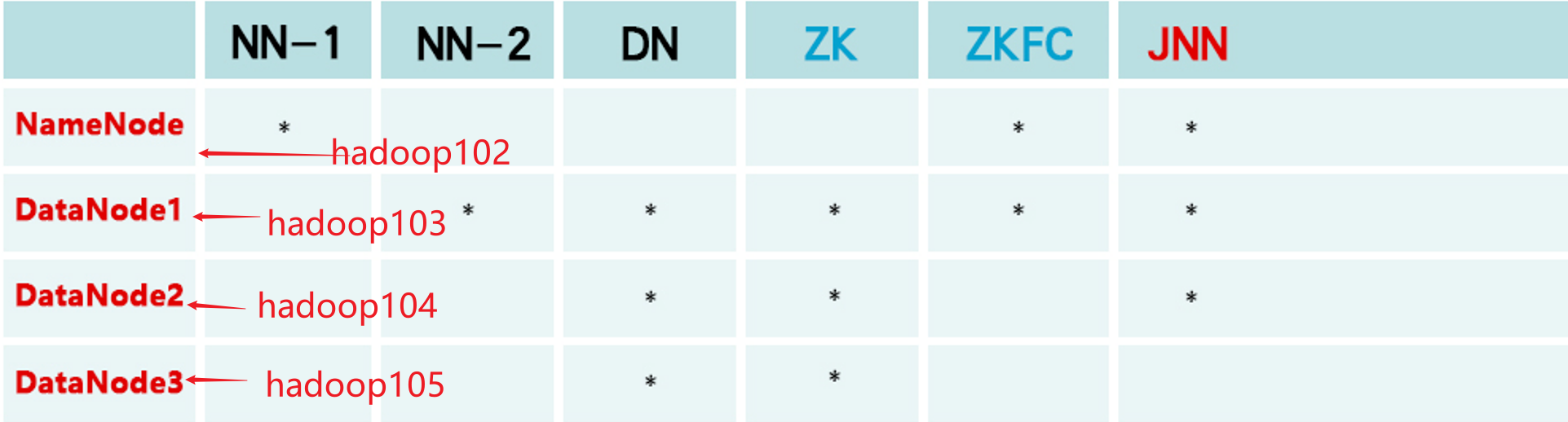

大数据 | Hadoop HA高可用搭建保姆级教程(大二学长的万字笔记)(下)

七、检验集群✨7.1 jps检查使用jpsall脚本分别查看四个节点上的jps进程信息,是否和集群规划相符,集群规划图再放一遍:jpsall和集群规划完全一致!7.2 网页检查分别访问NameNode1和NameNode2的两个Web页面,网址是http://hadoop102:9870,http:...

大数据 | Hadoop HA高可用搭建保姆级教程(大二学长的万字笔记)(上)

一、写在前面🎈大家好!我是初心,今天给大家带来的是Hadoop HA搭建保姆级教程,来自大二学长的万字长文自述和笔记!相信很多人看到这个标题时,可能会产生一种疑问:博主你之前不是出过一期关于Hadoop HA高可用集群搭建的教程了吗,这次怎么还出一篇?是有什么改进的地方...

[帮助文档] 如何管理SmartDataHadoop回收站

Hadoop回收站是Hadoop文件系统的重要功能,可以恢复误删除的文件和目录。本文为您介绍Hadoop回收站的使用方法。

好程序员大数据教程Hadoop全分布安装(非HA)

机器名称 启动服务 linux11 namenode secondrynamenode datanode linux12 datanode linux13 datanode 第一步:更改主机名,临时修改+永久修改 临时修改:hostname linux11 永久修改: v...

本页面内关键词为智能算法引擎基于机器学习所生成,如有任何问题,可在页面下方点击"联系我们"与我们沟通。

hadoop大数据相关内容

- 大数据技术hadoop

- 大数据hadoop分布式

- 大数据hadoop

- 大数据面试题百日hadoop

- 大数据hadoop部署

- 大数据hadoop配置

- 大数据hadoop spark安装

- 大数据hadoop实战源码

- 大数据hadoop运行

- 大数据hadoop机制

- 大数据hadoop单词源码

- 大数据hadoop mapreduce

- 大数据hadoop编程

- 大数据hadoop pdf

- 大数据spark企业级hadoop pdf ppt

- 大数据hadoop技术

- 大数据hadoop spark flink

- 大数据处理hadoop大数据

- hadoop大数据编程模型

- hadoop大数据原理

- 大数据框架hadoop

- hadoop分布式大数据

- 大数据hadoop运行环境

- 大数据hadoop集群搭建

- 大数据hadoop实战篇

- hadoop小菜大数据

- 大数据hadoop源代码

- 大数据hadoop ubuntu

- 大数据hadoop端口

- 六六大数据hadoop

- 大数据入门hadoop

- 大数据hadoop环境搭建

- hadoop大数据基础教程

- 数据平台hadoop大数据

- hadoop大数据工具

- hadoop大数据计算存储服务平台

- 大数据hadoop大数据平台

- 大数据hadoop开发

- hadoop大数据应用

- 大数据hadoop家族

- 大数据hadoop方法

- hadoop大数据开源工具

- 大数据安全hadoop

- 大数据原理hadoop

- 大数据框架hadoop spark

- hadoop大数据价值

- 大数据apache hadoop概述

- hadoop cutting大数据